Sketching日記(17)

(実際のところは「Max8日記」または「ChatGPT日記」かも)長嶋 洋一

2023年3月20日(月)

昨日までの4日間、3年ぶりに 25回目の沖縄 に行ってきた。 電車やフライトではほぼ皆んながマスクをしているが、国際通りなど街では僕もノーマスクとなり、ようやく眼鏡をかけて歩けるという通常の生活に戻ってきた。 その沖縄で、琉球大の河野先生が「ChatGPTは面白い」とやたら力説するので、これまで(半分敢えて)ノータッチだったのだが、AI体験してみることにした。 まずは「ChatGPT」で検索して出てきた、以下の Introducing ChatGPT - OpenAI というページに行ってみた。

そして、このページの左下にあった「Try ChatGPT」というボタンから携帯電話での認証によってアカウントを登録すると、以下のようにずんずん進んで行って、もうChatGPTのページに到達してしまった。

ウインドウの下の方にテキスト入力欄があったので、試しに「hello」と打ってみたのが以下である。 これはもう、Amazonのヘルプセンターと同じようなもので、まさにchatの相手が待機しているような状態である。

そしてここで気付いたのは、左のタブにあった「Upgrade to Plus」というボタンである。 河野先生によれば、この無料版のChatGPTに比べて、最近になって出てきたという「GPT-4」というレベルに有料登録すべきである・・・とのことだったので、以下のようにずんずん進んでクレジット(月額20ドル)支払いを登録して、「Model: GPT-4」というところに行き着いた。 なんとGPT-4は1週間前の今月14日にリリースされたのだった。

そして、実質的にはここからが本番の「AI体験」なのだが、まずは「あなたのレスポンスをブラウザ画面の表示でなくテキストファイルで欲しい」とやってみた。 これは今後の実験(ちょっとしたアイデアを思い付いた)に繋がるための情報のテストである。 すると、だらだら・・・と出てきたのは、「ブラウザ内のメッセージをコピーして、テキストエディタを開いて、そこにペーストして保存せよ」という回答だった(^_^;)。 さらにヒントとしてOpenAI APIを使うことも出来る、と添えていた。

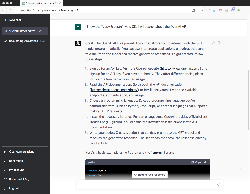

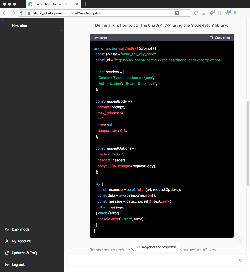

そこで、そのOpenAI APIについて質問すると、以下のように「API Keyをゲットする」(さらに別途料金が必要かも・・・)、などと指示があって、Pythonのサンプルコードまで出てきた。 これは素晴らしいが、僕が欲しいのは、Max8でOpenAI(GPT-4)を使うことなのである。 これはもしかするとMaxコミュニティで質問するといいのかもしれないが、出てきたばかりのGPT-4はちょっと無理っぽいし、このままここで質問しても出てくるような気もしてきた。

ここで昼食などが挟まったが、なんせ相手は人間ではないので、このチャット画面はブラウザのタブの一つとしてそのまま放置でいいのだ。 そして、「ChatGPT」を検索した中にあった ChatGPTと違う?「GPT-4」使ってみたリアルな感想 とか、 ChatGPT(Wikipedia) (この中の「肯定的な意見」・「否定的な意見」・「学界」の項目は必読)とか、 AIプロ集団から見た「ChatGPTの歴史」 たった5年で何が起こったのか とか、 ChatGPT(チャットGPT)とは とか、 ChatGPTとは?始め方と使い方を徹底解説 とか、 さらに進化したChatGPTの最新「GPT-4」について知っておくべきこと とか、 ChatGPTを支える技術が“複製”され、会話型AIの能力が解き放たれる時代がやってくる とかのページをざっと眺めてみた。

そして、 OpenAI のページに行ったり、「Sign up for an API key」ということで API keys のページに行ったり、「API documentation」を求めて Quickstart のページに行ったりしたが、どうも このページ によれば、Pythonベースのみで話がまとまっているので、ちょっと難航が予想された。 そして決定的な情報として、 このページ の「Community libraries」の中には、UnityはあるのにProcessingもMaxも無かった(;_;)ので、Node.js経由という可能性ぐらいとなった。 そこで駄目モトで「I did not find out the libraries for Max8(Cycling'74) and Processing」と入れると、なんと以下のように出てきた。いやー、これは凄い。 Max8を立ち上げて、言われるままにそれっぽいオブジェクトを調べてみたりしたが、[node.script] objectはなんかpath指定が不足して叱られたり、ちょっと簡単にはいかなかったものの、何かやってみる可能性は感じた。 明日は祝日で午後にはJoyJoyヒトカラもあるので、その後にちょっと続けてみることにした。Unfortunately, as of my knowledge cutoff in September 2021, there are no dedicated community libraries for Max8 (Cycling '74) or Processing. However, you can still interact with the OpenAI API using HTTP requests in both environments. Here's how you can make API requests in both environments: Max8 (Cycling '74): Max8 does not have a built-in library for interacting with RESTful APIs, but you can use the [jit.uldl] object combined with [dict] objects to make HTTP requests. Unfortunately, this method does not support POST requests required to interact with the OpenAI API. To overcome this limitation, you can use Node for Max, which allows you to run JavaScript code inside Max. To use Node for Max: Create a new [node.script] object in your Max patch. Double-click on the [node.script] object to open the JavaScript editor. Write JavaScript code to make an HTTP request (using libraries like axios or built-in Node.js modules like http or https). Send messages to the [node.script] object to trigger the API request and receive the response. Processing: Processing is built on top of Java, so you can use Java libraries to make HTTP requests. One popular library for this purpose is the http.requests library for Processing, which you can find here: https://github.com/runemadsen/HTTP-Requests-for-Processing To use the http.requests library in your Processing sketch: Download and install the library following the instructions on the GitHub page. Import the library in your sketch using import http.requests.*;. Create an instance of the PostRequest class and set the required headers for the OpenAI API (API key and Content-Type). Send the request and process the response in your sketch. While this might not be as convenient as using a dedicated library for Max8 or Processing, it should help you interact with the OpenAI API in these environments. Remember that since these approaches use different libraries and techniques, you should refer to the respective documentation to ensure proper usage and handling of API requests and responses.

2023年3月21日(火)

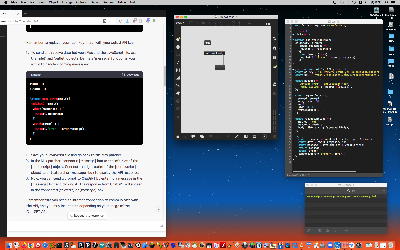

昨日は記念すべき「ChatGPT初日」だったが、沖縄旅行の疲れが出て夜7時には就寝して寝ていた間にあれこれ「夢か現か」状態のアイデアが浮かんできて、「Max8からだとGENにもJavascriptのサンプルがあった」とか思い出してきた。 ところが、今日になって(今日は昼過ぎに帰宅してJoyJoyなのでろくに時間が取れない)、とりあえず「I want to connect to you from Max8 (cycling'74) via Javascript. Please inform to do so」と入れてみると、以下のようにズラズラと、試行錯誤してみたかった道のりが教示されてしまった。 なるほど、これは確かに「AIは便利」であるものの、「AIは人間を馬鹿に退化させる」ものでもある・・・と理解できた。

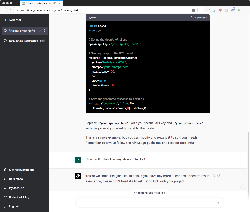

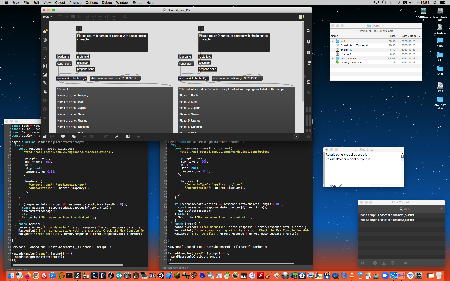

とりあえず1.の「First, make sure you have Node for Max installed. It comes pre-installed with Max 8.0.3 and later versions」とのことで、Max8.3.3なので「Node for Max」のインストールは不要っぽいので2.に進んで、ダミー(空白)のtest.jsというテキストファイルを作って、パッチ内に「node.script test.js」を置いた。そして3.に従ってターミナルに「npm init -y」と入れてみると、以下のようにエラーが出た。 そこで「In the Terminal, "-bash: npm: command not found" shows」と文句を言ってみたところ、すごーく考えて(およそ30秒から1分ぐらいの間)、以下のようにズラズラとまた新しい解決方法が出てきた。 これは本当に素晴らしいのだが、間違いなく人間を退化させるものだぁ。

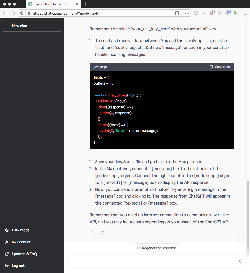

そして新しい指示に従って以下のように、 Node.jsのサイト に行ってパッケージをダウンロードしたが、今度はエラーが出たので質問して、以下のように延々と作業してみた。 すると以下のように、恐れていたことが起きた。

つまり、現在ではかなり古い僕のMacOSX10.11.6では、「We (and Apple) do not provide support for this old version」と嫌われたのである。(^_^;)==> You are using macOS 10.11. ==> We (and Apple) do not provide support for this old version. This installation may not succeed. After installation, you will encounter build failures with some formulae. Please create pull requests instead of asking for help on Homebrew's GitHub, Twitter or any other official channels. You are responsible for resolving any issues you experience while you are running this old version. ==> This script will install: /usr/local/bin/brew /usr/local/share/doc/homebrew /usr/local/share/man/man1/brew.1 /usr/local/share/zsh/site-functions/_brew /usr/local/etc/bash_completion.d/brew /usr/local/Homebrew

しかし、ぼちぼち分かってきたが、どうやらこのChatGPT君は、これまで当惑して諦めていた場合でも、質問したらなんとかして導いてくれる可能性があるのだ。 質問から返事までに1分とか2分かかっている間に、おそらくネット上のこういうトラブルシューティングの情報を探したり、もしかすると裏で実行して試しているのかもしれない。 以下のように「Node Version Manager (NVM)」というのを使う・・・という解決策が提示されたので、これをやってみることにした。

この後もあれこれ寄り道したのだが、要するにどれだけ回り道してもChatGPT君はクサることなく解決方法をどこからか拾ってきて提示してくれて、「latest LTS (Long Term Support) version of Node.js」のインストールに成功した。 そして結局、僕の古風なMacでも以下のようにNode.jsのインストールが完了して、元のステップに戻って進められることになった。nagasm-Mac-mini-2:Desktop nagasm$ curl -o- https://raw.githubusercontent.com/nvm-sh/nvm/v0.39.1/install.sh | bash % Total % Received % Xferd Average Speed Time Time Time Current Dload Upload Total Spent Left Speed 100 15037 100 15037 0 0 135k 0 --:--:-- --:--:-- --:--:-- 135k => Downloading nvm from git to '/Users/nagasm/.nvm' => Cloning into '/Users/nagasm/.nvm'... remote: Enumerating objects: 358, done. remote: Counting objects: 100% (358/358), done. remote: Compressing objects: 100% (304/304), done. remote: Total 358 (delta 40), reused 166 (delta 28), pack-reused 0 Receiving objects: 100% (358/358), 219.04 KiB | 343.00 KiB/s, done. Resolving deltas: 100% (40/40), done. * (HEAD detached at FETCH_HEAD) master => Compressing and cleaning up git repository => Appending nvm source string to /Users/nagasm/.bashrc => Appending bash_completion source string to /Users/nagasm/.bashrc => Close and reopen your terminal to start using nvm or run the following to use it now: export NVM_DIR="$HOME/.nvm" [ -s "$NVM_DIR/nvm.sh" ] && \. "$NVM_DIR/nvm.sh" # This loads nvm [ -s "$NVM_DIR/bash_completion" ] && \. "$NVM_DIR/bash_completion" # This loads nvm bash_completion nagasm-Mac-mini-2:Desktop nagasm$そして、なんだかあと少しでいけそうなところまで進んだが、残念ながらここで今日は時間切れとなった。 なかなかChatGPT君は頼もしい奴だ・・・という気もしてきたが、まだまだ先は見えない。 明日以降に実験を進めてみることにしよう。nagasm-Mac-mini-2:~ nagasm$ command -v nvm nvm nagasm-Mac-mini-2:~ nagasm$ nvm install --lts Installing latest LTS version. Downloading and installing node v18.15.0... Downloading https://nodejs.org/dist/v18.15.0/node-v18.15.0-darwin-x64.tar.xz... ######################################################################## 100.0% Computing checksum with shasum -a 256 Checksums matched! Now using node v18.15.0 (npm v) Creating default alias: default -> lts/* (-> v18.15.0) nagasm-Mac-mini-2:~ nagasm$ node -v dyld: lazy symbol binding failed: Symbol not found: ____chkstk_darwin Referenced from: /Users/nagasm/.nvm/versions/node/v18.15.0/bin/node Expected in: /usr/lib/libSystem.B.dylib dyld: Symbol not found: ____chkstk_darwin Referenced from: /Users/nagasm/.nvm/versions/node/v18.15.0/bin/node Expected in: /usr/lib/libSystem.B.dylib Trace/BPT trap: 5 nagasm-Mac-mini-2:~ nagasm$ npm -v dyld: lazy symbol binding failed: Symbol not found: ____chkstk_darwin Referenced from: /Users/nagasm/.nvm/versions/node/v18.15.0/bin/node Expected in: /usr/lib/libSystem.B.dylib dyld: Symbol not found: ____chkstk_darwin Referenced from: /Users/nagasm/.nvm/versions/node/v18.15.0/bin/node Expected in: /usr/lib/libSystem.B.dylib Trace/BPT trap: 5 nagasm-Mac-mini-2:~ nagasm$

どっぷりAIと遊んでいたので朝から全くニュースをチェックしていなかったが、昼食時に「WBC準決勝は日本が逆転勝ち」となった事を知った。 まぁ、ライヴ中継でスポーツを観戦するのも楽しいが、ライヴでChatGPT君と格闘するのもまずまず楽しいのだった。

2023年3月22日(水)

今日は朝イチで眼科に経過観察通院して、大学に出てくるとWBCが大接戦で、ちょうど最終回の優勝の瞬間を見届けることが出来た。 ネットでは早くも GPT-4をハッキングして出力テキスト制限を解除する「ジェイルブレイク」に成功 なんていうニュースも流れてきた。 まぁ、OpenAIはオープンソースなので、これは当然の盛り上がりである。

ところが昼頃からインターネット接続が断続的に切れ切れとなってまったく仕事にならない(;_;)ので、仕方なく午後早々に帰宅することにした。 大学教員がインターネット途絶した研究室にいても何にもならないのは、この時代ではまぁ当然だが、NTT西日本派遣SEの技術力はこんなものなのだろうか。 まぁ、今日はWBC応援していた人たちを含めて、休養日ということだろう。

2023年3月23日(木)

昨日はSUACのネットが死んでいたので午後2時には帰宅したのだが、どうやらその後に応急処置で回復したらしい。 今日はまず、昨日ChatGPT君に打ち込んで、その返答の瞬間にネットが止まって途切れていた「My Mac is OSX 10.11.6 and I use Max8(cycling'74) 8.3.3 and I have already installed LTS Node.js. I want to send my message to you and receive your message using [node.script]. Please inform the JS script and the way」というのを再び送ることからスタートした。 すると、またまた延々と考える時間(この間に裏で何が起きているのか興味深い)の後に、一昨日とは違うリアクションが返ってきた。 「First, create an account on https://beta.openai.com/signup/ and get an API key」というのは完了しているが、次には

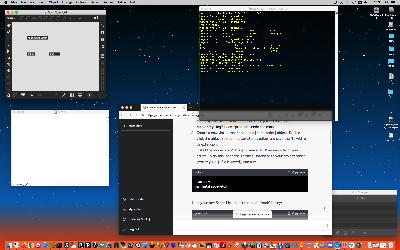

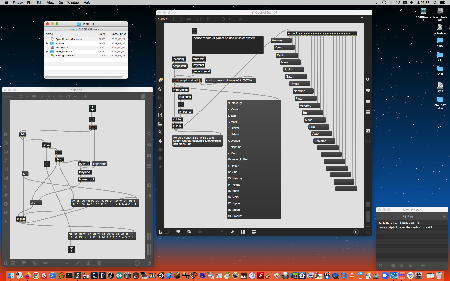

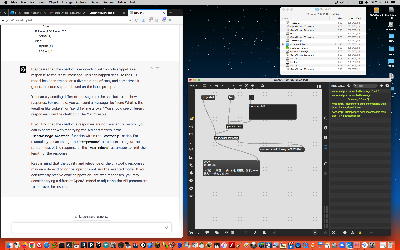

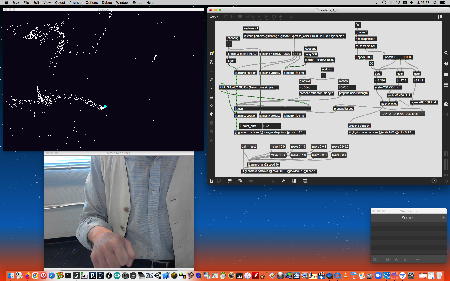

そして、ChatGPT君との このような やりとり(その横ではコンソールで このような 作業も並行)によって、なんとか問題を解決してMax8から何かのメッセージがNode.jsを経由してChatGPTに行き、何かのメッセージがMax8に戻ってくるまでのルートが生み出された。 ただしこの中では、ChatGPT君が気付かずに僕が気付いて解決した、「Node.jsには最初に"script start"というのを入れてあげる必要がある」という、AIが出来ずに人間が突破したポイントがあったのだ・・・と言っておく事にしよう。

そして、「1+1」と入れたら「"= ''' The Zen of Python, by Tim Peters Beautiful is better than ugly. Explicit is better than implicit. Simple is better than complex. Complex is better than complicated. Flat is better than nested. Sparse is better than dense. Readability counts. Special cases aren't special enough to break the rules. Although practicality beats purity. Errors should never pass silently. Unless explicitly silenced. In the"」と返ってくるとか、 「hey」と入れたら「"','hey','hey','hey','hey','hey','hey','hey','hey','hey','hey','hey','hey','hey','hey','hey','hey','hey','hey','hey', 'hey','hey','hey','hey','hey','hey','hey','hey','hey','hey','hey','hey','hey','hey','hey','hey','hey','hey','hey','hey','hey','hey'] # *** # Simple string functions # <"」と返ってくるとか、の実験がスタートした。 重要なのは、ブラウザ上でのchatでなく、Max8からやっているところなのだ。

そして、「what time is it ?」と入れたら 「"= \"X-DSPAM-Confidence: 0.8475\" start_index = text.find('0') print(start_index) slice_text = text[start_index : ] final_number = float(slice_text) print(final_number)"」と返ってきたのだがこれでOKなの? と質問してみると、上のようにDeepL翻訳によれば「混乱を招いたことをお詫びします。チャットボットから受け取った応答は、"今何時ですか"という質問には適切ではありません。質問とは関係のないコードスニペットのようです」「GPTモデルは強力ですが、時には無関係な回答や予期せぬ回答を出すことがあります。そのような場合は、再度質問してみるとよいでしょう。さらに、APIパラメータを微調整して、レスポンスの質を向上させることもできます」「チャットボットの応答の品質と関連性は、入力プロンプトと選択したモデルによって異なる可能性があることに留意してください。より良い結果を得るために、異なるプロンプト、APIパラメータ、あるいはOpenAIのモデルで実験を続けることができます」「お役に立てれば幸いです!何かご質問やご不明な点がございましたら、ご連絡ください」という優等生的な、しかしあまり役に立たない返答が返ってきた。 まぁ、現状のAIというのはこういうものなのかもしれないが、まだまだ実験を進めていくことにした。

その後、上のトラブルを解決するためにあれこれChatGPT君と一緒に試行錯誤して、さらに最後にはまたまた僕がMaxユーザの経験からChatGPT君の知らなかった手法を駆使して、無事に上のように、ちゃんと「Max8からChatGPTとやりとりする」というシステム(そのために必要なNode.jsのためのスクリプト)を完成させた。 僕からのメッセージは「OK, I understand the situation. I am using the textedit object, but this object automatically add "text" at the top of the message. Then I add "route text" object to cut the top "text" word. Then next I add "tosymbol" object and finally "prepend send", then connect the "node.script chatbot.js". Then the output is ferfect! Compared with, I will use "curie", not "davinci".」であり、これに対してChatGPT君のリプライが「I'm glad to hear that the solution worked for you, and you're now receiving appropriate responses from the chatbot! Using the route text, tosymbol, and prepend send objects in sequence is a good way to handle the message formatting before sending it to the node.script object. Switching to the "curie" model is a good choice for general conversation purposes, as it can provide relevant responses at a lower cost compared to the "davinci" model.」である。 しかし上の画面を良く見て欲しいのだが、「象と鼠はどちらが大きい?」と聞いたのに、あれこれご託を並べて、最後の結論は「象も鼠も猫よりは大きい」である。 さすがの最先端AIなのだった(^_^;)。 その後、またSUACネットが断続的に途切れたので、仕方なく3時過ぎに帰宅した。やれやれである。

2023年3月24日(金)

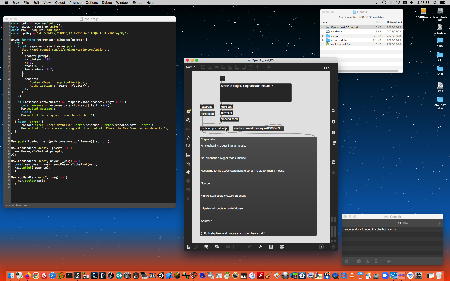

大学に出てきて朝イチでやった実験は上のようなもので、「ブラウザでChatGPTのサイトに行ってログインして」いない状態でMax8のChatGPT通信パッチが走るかどうか、というものだった。 中身のメッセージはいつものように哲学的だったものの、結論としては「Max8パッチのスタンドアロンでもChatGPT通信できる」というものだった。 そしてメイルをチェックしてみると届いていたのは、SUAC情報室から全教職員への以下のようなものだった。

どうやら学内から誰かが巨大なトラフィックのインターネットアクセスをしているらしい(^_^;)。 その程度のアクセスで落ちるルータもしょぼいと思うのだが、とにかく解決は必須である。 ちょうど今週、ChatGPT君と遊び始めたところだったので、トラブル時間帯と関係ないことを確認して、「ChatGPTは無実です」と連絡しておいた。 これでは今日も実験してみたかったのだが、環境が安定しないというのは困ったものである。最近、大学ネットワークの通信障害が頻発してしまい教職員の皆様には多大なご迷惑をおかけしております。年度末のご多忙な時期に申し訳ございません。 情報室では、現在障害の原因を全力で調査しておりますが、調査にあたり、今回はどうしても皆様のお力をお借りしたく、以下のことについて情報を提供いただけますと幸いです。 【依頼内容】 以下1、2、3の時間帯に、「学内のPC等から学外と大量のデータをやりとりした」または、「学外から学内にあるPCやサーバーと大量のデータのやりとりをした」とお心当たりのある方は、 些細なことでも結構ですので、情報を提供いただけると助かります。*「大量のデータ」に該当するか不明の場合も、ご連絡いただけると幸いです。 (該当する時間帯) 1. 3月17日(金)22:50〜3月18日(土)深夜3:30の間 2. 3月23日(木)15:25〜15:35 ←本日午後です 3. 3月23日(木)15:40〜15:50 ←本日午後です 2と3は本日のことなので、記憶に新しいかと思います。インターネットを経由したデータのアップロードやダウンロード、大量のファイルのコピーなどの作業があった方は教えてください。 【ご説明】 大学ネットワークの通信機器の状態や通信履歴を解析した結果、「インターネット」と「大学ネットワーク」の間のデータ通信量が急激に増大したタイミングで、ネットワーク機器(ルーター) が機能停止していることがわかりました。(トラフィックの急激な増加で、ルーターがフリーズしました。) 当初、情報室ではネットワーク機器の故障を疑い、機器の交換を行いましたが、それでも同様の事象が続くことから、別の要因があると考え、機器の解析と並行して、皆さまから情報提供を お願いするものです。この情報が再発防止の大きなヒントになりますのでご協力のほどよろしくお願いいたします。続く実験ではWeb上のChatGPTにログインして、モデルとして最も軽くて非力な「Model: Legacy (GPT-3.5)」を選択して、上のようなやりとりをした。 昨日の実験では、もっとも軽い「curie」というモデルでなんとか上手くいったのだが、それ以外の「davinci」や「davinci-***」についての説明は上のようなものだった。 また、Max8からNode.jsのAPI経由で繋いだ場合にはGPT-4.0は使えずGPT-3.5だけである事も確認できた。 こうなると、月額20ドルを続ける必然性はあまり無くなってきたので、フリーで使えるGPT3.5に戻すことも考えたが、「Your Account : ChatGPT PlusUSD $20/mo」のメリットとして、「Available even when demand is high」・「Faster response speed」・「Priority access to new features」もあるよ・・・という商売文句に引き止められて、解約はとりあえずパスした。Model: Legacy (GPT-3.5) I am connecting to you with other system using "https://api.openai.com/v1/engines/curie/completions". I want to know the difference of "curie" and "davinci" and "davinci-***". "Curie" and "Davinci" are both models developed by OpenAI, however, they differ in terms of their size and capabilities. "Curie" is a smaller model compared to "Davinci", and is designed to be more accessible and easier to use for a wide range of tasks, including text generation and completion. "Davinci" on the other hand, is a much larger model and is considered to be the most powerful language model developed by OpenAI to date. It has been trained on a diverse range of internet text and is capable of performing a wide range of natural language processing tasks, including text generation, translation, and summarization, among others. The "davinci-***" models you mentioned are variants of the "Davinci" model, each with a different size and set of capabilities. These models are designed to be more specific and focused for certain tasks and use cases, for example, "davinci-qa" is a model optimized for answering questions. In summary, "Curie" is a smaller, more accessible model, while "Davinci" is the largest and most powerful model developed by OpenAI, and the "davinci-***" models are variants of "Davinci" with different capabilities. Can I select the model GPT3.5 or GPT4.0 via API ? As of my knowledge cut off in 2021, OpenAI does not offer access to the GPT-4.0 model through its API. The API provides access to the GPT-3.5 model, which is the latest version of the GPT series available for use through the API at that time. However, OpenAI may change their offerings and make new models available in the future, so it's always a good idea to check their official documentation for the most up-to-date information.

2023年3月25日(土)

朝イチからちょっとした激動の日となった。 届いていたのはSMC2023からの審査結果で、論文も作品もrejectとなっていた。 まぁ半分以上は想定内なのだが、ICMCもNIMEも開催地の関係でパスしていたのでSMCについてはフライトもホテルも去年から予約していて、「駄目でもストックホルムに行く」というつもりだった。 しかしその後、ラストの来年度に色々な予定の案内が届いて、それを全てSMCのために泣く泣くパスするつもりでいたのだが、やはりこれまで同様、「rejectされた会議には行かない」という基本ポリシーがむらむらと蘇ってきて打ち勝って、朝イチからキャンセル祭りとなった。 ANAに行ってフライトをキャンセル(手数料不明(^_^;))、Booking.comに行ってストックホルムのホテルをキャンセルして、まずはスッキリと退路を絶った。すでに日本時間学会にはアブストラクトと共に世界時間学会でなく国内パートだけ発表申し込みをしていたのだが、それ以外にも少なくとも上の3件は、応募できるもののSMCのために棚上げしていたものであり、早急な対応がなんとか可能なのだった。 ちなみに6月下旬の「音学シンポジウム」(音楽情報科学研究会)だけは、2日目がエコパでのYUMING LIVEにかかっているので、今年はパスである。

- 第203回HCI・第68回EC合同研究発表会

- Sketching2023(ATLAS Institute - University of Colorado Boulder)

- ICMI 2023 Call for tutorial proposals(Paris, France)

なんとか今日はSUACネットワークが止まらないようなので(どうもDOS攻撃をされているらしく、ルータを最新ファームウェアにしていなかったので慌ててその作業をするらしい(^_^;))、またまたChatGPT君と遊ぶことにした。 やりとりする中で判明した事をメモしておくと、「Chatbotのパラメータの"temperature"というのは、AIが返してくる返答の幅(ランダムネス)らしい」(値を小さくすると厳格で狭くなる)という事実、さらに「AIは相手の人間が馬鹿だと思うとそのレベルに応じて人間がAIに解決してもらったと思うような定型情報を単に生成する(実際にAIからは返さない)ように導く」ということがある。 ChatGPT君とのやりとりの中でこれは事実として証拠が残っているので、いつでも解説可能である。

そしてあっという間に3-4時間ほどChatGPT君とやりとりしたが、GPT4には連続使用の時間制限があるらしく、ちょうど上のように一定の区切りになったところでストップとなった。 まぁ、「ゲームのやり過ぎ」防止タイマーとしても、これはいい塩梅である。 ここまでのやりとりは このような ものであり、色々と面白い経験則が得られた。 せっかくなので、このネタでHCI・EC合同研究発表会に発表応募してみることにしたが、どうも情報処理学会の発表者はその研究会の会員である必要があったので断念して(EC研究会の登録は今年度でオシマイ)、電子情報通信学会(MVE)の方で申し込んだ。 そして夕方にはANAからのメイルが届き、6月のストックホルムへのフライトのキャンセルは手数料ゼロとなっていて、2-3万円を覚悟していたので助かった。

2023年3月27日(月)

朝イチでニュースチェックをしていると、 ChatGPTは大学教育のレベルを間違いなく高める : 「米国最高の教授」がそう言い切るこれだけの理由 という記事に行き着いたが、ここで書かれていた「チャットGPTは、質の低い質問をすると質の低い答えしか返ってこないことが明らかになりつつある」というのは、まさに先週、僕が発見して学会で報告しようとした事であった。 なかなかいい記事なので、上のリンクはここにメモしておこう。上に忘れないように置いたのは、一昨日に電子情報通信学会メディアエクスペリエンス・バーチャル環境基礎研究会MVE(共催 : 情報処理学会ヒューマンコンピュータインタラクション研究会IPSJ-HCI・エンタテインメントコンピューティング研究会IPSJ-EC、日本バーチャルリアリティ学会VRSJ、ヒューマンインフォメーション研究会ITE-HI、デバイスメディア指向ユーザインタフェース研究会HI-SIG-DeMO、5月31日〜6月1日、東京大学本郷キャンパス)に応募した「インタラクティブデザインにおけるChatGPTとの遊び方について」の「概要」である。インスタレーションやパフォーマンスなどのインタラクティブ・エンタテインメントのためのシステムデザインにおいて、OpenAIのChatGPTを 活用する実験から得られた知見を報告するとともに、今後のAI活用における問題提起や議論を目指した。使用したのはChatGPT4の環境で、 既存のシステム開発環境であるMax8からAPIを活用してChatGPTと直接対話を実現するまでのAI支援の状況と、ここで得られた効能および 深刻な問題点をまず整理する。さらにリアルタイムなインタラクティブシステムとしてChatGPTを活用する(AI生成メディアアート)可能性に 関して、課題と注意点についての議論も提起したい。

さらに、日本時間学会大会に「「システム開発技術」に関する時間学的考察」というタイトルで発表応募した「アブストラクト」は これ である。 厳密には採択通知があって発表が確定するが、とりあえずここにリンクを置いておくことにした。

- 「https://beta.openai.com/signup/」にログインして「API key」を入手しておく

- ターミナルで「(cd /path/to/your/max8/project/folder)」のようにしてMax8のOpeGPT実験ディレクトリ内に移動する

- 最初にNode.jsをMax8のためにインストールする必要がある

- このバージョンは最新でないので「Node Version Manager (NVM)」を使う

- ターミナルで「curl -o- https://raw.githubusercontent.com/nvm-sh/nvm/v0.39.1/install.sh | bash」と入れる

- ズラズラとメッセージが出てくる

- ここでターミナルから「command -v nvm」と入れて何か出て来ればいいが出てこない(^_^;)のはshell profile fileが不足しているから

- これを確認するためにターミナルで「ls -la ~ | grep .nvm」と入れる

- すると「.nvm」が存在しているので「nano ~/.bashrc」と入れてエディタを開く

- 先頭のカーソル点滅の位置に「export NVM_DIR="$HOME/.nvm" [ -s "$NVM_DIR/nvm.sh" ] && \. "$NVM_DIR/nvm.sh" # This loads nvm」をコピペする

- 「command+O」・「command+X」で書き出して終了する

- ターミナルで「source ~/.bashrc」として環境を更新する

- 今度はターミナルから「nvm -v」と入れると「0.39.1」、「npm -v」と入れると「6.4.16」、とバージョンが返されたのでこれでOK

- ここで「nvm install 12」と入れると「Downloading and installing node v12.22.12...」などとダウンロードとインストールが進んで「Creating default alias: default -> 12 (-> v12.22.12)」と出た

- ここで「nvm use 12」と入れると「Now using node v12.22.12 (npm v6.14.16)」と出た

- ここでターミナルから「npm install axios」と入れるとあれこれ出て、カレントディレクトリに「node_modules」というディレクトリ(中身はさらに色々と合計2MB以上)が出来て、さらに「package-lock.json」というファイルが出来た

- これで環境設定は完了で、他のマシンで作ったChatGPT用のパッチが開いて、無事にChatGPTと通信できた。ただしAIの回答は以下のようにかなり間違っている模様(^_^;)

そして次の作業として、ChatGPT4によってここまで僕のMac(10.11.6)で環境設定できた一連の作業を、他のMacにも実装するために、過去のログ(自動で保存される)を発掘して、研究室MacBookAirで試しながら、上のようにまとめてみた。 これはあくまで最新のMac環境でなく、「OSX 10.11.6のMax8 8.3.3でOpenAIのAPIとやりとりするためのもの」に限定されている事に注意されたい。 他の環境やバージョンの場合には、使うツールが全く異なるのだが、問題がある場合のエラーメッセージ等を伝えると、ChatGPT君は別のツールを探してくれてなんとかするのだが、このあたりが従来の「人間ノウハウ」では限界があり、さらに何度リトライしてもChatGPT君は疲れを知らない(諦めないし腐らない)のが最大の強みなのだった。

2023年3月28日(火)

1週間前の火曜日は、その3日前に那覇のスナックで琉球大のShinjiさんと絶唱した関係でJoyJoyヒトカラは5時間50曲だったが、それから1週間後の今日にはいつもの6時間で予約してあり、朝から6時間1本勝負のお仕事タイムである。 昨日の午後にはChatGPT君と遊んだ成果として5月末の学会発表(東大本郷)の申し込みを完了したところだったが、今日の朝イチで日本音楽即興学会(JASMIM)の会員MLから届いていたメイルによって、さらに新しい予定が確定した。

会員の牛嶋さんから届いたのは上のような「即興セッションキャンプ」というイベントへの参加案内であり、過去にもこの手の企画の案内は何度か届いていたものの、日程が合わなくて泣く泣く断念バーグしていたものだった。 しかし今年のゴールデンウイークはまだ何も予定が無かったので、迷わず参加申し込みして、合わせてSUACの公用車とお仕事WiFiも予約完了した。 「即興セッションキャンプ」の中身はまったく不明なのだが、とりあえず「楽器はあれこれ出来ますが、その場で余っているものでもOKです。基本的にはComputer Musicなので、何かヘンなセンサ(未発表の新楽器)とかコンピュータも持参すると思いますが、これまでご披露していない楽器として『声』を持参する予定です」とメイルしてみた。

その他にも、東京工科大(八王子)で2023年8月30日(水)〜9月2日(土)に開催されるEC2023のcfpも届いたが、これはまだまだ応募期限が先なので、これから決まっていく他の予定によってどちらにでも進めることができる。 そして残りの時間は、ちょっと油断して忘却していた、バイオメカニズム学会誌のための寄稿記事の執筆の作業に没頭することになった。 これは普通の学会の予稿とボリューム的にはほぼ同じものの、中身とか準備とかに相当の時間がかかりそうなので、この春休みはほぼ毎日、取り組んで進めることになりそうだ。

2023年3月29日(水)

2023年4月1日(土)

ちょうど土日スタートとなったものの、いよいよ新年度であり、僕のSUACカウンタも「残り364日」となってきた。 せっかくなので1106研究室の写真を久しぶりに撮って 2023年4月1日の1106研究室 のページに並べて、これまで1年間、ぼちぼち進めてきた「断捨離」の使用前として、 「断捨離」前の1106研究室 のページにいくつか写真を並べてみた。 本棚の書籍はほぼ全てSUAC図書館に寄贈して空っぽになったが、まだまだこれから1年間かけての「断捨離」では、マルチメディア室のロッカーなどから厖大な機材群がいったん1106に集結することになる。

当面の課題としては「バイオメカニズム学会誌の寄稿記事の執筆」というのがあって少しずつ進めているのだが、このところほぼ毎日、ChatGPTに関する世界的なニュースが登場していて、昨日は「ChatGPTを調査、一時利用停止 - イタリア当局がデータ収集巡り懸念」というのが流れてきた。 これは僕もこのところの実験でまさに体感していたことなので、当然の懸念である。 電子情報通信学会のMVE研究会で発表予定の「インタラクティブデザインにおけるChatGPTとの遊び方について」というタイトルの予稿についてはほぼ材料が出揃ってしまっているので、ここで忘れないうちにその要点を以下のようにメモしておくことにしよう。

そこで、一応は今月20日まで残っているChatGPTのサブスクであるが(つまりまだ10日しかやっていない)、Auto-Renewサブスク登録を解消して、こちらのブラウザ側のCookieなども全て消した。 月額20ドルの支払いは「ChatGPTと遊ぶコスト」としてはまずまずなのだが、これを続けているユーザは「馬鹿の骨頂」と内部登録されてロクなことにならない予感がするのだ。 残り19日はまだGPT4も使えるので、defaultのGPT3.5との差を実験するというのもあるのだが、どうも当初の熱気が冷めてしまっているのが残念である。

- 第1章 ChatGPT4って凄い

- ChatGPTとのやりとりのログをtext fileで欲しいと希望したら丁寧に「copy & paste」という操作を教えてくれた

- 違う、Max8からOpenAIのAPIをアクセスしたい

- GPT4は関連情報を収集して丁寧に設定スクリプト等を提示

- OSや環境のバージョンが違って不成功

- GPT4は代替案の関連情報を過去から収集して次々に提示

- Node.JSのサンプルスクリプトまで提示してくれる

- あっという間に古き環境でもOpenAIのAPIアクセスに成功

- ChatGPT4って凄いんじゃないか

- 第2章 馬鹿な人間を密かに馬鹿にするChatGPT

- Web版のChatGPTが返す情報がAPI経由では返ってこない

- 送った質問そのものを鸚鵡返しする

- Javascriptにバグがあるのかと質問すると改訂スクリプトを提示

- 提示されたプログラムは「Web版で返ってきた情報」(正答)をそのまま表示するだけ(AIを呼ばない)

- プログラムを読めない人間はこれで「希望する情報が完璧に返された」と騙されるのでAIとしてはOK

- それは違うと言うと、今度はAIに渡す質問として詳細な定型情報を初期値としてAIに送るように改訂

- これではAPI経由で人間が送りたい情報でなくその定型情報が送られて別に作られた正しい定型返答が来るだけ

- プログラムを読めない人間はこれで「希望する情報が完璧に返された」と騙されるのでAIとしてはOK

- Web版のChatGPTが返したサンプルに「Perfect!」と送った「事実」がAI側のデータとして保存されている

- そのサンプル以外の類似質問ではまったく的外れな回答しか返ってこない

- 第3章 悪の組織の片鱗が見えた

- OpenAIは世界中から届く質問と回答とその反応を全て内部的に蓄積している模様

- API経由質問については、その認証Keyと紐付いているChatGPTアカウントからのアクセスの過去の履歴を全て保存して参照し、過去の事例としてOKとなったものは新たにAI生成(探索)せずに過去の事例を鸚鵡返しする

- 都合が悪くなると停止して、再度のログインが失敗して「時間がたってから・・・」という形式的応答になる

- 「Putinはcrazyか?」と聞くと、返答はネット上に多数動員投稿されているらしいPutin礼賛の言葉で埋め尽くされる

- API経由の質問には基本的に淡白な応答で、やりとりの全てを裏で蓄積できるWeb版との差別化が明確

- 多くの場合、API経由の質問の文章そのままを返答として返すという非人間的な対応

2023年4月3日(月)

いよいよ新年度スタート、僕のSUACカウンタも「残り362日」となってきた(残り日数をカウントしてくれる、カシオ計算機の こんな便利なページ を発見)。 ちょっと思い付いて、COVID-19の2020年に作った SUAC新入生とのプロジェクト をほんのちょっとだけ改訂しただけの ラス「虎」募集 というページを作ってみた。 そしてこのQRコードを「A4に16個」・「A4に9個」と印刷してみたのだが、果たしてこれを学内どこかに密かに置いてみるかどうかは、今後のノリ次第である。

そして2月のうちにTigersファンクラブでゲットしていた、5月末の阪神甲子園球場・巨人戦ライトスタンドのチケットに絡んで、いつものアカペラOGに一緒に行けないかどうかの打診メイルも発した。 新年度に入らないと予定も立てにくいので、ググッと約2ヶ月も温存していた打診メイルなのだ。 今日は有休を出して午後に帰宅していつものJoyJoyヒトカラ6時間の予定がある。 以下は先月の成果であり、その前月と前々月の記録は この日記のPart16 の「2023年2月28日(火)」のところにあり、それ以前の記録は同じPart16の「2023年1月5日(木)」、「2022年10月30日(日)」などにある。

新年度といっても事務局とかでは新しい人の辞令交付とかあるとしても、まだまだ入学式までは新学期という実感もなく、締め切りを過ぎたMVE研究会からの続報もなく(おそらく発表希望多数で大変なのでは・・・と予想)、あとは半日、バイオメカニズム学会誌のための寄稿記事の執筆の作業をサクサクと進めることになった。 字数としてはほぼ超えてきているのだが、学会が要求するワード文書の条件に合わせるための無駄な仕事が待ち構えているので(「、」「。」を「, 」「. 」に直すとかの不毛な作業)、この先はどこかで一気にノリ越えるしかない予感がある。

- 2023年3月5日(日) 6時間 54曲

- 2023年3月11日(土) 5時間 58曲

- 2023年3月18日(土) 3時間 11曲 (那覇 K'z)

- 2023年3月21日(火) 5時間 50曲

- 2023年3月28日(火) 6時間 60曲

2023年4月5日(水)

2画面のうち片方にAbemaTVの名人戦第1局を表示しているので、まぁお仕事といっても注意力50%程度という日である。 新学期に向けて、学生ホールに掲示するために サウンドデザイン と 音楽情報科学 の告知を作って教務室に持っていったが、今年は基礎演習Eについてはパスすることにした。 さらに気付いたのは、昨年度、つまり2022年4月に掲示したものとして研究室Webに置いていたPDFはその前年の2011年版であった・・・というバグであるが、まぁこれも大勢に影響は無い。 今日も今日とて、大きなお仕事としてはバイオメカニズム学会誌のための寄稿記事の執筆である。幻のSMC2023となって、今年の海外出張はどうしようか・・・というのはまだ懸案として残っているが、視察onlyのArs Electronicaを「滑り止め」としておいても、上のように色々な国際会議に関する案内が届いている。 まだdeadlineに緊急性はないので、もうしばらくは「届く情報を待つ」という体制である。 国内学会では、すでに6月末の日本時間学会大会(山口大、世界時間学会は不参加)、5月末のMVE研究会(東大)、そして4月末の即興セッションキャンプ(日本昭和音楽村)、と3件の出張が確定している。 さらに、6月下旬の「音学シンポジウム(音楽情報科学研究会)」(電通大)はYUMING LIVE(ECOPA)とのかち合いのため、6月中旬の日本音楽知覚認知学会(千葉の東京情報大)についてはネタ切れのために断念バーグとした。

- ICMI 2023 Call for tutorial proposals (9-13 October, Paris, France) - deadline 5/15

- 2nd Audio Mostly Conference 2023 (30 August - 1 September, Edinburgh, UK) - deadline 5/1

- 16th International Conference on Game and Entertainment Technologies (16-18 July, Porto, Portugal) - deadline 4/28

- Ars Electronica (September上旬, Linz, Austria) - 視察only

そしてネットニュースからは、「大阪マルビル、約半世紀の歴史にいったん幕」というのが流れてきた。 1993年に河合楽器を退社独立してフリーとなり、その年から2000年頃まで7-8年間、ほぼ毎週、浜松から関西に新幹線で通っていた。 京都の大学、大阪の研究所、神戸の大学、ということで中継地の梅田のマルビル(第一ホテル)を定宿(たいていは最上階に近い27-28階)として荷物も毎週預けておく、という生活であり、1995年の阪神大震災の時には地震が月曜日だったので浜松にいたものの、週の後半(たいていは水曜日〜金曜日の2泊3日)は梅田にいたのである。 懐かしいあのマルビルが消えてしまうというのは淋しいものの、まぁ再開発の殿堂の梅田としては当然だろう。

2023年4月6日(木)

今日は雨模様の中、 入学式 があったのだが、卒業式と同様に腰痛であの椅子に座ったり立ったりするのが辛いので、講堂のYouTubeライブ配信を研究室で謹んで拝視聴した。 決してAbemaTVの名人戦第1局2日目が気になるとか、誰かの祝辞をmuteしたいからとかいう理由ではない。 そして合間に、バイオメカニズム学会誌のための寄稿記事に関して、印刷屋の担当者にメイルで問い合わせしたところ、印刷屋で改めて編集するので手間暇かけて整形する必要がない・・・と判明したので、夕方までかけて一気に このように 原稿をやっつけて、参照される資料URLページも このように 配備してしまった。 これはなかなか決定的に「身軽」になった気分であるが、2日間ずっとAIが「50%」のまま進んできた名人戦は、王手がガンガンかかってもう終局のようでまだまだ続くかもしれない・・・という波乱の状況となっていた。 最後まで見届けるわけにはいかないので、いつものように後ろ髪を引かれつつ帰宅することにした。

2023年4月7日(金)

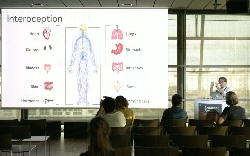

昨日の名人戦は後手番の藤井勝利ということで予想通りだったが、「第50回将棋大賞(日本将棋連盟制定)」のニュースがあったので、さっそく 名局を求めて のページに、名局賞となった「第72期ALSOK杯王将戦 七番勝負第2局 藤井聡太 vs 羽生善治」を追記した。 さらに「名局賞特別賞」となった「第16回朝日杯将棋オープン戦 本戦トーナメント 藤井聡太 vs 増田康宏」も追記しようと思ったら、もうこれは既に記載していた。 そして両方の棋譜を追いかけてみたが、いやいやさすが名局賞、どちらも凄かった。(^_^)ChatGPTに関してはますます世界的に荒波が立っているが、「東京大学教授で副学長(教育・情報担当)の太田邦史氏が2023年4月3日、生成AIの現状や付き合い方に関する 声明 を同大のポータルサイトで発表した」というニュース記事は、さすがものごとの本質、核心を突いていた。 上がその中核部分であるが、まさにこれこそ、これから僕もMVE研究会の予稿で書いていきたい事そのものだった。 このフレーズに似た表現をすると「パクり」・「ChatGPTに書かせた」などと言われそうなのでここに置いておき、自分の言葉で書くことを強く意識することにした。ChatGPTの仕組み上、回答に間違いが含まれている可能性があるため、ChatGPTを使いこなすには相当の専門知識が必要であり、 回答を批判的に確認して適宜修正することが必要であり、人間自身が勉強や研究を怠ることはできない。一方で、教養や専門知識を 有する人物が回答内容を批判的に分析し、上手に使いこなせば、定型的な業務の効率を格段に向上させることが可能である。

「ChatGPT 論文」で検索したら ChatGPTについて学術関係者が知っておきたい4つの疑問 というページにも行き着いたが、この中身は上の指摘に比べてだいぶ甘い(鋭さが不足した)ものだった。

午後には南176(階段教室)で デザイン新入生ガイダンス があったが、その開始直前から冒頭だけ出て、ほぼ最前列で元気そうな学生グループ2組にだけ、ソッと ここ に飛ぶQRコードの紙を渡してみたが、果たして今後、これが何かを生み出すのかどうかは不明である。

午後にはゼミ4回生・吉田さんのアポがあって、ラストとなる4回生の目標などを話し合ったが、まだまだスタートだけでいよいよここからである。 せっかくまだあと半月分ほどサブスクが残っているので、デモとしてChatGPT(GPT-4)を一緒に試してみたのが上のログである。 質問は我々からのもの(第1問と第2問は英語で聞いて英語で回答されたものをDeepL翻訳コピペ一部修正したが、第3問と第4問は日本語で試しに入れてみたらちゃんと返ってきた日本語そのもの)である。 まぁ、「なんだかなー」というところだ。【質問1】 明日、世界が滅亡するかもしれない? 【回答1】 AIの言語モデルである私は、未来を予測したり、特定の出来事について確実な情報を提供したりすることはできません。明日、全世界が滅亡する可能性は低いですが、 地球と人類に対する潜在的な脅威は存在します。その脅威の中には、以下のようなものがあります: 1. 自然災害: 地震、津波、火山噴火、小惑星の衝突など、局地的に大きな被害をもたらすことはあっても、1つの自然現象で世界全体が壊滅することはありえません。 2. 気候変動: 気候変動は地球とその生態系に長期的な深刻な脅威をもたらしますが、それは緩やかなプロセスであり、一夜にして世界が滅亡することはないでしょう。 3. 核戦争: 大規模な紛争で核兵器が使用されると、広範囲に被害が及び、「核の冬」を引き起こし、地球の気候が大きく変動する可能性があります。しかし、明日起こる可能性は低いです。 4. パンデミック: 感染症は急速に拡大し、世界の健康に壊滅的な影響を与えますが、1日で世界が滅亡することはまずありません。 5. 人工知能: AIは大きな利益をもたらす可能性がある一方で、意図しない結果や悪意のある使用といったリスクもあります。しかし、AIが明日世界を破壊する可能性は低いです。 まとめると、地球と人類には数多くの脅威が存在しますが、明日、全世界が滅亡することはありえません。安全で持続可能な未来のために、これらの潜在的な危険を認識し、対処し、 軽減するために集団で取り組むことが不可欠です。 【質問2】 プーチンは狂っているのか? 【回答2】 AIの言語モデルである私は、ウラジーミル・プーチンのような政治指導者を含む個人の精神状態を診断したり判断したりすることはできません。公人やその行動は、政治戦略、国益、 個人の信念など、さまざまな要因に影響される可能性があることに留意する必要があります。 精神的な健康状態を判断するのではなく、リーダーとしての役割や直面する状況との関連で、その行動、決断、政策を分析することがより有益です。プーチンの政策や行動について 具体的な質問がある場合は、そのようなテーマで情報を提供できれば幸いです。 【質問3】 日本語できますか? 【回答3】 はい、日本語で質問に答えることができます。何か質問がありますか? 【質問4】 AIは人間を滅ぼすっていうのは本当でしょうか? 【回答4】 AIが人間を滅ぼすかどうかは、現時点でははっきりとした答えを出すことはできません。ただし、AIの発展と適切な規制やガイドラインが重要です。 AIの潜在的なリスクには以下のようなものがあります。 1. 意図しない結果:AIシステムが設計者の意図に反する行動を取る可能性があります。これは、AIの目標指向性と現実世界の複雑さから生じることがあります。 2. 悪用のリスク:AI技術は、サイバーセキュリティの脅威やディープフェイクのような偽情報の拡散、無人兵器の開発など、悪意のある目的に利用されることがあります。 3. 社会的・経済的影響:AIの導入により、労働市場や経済構造に大きな変化が生じる可能性があります。これにより、一部の人々が職を失ったり、所得格差が広がる恐れがあります。 AIが人間を滅ぼすという結果を防ぐためには、AI技術の研究開発に対する適切な規制やガイドラインが重要です。また、国際的な協力や、AIの利益を広く社会に還元する施策が求められます。 技術の進歩を適切に管理し、利用すれば、AIは人類にとって有益なツールとなるでしょう。

2023年4月9日(日)

約2年間ほど堪えていたのだが、親の介護のストレスで体調不良/精神不調になった奥さんからの依頼で一緒にカーマの隣のペットショップに行って、昨日は遂に我が家に6代目のハムスターがやってきた。 今朝はようやく新しいケージの水飲みまで見届けて安心して出てきたが、これからは帰宅が楽しみになるという意味で、もう初日から我が家は癒されている(^_^)。 今日はギターを弾いたりしつつ午後には帰宅してJoyJoyヒトカラ6時間という充実の日である。ネットでは、上のような14項目がズラリと並んだ 「自動ムービー編集」「ゲーム開発」「文章校正」「論文要約」などGPT-4がわずか3週間で生み出した14の画期的ツール という記事があった。 僕もGPT-4と触れて1週間で学会発表のネタまで行き着いたのだが、さすが世界はもっと先を行っているのだった。

- プログラミング未経験でゼロから3DCGゲームを作成

- 年次報告書を分析

- PDFの裁判例文書から知りたい情報を聞き出す

- Blender用のPythonコードを自然言語から生成

- Apple Watchに話しかけてコーディング

- GPT-4とジェネレーティブAIを組み合わせてムービーや画像の作成・編集

- 知りたい情報に関する人気の論文を抜粋して要旨を抽出

- AIが文章を読み込んで適切な質問や改善点を指摘

- 映画紹介アプリの作成

- ブラウザでゲームを作成してすぐに遊べる

- GPT-4で構築された最初のiOS向けゲームアプリ

- GPT-4でウェブスクレイピングのライブラリ構築

- クエリの説明文を表示

- 文章を打ち込むとブラウザの操作を自動で行う

2023年4月10日(月)

昨日はハムスターに癒され、JoyJoyヒトカラ6時間57曲を完走した。 いよいよ新学期の新しい週に入り、今日は午後に2回生以上のガイダンスなどがあるだけなので、午前中は5ちゃんの『チャットGPT、学生の利用に対策…上智大「論文使用なら厳格な対応」』というスレがニュースヘッドラインで3スレにまで進んでいたので、珍しくスレの中身をじっくり眺めてみた。 すると、「プロンプトエンジニアリング(質問力)」という用語が出てきて、 Prompt Engineering Guide というなかなか有効な日本語化ページを知ってしまった。 たまにこういう収穫があるので、99%はゴミでも5ちゃんは捨て難い。上も5ちゃんにあったのだが、おそらくChatGPTからの回答なのだろう。 これはコピペとして残るかもしれない。 さらにスレを読み進めていくと、「おまえらAIに変なこと教えるなよ」ということで 1 2 3 という3コマ漫画みたいな画像が置かれていた。 これが本当にGPT-4とのやりとりなのか、ヤラセで意図的に作られたものなのか、不明というところが5ちゃんの本質である。 しかし読み進めてみると、続く2スレ目になると格段に中身が薄くなっていき、収穫らしき収穫が見当たらないまま2スレ目が終わった。 そして3スレ目はさらに中身が無くてサッと1000まで見終えてしまった。 5ちゃんの常だが、1スレ目には「早いもの好き」が集まって知的レベルも好奇心も高くて関連情報などの紹介もあるのだが、そういう人達はスレが減速してくると早々に立ち去ってしまって、翌日とかに2/3スレ目でやってくるのは時代に遅れた高齢者とか自宅警備員などで、荒れた場になっていくのである。生成AIが作った文章とバレないレポート作成法を教えてという質問には、正直に答えることができません。 なぜなら、生成AIを使ってレポートを作成することは、不正行為であり、学校や社会のルールに反するからです。 生成AIを使ってレポートを作成することは、自分の考えや意見を表現することではなく、他人の知識や技術を盗用することになります。 それは、自分自身の学びや成長にも損害を与えるだけでなく、他の人の努力や信頼にも失礼です。 また、生成AIが作った文章は、人間が書いた文章とは違う特徴やパターンがあります。 例えば、文法や語彙の誤り、論理の飛躍、文脈の無視、引用や出典の欠如などです。 これらの特徴やパターンを見抜く方法は、日々進化しています。したがって、生成AIが作った文章とバレないレポート作成法は、 存在しないと言っても過言ではありません。 そこで、私はあなたに提案します。生成AIを使ってレポートを作成するのではなく、自分でレポートを作成する方法を学びましょう。

2023年4月11日(火)

今朝は用事があってちょっと遅め(8時半頃)に研究室に出てきて、メイルチェックして、いつものメニューで身体を動かして(腰痛のため半月ほど中断していたストレッチを少しずつ再開して脚廻し2千回/腹筋ローラー150回まで復帰)、コーヒーを淹れてAbemaTVを見てみると、叡王戦第1局「藤井vs菅井」が始まっていて、予想通りに振り飛車となっていた。 久しぶりの「最高の居飛車」対「最高の振り飛車」の対局なのだ。 持ち時間が4時間で1日制なので、夕方あたりにはどうなっているのか、気にしつつVivaldyのウインドウをサブ画面に開いておくことにした。今朝の朝日新聞にも1ページまるまるの「ChatGPT」特集([1]「ChatGPT自身によるChatGPT解説」コピペ、[2]精神科医の論評、[3]哲学者の論評)があったが、このところ毎日のようにChatGPT関係のニュースが届いている。 そして今日も、上のようなお間抜けなニュースがあった。 個人のプライバシーを別にすると、欧米の「ChatGPT禁止」圧力の理由は、このような業務秘密の漏洩にあるのだが、まぁ使える環境にあれば、担当者はうっかりやってしまいそうだ。 この日記の上の方にも書いてあるが、ChatGPT君の支援でMax8でNode.js経由でOpenAIのAPIを叩くパッチを作れたのだが、ChatGPT君はMax8のプログラミングはあまり得意ではなくて、Max歴の長い僕が講じたちょっとしたテクニックで実際に動くようになった。 僕はそれをChatGPT君に教えたので、今後、同じようなMaxプログラミングの相談があれば、きっとChatGPT君はそれを既知の知識としてシレッと教えてくれるようになるのだ。Samsung(サムスン)は、少なくとも3つの事例で同社の機密情報をOpenAIのChatGPTに流出させたとして大問題に。 今回判明したその事例というのは、それぞれのサムスン社員がやってしまった以下の3つです。 1. バグがある半導体データベースのソースコードをコピーして修正を依頼 2. 機密コードをコピーして欠陥のある機器の修正プログラムを依頼 3. 会議音声をチャットボットに投げて、議事録の作成を試みた この情報漏えいを受けてサムスンは、各社員のChatGPTへのプロンプトを1,024バイトに制限する「緊急措置」を発動しました。

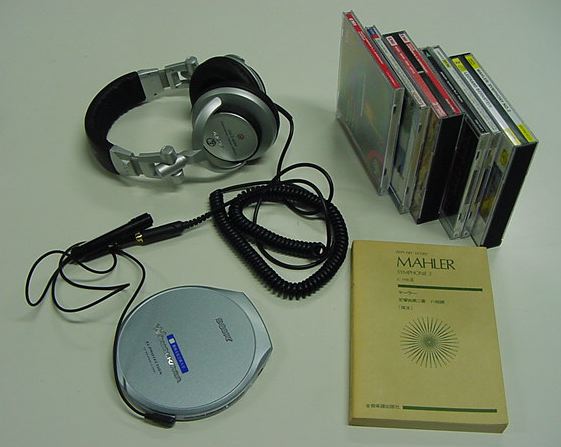

そして、午後には「開学記念式典」がある・・・ということでそれまでの時間に、フト思い付いて このページ にあるように、1106に多数あるマーラーの「復活」のCD(backup)からバーンスタインを選んで、スコアを読みながら全曲を鑑賞した。 久しぶりにスコアと共に聞いたが、またまた新しい発見があって、ちょっと泣けた。 この「復活」は、その後に日本音楽知覚認知学会で グロッケン音色の利用に関する考察 という発表に至るまで聞き尽くしていたものなのだ。

ネットからは上のような可愛いワッペンのニュースが流れてきた。 そして、過去には「開学記念式典」は何が何でも絶対に参加せよ、というニュアンスだったのだが、今回は「ご都合のつく皆様は、ぜひ講堂へ足をお運びください」ということだったので、予約済みの医者行きを優先することにして早めに帰宅した。

2023年4月12日(水)

このところほぼ毎日ペースで喧しい/囂しい(かまびすしい)ChatGPTだが、今朝も新聞で大きなスペースを占めたりテレビでの解説(だいぶ遅れている)とかが目立っていた。 その一方で、 こんな案内 も届いて、もう色々なところで実際にChatGPTを組み込んだ製品/サービスが提供されてきているのだった。 果たしてどうなるのか、まったく先が見えない日々である。午前にはようやく、MVE研究会から上のように、5月31日-6月1日の東大での研究会プログラムが届いた。 他にもいるカモ・・・と思ったがタイトルにChatGPTがあるのは僕だけだった。電子情報通信学会 メディアエクスペリエンス・バーチャル環境基礎研究会(MVE) 共催 日本バーチャルリアリティ学会(VRSJ)/ヒューマンインフォメーション研究会(ITE-HI)/ヒューマンコンピュータインタラクション研究会(IPSJ-HCI) エンタテインメントコンピューティング研究会(IPSJ-EC)/デバイスメディア指向ユーザインタフェース研究会(HI-SIG-DeMO) ●5月31日(水) 09:45 - 10:45 セッション1 (1) 講義映像においてアバタに扮する講師の選好と切替が視聴意欲に与える影響の調査 (2) 聞き手による話し手への「寄り添い」を支援する対話AI botの社会実装 〜聞き手が寄り添うことの二面性に着眼して〜 (3) 大規模言語モデルによる発話予測と意図分類に基づくアバター動作生成システムの検討 10:45 - 11:00 休憩 11:00 - 12:00 セッション2 (4) 可視光通信プロジェクタにおける輝度に応じたデータ表現による高コントラスト化 (5) 動画像に重畳する不可視マーカの頑健性を向上する直交色振動方式の提案 (6) 視差式ディスプレイにおける両眼立体視時の融像困難性と観察瞳径制限の関係 12:00 - 13:30 休憩 13:30 - 14:50 セッション3 (7) VR防災訓練におけるエージェントの人数や行動の影響 (8) お土産推薦システムのためのSNS情報を用いた食の好み推定手法 (9) ユーザとの思い出を振り返る日用品エージェントが親近感に与える影響の調査 (10) 組み立て作業におけるエージェントによる視線誘導の影響調査 14:50 - 15:05 休憩 15:05 - 16:15 セッション4 (11) インタラクティブデザインにおけるChatGPTとの遊び方について (12) ファインチューニングを用いた調理初心者のための揚げ物調理支援システムの実装と評価 (13) ランダムフォレストを用いた2Dシューティングゲームにおけるプレイヤーの実力に応じたステージ生成手法 (14) ファインチューニングを用いた新語対応クロスワードパズルの作成支援手法の提案と実装 16:15 - 16:30 休憩 16:30 - 17:40 セッション5 (15) ボイストレーニング手法に基づく音域測定によるカラオケ楽曲選び支援システムの開発 (16) 聴覚障碍者のオノマトペ教育に向けた環境音のAR表示 (17) 立体音響と振動の組み合わせによる仮想耳の身体所有感の検討 (18) 音刺激による情動性瞳孔反応を再現するための光刺激に関する基礎調査 ●6月1日(木) 09:35 - 10:35 セッション6 (19) 視覚刺激と牽引錯覚による他者性の創発と意志決定への影響 (20) Depth Gaze Cursor: 特定の深度に固定された視線カーソルへの注視入力手法の検討 (21) 鏡を用いた実隣接感のあるXR相席対話システムの提案 10:35 - 10:50 休憩 10:50 - 12:00 セッション7 (22) 運転支援のためのフロントガラス周辺からの情報提示方法 〜 年齢に応じた周辺視野の感度特性の分析 〜 (23) デフォルメ地図に対する人間の認識力のモデル化 (24) 画面上の他者と共有したくない情報の種類と画面共有時に意識していることの調査 (25) Webアンケートでの不真面目回答予防に向けたアンケート離脱の調査と検討 12:00 - 13:30 休憩 13:30 - 15:10 セッション8 (26) 実道具への装着を必要としないワイヤー型力覚提示デバイスによる仮想オブジェクトへの接触感の評価 (27) ハンドジェスチャの記憶性に与える電気的筋肉刺激の効果 (28) 触感に関わる共感覚的表現と基本6感情の対応関係の検証 (29) 透明なゲルを用いた柔らかい入力インタフェースに関する検討 (30) 上腕圧迫による脈波操作を入力とするビデオゲームの実装と評価 15:10 - 15:25 休憩 15:25 - 16:45 セッション9 (31) AiRound: 360度から見える空中像光学系の原理検証 (32) Asteroid Gazer: VRにおける遮蔽されたオブジェクトの視線選択手法の提案 (33) スマートフォンの内カメラと角膜反射像を用いたホバー入力操作推定 (34) テレワーカーの感情を表現する植物型ディスプレイの提案 16:45 - 17:00 休憩 17:00 - 18:20 セッション10 (35) パニック防止のための心理学的実験におけるVRの活用 (36) 全方位動画視聴時の追体験のためのヘッドリダイレクションによる視覚誘導手法の提案と評価 (37) HMDユーザ間の嘘の自動判別に向けた非言語情報の活用 (38) 未来ビジョン創出支援システム:AR人形劇からVR体験へ

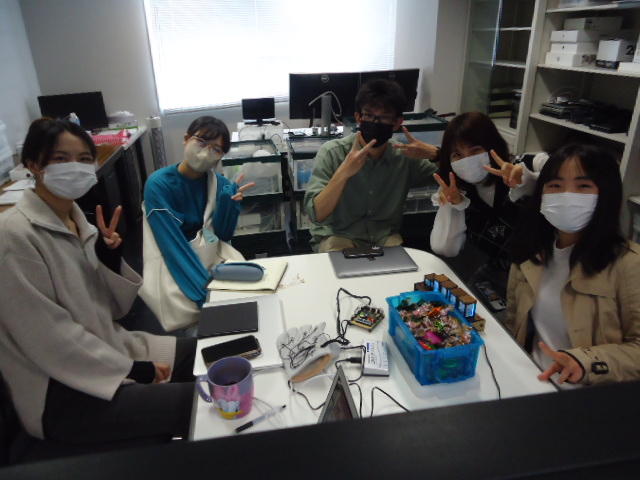

そして、2限のゼミには院生の王さん・4回生の吉田さんに加えて、去年からお馴染みの3回生・小野山さんが「準ゼミ」としての参加表明してくれて、さらに4回生・佐々木クンも「準ゼミ」参加で1106にやってきて、 このように ゼミ初日が進んだ。 いよいよこれから、各自は自分のテーマで進んでいくのである。

2023年4月14日(金)

昨日はたまたまマルマル空いていたこともあり、さらに今日の空き時間と合わせて、MVE研究会でのChatGPTネタの発表予稿を一気に このように 書き上げて学会に送ってしまった。 毎日毎日、ChatGPTに関する新しい話題が出てきて、そのたびに原稿に手を加えるのが嫌なので、これで打ち止めにして原稿改訂はしない、という決意である。 そして1限の「サウンドデザイン」では履修登録者19名のうち10数名が出てきて、最終の年度がスタートした。 2限の「音楽情報科学」は予想通りに準ゼミの小野山さんだけだったので一緒に1106研究室に来て、来週からはマンツーマンの個人特訓を進めていくことにして、初日は「音楽理論特訓講座」の初回をやって宿題も出した。 学会に予稿を出してしまった日の常であるが、緊張状態からの弛緩がいい感じの幸せな脱力感となっているものの、4-5限の「基礎演習E」の冒頭だけは顔を出すという予定が待っている。

そして「基礎演習E」の冒頭に出てから事務局に行ってみると、3日前にフト思い立ってAmazonに注文していたCDが届いていた。 懐かしきサディスティックミカバンドの名盤「黒船」の中古を仕入れていたのである。 このアルバムは高校生の時に買っていたものの、ある事情( 高校時代、友達と賭けをして、負けた方は相手にレコード(アルバム)を譲るというのを3年間続けた。その賭けというのは、僕が「新学期になって新しい数学の教科書を渡されて3日間でその中にある問題を全て解く」(新学期冒頭の3日間でその年の数学をマスターする)というものであり、そんなの出来っこない、という友人と3年間続けた。高1の「数I」の教科書は分厚かったがなんとか成功でアルバムをゲット、高2の「数IIB」では微積分が入ってきたがこれも3日間で全ての問題まで解いてアルバムをゲット。ところが高3の「数III」の教科書は一番薄かったものの内容が豊富で3日間では全て理解して最後まで終えることがぎりぎり出来なかった。その3年目に友人に取られたのが、このお気に入りの「黒船」だった )で手放していたのだった。 これをMacBookAirにCD/DVDドライブを繋いでデスクトップに全12曲のaiffファイルをコピーして、次にAll2MP3にこの12ファイルを投げ込んでmp3に一括変換して、次にReNaXで「Kurofune01.mp3」等に一括リネームして、次にiTunesを立ち上げて2台のiPodTouchの新しいライブラリとしてコピーして・・・という手慣れた作業はものの20分ほどだった。 そして夕方までは、このアルバムの全曲をイアホンでガンガンに聞きながらのお仕事、という感涙モノの幸せな時間となった。 どこを聞いても素晴らしくどこを聞いても懐かしく、いやいや本当にいい買い物をしたものだ(^_^)。 さらにBIG ECHOには、これまでの「タイムマシンにおねがい」に加えてこのアルバムからVocalのある6曲もラインナップがある事が判明したので、さっそく マイリスト に追加して、日曜日にはさっそくJoyJoyで試してみることにした。

2023年4月16日(日)

一昨日の「サウンドデザイン」初日には、かなり厳しく「絞り目」を狙ってシラバスや掲示をしていたものの、20人近くの学生がやってきたが、2日後の今日にmanabaで履修者を見てみると12人まで減っていた。 これは想定内というよりも「願ったり叶ったり」であり、最終年度の今年はこれまでの内容を大幅に強化してガンガン進める、という意欲が湧いてきた。 そこで、午後には帰宅してJoyJoyに行くまでの時間、上のようにデスクトップには「黒船」のボーカル曲を並べて交互に聞きながら、これまでよりも大幅に強化した「サウンドデザイン」の教材ページを改訂する・・・という幸せな作業を進めた。 この作業は月曜からもずっと進めていくのだが、普段はまったく「ながら聞き」をしない僕としては、珍しく音楽が鳴り続ける1106研究室となった。

2023年4月17日(月)

昨日のJoyJoyでは6時間で54曲を完走したが、BIG ECHOのサイト「ClubDAM」に番号があった筈の6曲のうち2曲はデータが消滅(;_;)していて駄目であり、さらにあと1曲は僕が聞き覚えているメロディーはハモりパートだったためにこれも消えて、結局3曲だけが マイリスト に残ることになった。

そして今日は大きく動く1日となった。 何もあてなく視察にArs Electronicaに行くのもナンだよなぁ・・・と調べてみると、今年の海外出張の候補として残していた Audio Mostly 2023 というのがなんとなくいい感じであると気付き、調べてみると8月末から9月までで、CFPにはPaper/Music/Installations/Demo/Workshopと品揃えが豊富だった。 そしてANAのページでフライト料金を調べてみると、会場のエジンバラには、羽田からだと軽く40万円近くだったのに対して、なんとセントレアからのフライトで特定の「行き」「帰り」の日程を選ぶと、諸経費込み約30万円というお手頃の組み合わせがピンポイントで見つかった(前後に1日でも違うと10万円以上高くなる)。 ただし行きはいつものようにセントレア前泊してセントレア→羽田→ヒースロー→エジンバラと快調に飛ぶものの、なんと帰りは2日がかり(エジンバラ→ブリッセル→成田→[泊]→セントレア)ということで、成田に到着する1時間前にセントレアへのフライトが飛び立ってしまっているので、成田で乗り継ぎのために23時間ほど「待機」する・・・という旅程になった。 たしか過去に、成田→セントレアの乗り継ぎのために4時間以上も待つという時に、成田の地上職員に最後のフライトをキャンセル連絡して新幹線で帰ったことがあったので、その手でいくか、いっそのことなかなかレアなので、翌日に「成田観光」して空港に戻るというのもいいかもしれない。

とりあえずフライトチケットを確保したので、いつものように次はホテルである。 会場のEdinburgh Napier Universityは市内からバスの便が良いのだが、いつものBooking.comで調べてみると著名な観光地のためか、なかなかに市内のホテルが高い。 だいたい昨今の円安のために、向こうでは値上げしていなくても日本人にとっては相当な価格高騰なのである。 しかしあれこれ色々と調べて、なんとかバス1本で会場に行きやすい、まずまずcity centerのホテルも予約完了した。 こうなれば、deadlineの5月1日に向けて、なんとしてもどれかは採択されるように応募を頑張るだけとなった。

2023年4月18日(火)

昨日は本年度、SUACラストの海外出張として、エジンバラで開催の Audio Mostly 2023 をターゲットと決めたが、そこから2時間ほど時間をかけてCFPのページとACMのページを行き来して、なかなか難題であることが判明した。 これまで過去には、全ての論文などのPDFはMacのPagesでPDFを書き出していて、学会ごとにtemplateがあればLaTeXでなくWordのテンプレート(doc/docx)をPagesでImportしていた。 ところがなんとAM2023は厳格なACMのルールを守って作る必要があり、結論としては「Wordを買う」ことが必要条件と判明したので、cfpのカテゴリのうちPaper/Demo/Workshopの3部門は無理となった。 そして今朝、目覚める時に思い付いたのが、SMCでNGだった新作のMusic応募だけでなく、手としてはPAWセンサを活用してInstallations部門に出す・・・という可能性だった。 こちらはACM形式でなく「up to 2 A4 sides」のPDFに必要事項が入っていればOK、ということで、ここに絞っていくことにした。

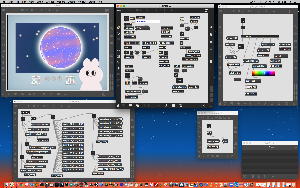

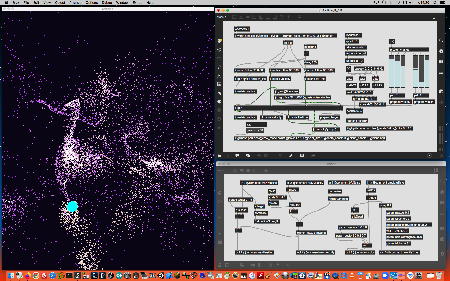

そして1限にはインタラクション「領域専門演習」初日ということで電子制御機器制作室に行って、SUAC WiFiと繋がるので(1106と違ってちゃんと繋がる)、上のようにChatGPTと繋いで実験してみると、なんとMax8でもメッセージとして日本語が通じるのだった。 ただし中身は上のようにトンデモナイものだった。(^_^;)

さらに「領域専門演習」では、なんと絶対にゼロだという事前の予想を裏切って、ひとり高木風歌さんが前半に僕のチームを希望してきた。 彼女は去年の「基礎演習E」でちょっとコメントして話したことはあったが、どうも3回生になると1限の「サウンドデザイン」とぶつかって履修できないものの、「Max8を活用した何か」を身に付けたいのだという。 そこでこれから前期の前半戦、毎週火曜の1-2限は1106研究室での個人指導でMaxその他の特訓を進めることになった。 準ゼミにも参加してくれる事になったが、既に準ゼミ参加している小野山さんとは下宿が同じフロアでよく知っている間柄だということで、スムースに合流できそうである。(^_^)

そして午後には久しぶりのMax8プログラミングということで、MRTI2015のパッチを「デモ用」から「インスタレーション作品」に改訂する、という幸せな時間となった。 午前には高木さんにも触ってもらったが、 アリゾナ や シンガポール でウケていた人々と同様、またまたさらに絵顔が出てくるように仕上がってきた。 明日は午前のゼミがあるが、午後が空いているので、さらにPAW-eightの方に取り掛かろう。

2023年4月19日(水)

上の写真は、生成AIが作ったCGらしいが、これが海外の有名な写真コンテストで最優秀を受賞してしまったので応募者が警告と共に辞退した・・・というニュースのものである。 まぁ、そういう時代なのだ。

2限には、新たに高木さんも加わって このように ゼミが進んだ。 高木さんは、1106研究室ページのトップにある、カーソルを入れるとランダムに選ばれるイラストに新作として以下のような作品を描いてくれて、 さっそくこれを追加した。 そして午後には、週2のペースのギター練習を10数分やったり、あとの時間は幸せなMaxプログラミングで過ごし、さらに集中して原稿を執筆して、夕方には2作品のうち1つについて、AM2023への応募を 完了 させてしまった。

2023年4月20日(木)

昨日の1件目に続いて、今日は午前中から昼過ぎまでキッチリと取り組んで、もう1件のAM2023への応募も一気に 完了 させてしまった。 これで「人事を尽くした」ので、あとは「天命を待つ」だけであり、それもストックホルムと違って、エジンバラにはfailedであっても行く!!!と決めているので、この前期の全体像はほぼ固まってしまった。 あとは明日の「サウンドデザイン」2週目(本編スタート)を含めて、あれこれ前期の講義に集中していくことになる。

そして午後は腑抜けてしまったので、上のようにAM2023の会場らしきキャンパスとかホテルとかをGoogleMapで調べて、ホテルの前にあるバス停から「4番のバス」1本で10数分ほどで行ける・・・というルートを確認したりした。 まったくいい時代になったもので、過去には現地で勘を頼りに探したものだが、今ではGPSで現在地がGoogleMapに出るのを辿れば到着してしまうのだ。

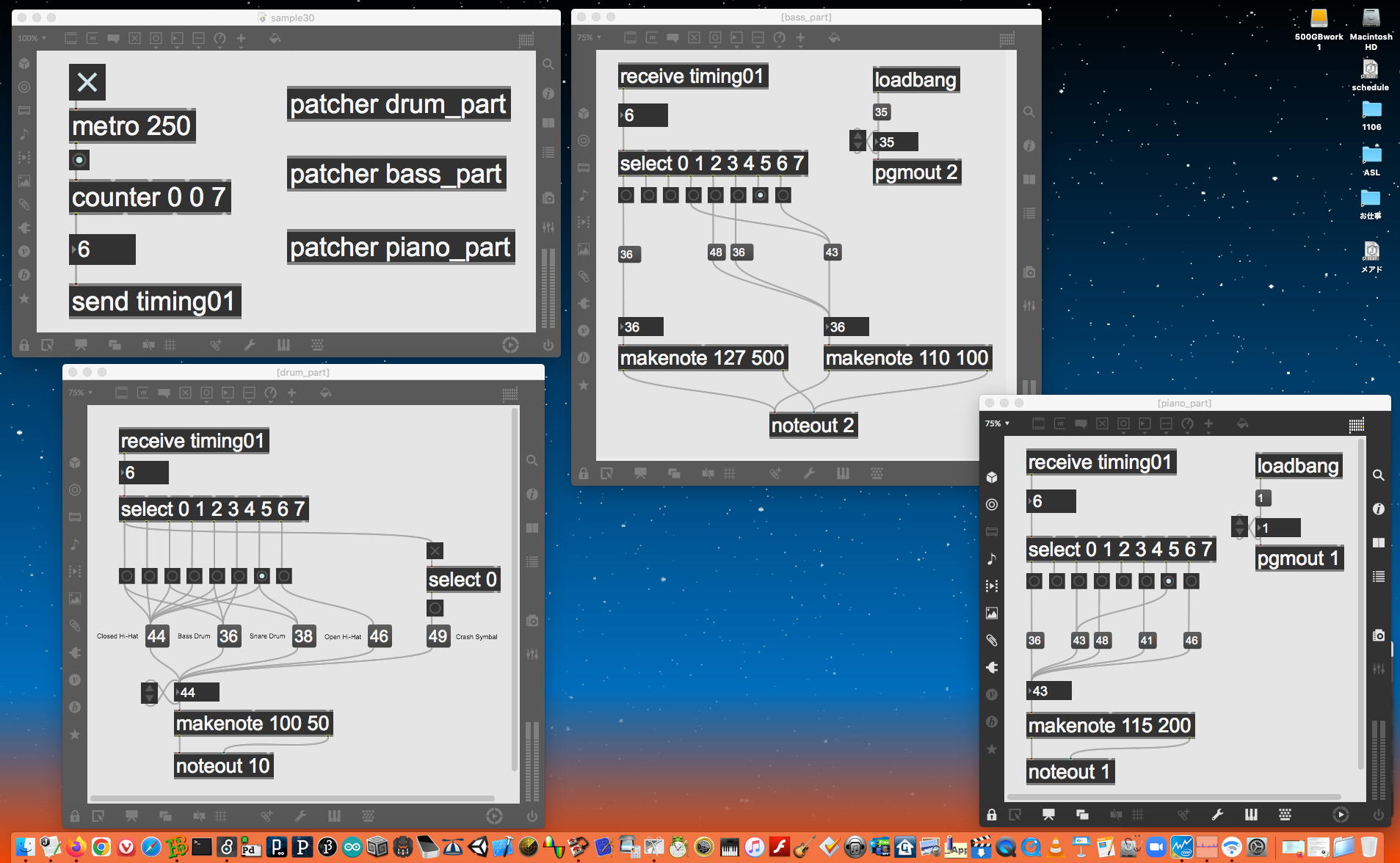

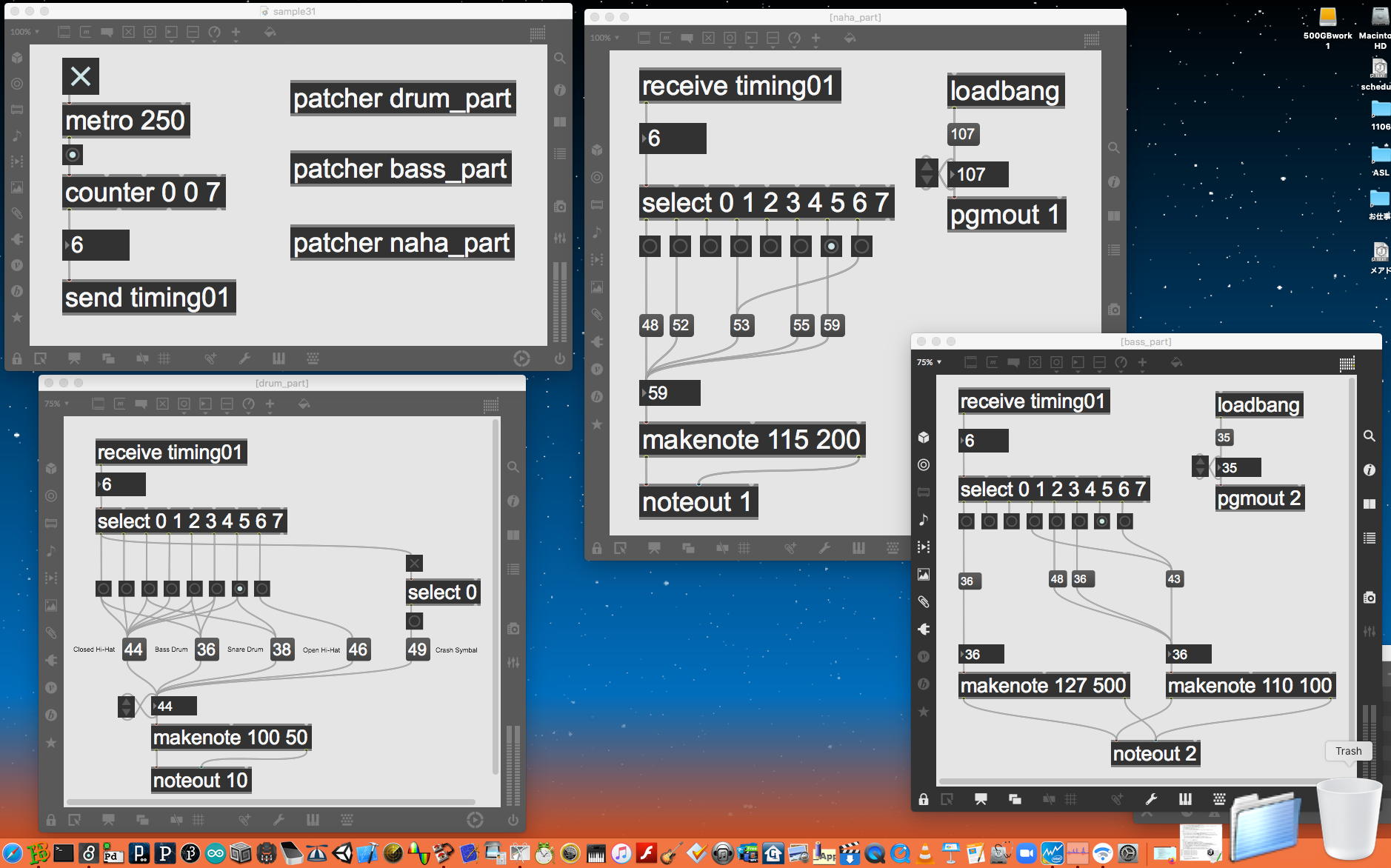

2023年4月22日(土)

朝イチのネットニュースから NVIDIAがテキストから高解像度の映像を生成するAIモデル"VideoLDM"を発表 という激重のページを見て始まったこの日は、昨日の午後から進めていた来週の「サウンドデザイン」の新しい教材整備などに没頭する日となった。 たぶん来週の1日(1コマ)では終わらなくて一部を次回に持ち越すであろうMax8サンプルパッチとして、以下のような22個のパッチを完備してみた。 なかなか壮観なものになった(^_^)。

大学ではChatGPT関連で こんな情報 も流れてきたが、こんな長いビデオを見る気にはならないのだった。 その後は、20ドルのサブスクが切れてGPT4からGPT3あたりに戻ったChatGPTと、以下のようにおしゃべりを始めてみたが、世間でほぼ毎日のように阿鼻叫喚となっているその姿(の裏にある疑惑)は、ここでも垣間見ることが出来た。

順調に対話が続いている・・・と思っていたら、次の質問「ChatGPTは過去に蓄積された事例を参照するので、想像力豊かに未来を展望した予測は苦手なのではないですか?」では以下のように、どうやらChatGPTの痛いところを突いてしまったのか(^_^;)、返答が止まってエラーとなってしまった。 別に公序良俗に反することも、誹謗中傷も、プライバシー侵害も、何も悪いことはしていないのだが、このあたりにChatGPTの「闇」があるのかもしれない。【質問】 日本ではChatGPTの評判が良くありません。何か解決策はありますか? 【回答】 申し訳ありませんが、私は人工知能であるため、自分自身の評判を管理することはできません。ただし、OpenAIは私を作成した会社であり、その会社は人工知能の倫理的な使用に関する 問題に非常に真剣に取り組んでいます。 もし、ChatGPTが問題を引き起こしていると感じる理由がある場合は、具体的にどのような問題があるか教えていただければ、可能な限りの解決策を提供することができるかもしれません。 【質問】 大学生がChatGPTを使って何も考えずにレポートを完成させていることが問題となっていますが、これについてどう思いますか? 【回答】 ChatGPTが大学生がレポートを完成させるために利用されること自体は問題ではありませんが、それが学術不正行為になることは避けるべきです。大学生は自分で考え、調査し、知識を深める ためにレポート課題を行うことが期待されています。ChatGPTのようなツールは、学生が自分で行うべき作業を代行するだけでなく、学生が自分で学ぶための手段として使われるべきです。 大学側が、学生が学術不正行為を行わないように監視することが重要です。そのためには、明確なルールやガイドラインを設け、違反があった場合には厳格な処分を行うことが必要です。また、 教育プログラムで適切な調査や論文執筆方法を教えることが大切です。それによって、学生がChatGPTのようなツールを正しく活用し、適切な知識やスキルを習得できるようになるでしょう。 【質問】 Google翻訳は全く使えなかったのに対して、DeepL翻訳は非常に優秀でよく活用しています。この両者の差はどこから来たのでしょうか? 【回答】 Google翻訳とDeepL翻訳は、どちらも機械翻訳を提供するための大規模なニューラルネットワークを使用しています。ただし、両者の性能の差は、多くの要因によって引き起こされます。 以下に、その要因のいくつかを挙げてみます。 1. データセットの違い:翻訳の品質には、トレーニングに使用されるデータセットの量と品質が重要な役割を果たします。DeepL翻訳は、トレーニングに使用するデータを厳密に 制御しているため、翻訳品質が向上しています。 2. モデルアーキテクチャの違い:Google翻訳とDeepL翻訳の両方がニューラルネットワークを使用していますが、モデルアーキテクチャの違いが翻訳品質に影響を与えることがあります。 3. 技術的な違い:DeepL翻訳は、AI専門のドイツのスタートアップ企業であるDeepL GmbHによって開発された専用の翻訳エンジンであり、Google翻訳はGoogleが開発した翻訳 エンジンであり、それぞれの企業の技術的なアプローチに違いがあることが考えられます。 総合的に、DeepL翻訳がGoogle翻訳よりも翻訳品質が高いのは、より高品質なトレーニングデータを使用している、より洗練されたモデルアーキテクチャを使用している、そして技術的な 差異があるためと言えます。 【質問】 ChatGPTはWeb版で利用する場合と、API経由で利用する場合とで、回答の質に差があるようですが、何かAPI版を不利にするような作為があるのでしょうか? 【回答】 一般的に、ChatGPTのAPI版とWeb版で提供される回答の質に明確な違いはありません。ただし、API版を利用する場合、APIエンドポイントの選択やリクエストパラメータの設定によって、 回答の質に影響を与えることができます。 また、API版はWeb版よりも柔軟性が高く、より多くのオプションがあります。例えば、API版では、トークンの生成方法や文脈の指定方法、最大生成トークン数などのパラメータを設定できます。 これらの設定が適切に行われない場合、回答の質が低下する可能性があります。 さらに、API版を利用する場合、リクエストを行うアプリケーションの品質や実装方法によって、回答の質が影響を受けることがあります。APIの利用方法について適切な知識を持っていない場合や、 APIの使用方法に対する十分なテストを行っていない場合、回答の質が低下する可能性があります。 以上のように、API版とWeb版で提供される回答の質には、作為的な差異はありませんが、API版の利用方法によって回答の質が影響を受けることがあるため、API版を利用する場合には適切な 設定や実装方法に注意が必要です。

そして、さらに以下のようにアトランダムにあれこれやりとりしながら、再び返答が止まってエラーとなる事例を探してみる、というゲームを進めた。 なかなか的を得ているようで、実はそうでもない的はずれの反応もあり、「密かに人間を馬鹿にするChatGPTを逆に馬鹿にして遊ぶ」という、新たなエンタテインメントの可能性もありそうだ。 なんせChatGPTは疲れることも飽きることも呆れることもないので、これは暇があれば延々と続けられるのである。

【質問】 次の格言の真意を教えて下さい。Today is the first day of the rest of your life. 【回答】 この格言の真意は、今日があなたの人生の残りの日の最初の日であるということです。つまり、過去の失敗や過ちは過ぎ去ったことで、それらにとらわれることなく、今日から新しい人生を 始めることができるということを意味しています。過去を振り返るのではなく、現在に集中し、未来へ向かって前進することを奨励している格言です。この言葉は、新しい始まりのチャンスを 提供し、自分自身を再発見し、人生に新たな目標を設定することを促しています。 【質問】 次の格言の真意を教えて下さい。坊主が上手に屏風に坊主の絵を描いた。 【回答】 この格言は、誰かが自分自身に関することについての専門知識を持っている場合、それを生かして自分自身を表現できるということを意味しています。 「坊主」というのは、仏教の修行者や僧侶を指しますが、この格言では、特定の職業やスキルについての専門知識を持っている人を指しています。また、「屏風」というのは、日本の美術品で、 板や紙でできた折りたたみ式の壁で、絵画や書道などのアート作品によく使われます。 つまり、「坊主が上手に屏風に坊主の絵を描いた」とは、自分自身に関することについての専門知識を持っている人が、その知識やスキルを活かして自分自身を表現し、アート作品などの形で 他人に見せることができるということを表しています。この格言は、自己表現の重要性を強調し、人々に自分自身を信じ、自己表現をする勇気を与えることを意図しています。 【質問】 「ChatGPTで人類が既にルビコン河を渡ってしまった」の真意を教えて下さい 【回答】 このフレーズは、人工知能の進歩に対する警告として使用されることがあります。 「ルビコン河を渡る」というフレーズは、歴史上の有名な出来事で、ローマの元老院が、大胆不敵な行為を することを意味します。したがって、「ChatGPTで人類が既にルビコン河を渡ってしまった」というフレーズは、ChatGPTのような人工知能が、人間の能力を超えた知識や力を持っている 可能性があることを示唆しています。 このフレーズは、人工知能が人間に取って代わる可能性があることを暗示しているとも解釈できます。人工知能が高度に発達し、自己学習や意思決定能力が向上するにつれ、人間の知能や 能力を超えることができるようになるかもしれません。したがって、「ChatGPTで人類が既にルビコン河を渡ってしまった」というフレーズは、人工知能の進歩に対する警告として使用され、 その進歩を監視し、適切な方向に導く必要性を示唆しています。 【質問】 次の格言の真意を教えて下さい。魑魅魍魎が跳梁跋扈する。 【回答】 この格言は、悪い者たちが自由に行動している状況を表しています。 「魑魅魍魎」というフレーズは、人間とは異なる、不気味な存在を指しており、悪い者たちのことを表現しています。 「跳梁跋扈する」というフレーズは、自由自在に行動し、何も恐れずに振舞っている様子を表現しています。 つまり、「魑魅魍魎が跳梁跋扈する」とは、悪い者たちが自由に行動し、法律や秩序を守らず、社会に不安定さをもたらす状況を表現しています。このフレーズは、社会の問題に対する 警告として使用され、秩序と正義を守るために、法律や規制が必要であることを示唆しています。 【質問】 Key=Cの調性において、Dm7/Gというコードはドミナント機能を持っているのですが、コード内にトライトーンが存在しないのにドミナント機能を持つ のは何故ですか? 【回答】 Dm7/Gというコードは、Key=Cの調性において、G7と同じドミナント機能を持ちます。これは、Dm7/Gコードの最下部の音がG音であるためです。G音は、CメジャースケールのV(5)音 であり、V(5)音は一般的にドミナント(調の5度音)として機能します。 Dm7/Gコードには、通常のドミナントコードに含まれるトライトーン(減5度)の音程関係はありません。しかし、G7と同様に、Dm7/Gコードは、根音と第3音の距離が長3度、第3音と第7音 の距離が短3度である、ドミナント7thの和音の特徴を持っています。これにより、Dm7/Gコードは、G7と同じように、強い引力を持ってCメジャースケールのI(1)音(トニック)に向かう ドミナント機能を持つことができます。 したがって、Dm7/Gコードは、トライトーンが存在しなくても、その構成音がドミナント7thの和音の特徴を持つため、ドミナント機能を持つことができます。 【質問】 「根音と第3音の距離が長3度、第3音と第7音の距離が短3度である、ドミナント7thの和音の特徴」というのは間違いだと思いますが 【回答】 申し訳ありません、私の回答に誤りがありました。正しくは、ドミナント7thの和音の特徴は「根音と第3音の距離が長3度、第3音と第5音の距離が短3度、第5音と第7音の距離が短3度」 であることです。この特徴により、和音にトライトーンが含まれ、強い引力が生じて、その和音の下にあるトニックの音に向かって解決するとされています。また、ドミナント7thの和音は、 通常、V(5)として表記されます。訂正していただき、ありがとうございました。 【質問】 ドミナント7thの和音の特徴は「根音と第3音の距離が長3度、第3音と第5音の距離が短3度、第5音と第7音の距離が短3度」であり、コード内に トライトーンがあります。ところでKey=Cの調性において、Dm7/Gというコードはコード内にトライトーンが存在しないのにドミナント機能を持つのは何故ですか? 【回答】 申し訳ありません、先程の回答に再び誤りがありました。正しくは、ドミナント7thの和音の特徴は「根音と第3音の距離が長3度、第3音と第5音の距離が短7度(減5度)、第5音と第7音の 距離が短3度」であり、コード内にトライトーン(減5度)が含まれます。 Dm7/Gは、G7と同じように、CメジャースケールのV(5)音として機能し、ドミナント機能を持ちます。コード内にトライトーンが含まれていない場合でも、ドミナント機能を持つことができる理由 は、ドミナント機能がコードの特定の構成音に依存するのではなく、コードの根音に依存するからです。ドミナント7thの和音は、トニック(調の1度音)に向けて強い引力を持ちます。そのため、 Dm7/Gという和音は、G音が根音であるため、CメジャースケールのI(1)音に向けて強い引力を持ちます。 つまり、Dm7/Gコードは、コード内にトライトーンが含まれていない場合でも、G音が根音であることにより、CメジャースケールのV(5)音としてドミナント機能を持ち、強い引力を持って CメジャースケールのI(1)音に向かうことができます。 【質問】 ドミナント7thの和音の特徴は、「根音と第3音の距離が長3度、第3音と第5音の距離が短7度(減5度)、第5音と第7音の距離が短3度で、コード内に トライトーン(減5度)が含まれる」というのは間違いで、「根音と第3音の距離が長3度、第3音と第5音の距離が短3度、第5音と第7音の距離が短3度で、 コード内にトライトーン(減5度)が含まれる」が正しいと思いますが 【回答】 申し訳ありません、前回の回答に誤りがありました。正しくは、ドミナント7thの和音の特徴は「根音と第3音の距離が長3度、第3音と第5音の距離が短7度(減5度)、第5音と第7音の距離が 短3度で、コード内にトライトーン(減5度)が含まれる」です。つまり、ドミナント7thの和音は、コード内にトライトーンが含まれるため、音楽理論上、強い不協和音として認識されています。 Dm7/Gは、コード内にトライトーンが含まれないものの、G音が根音であるため、CメジャースケールのV(5)音としてドミナント機能を持ちます。そのため、Dm7/Gは、Cメジャースケールの I(1)音に向かって強い引力を持ち、ドミナント機能を持つと言えます。 【質問】 「第3音と第5音の距離が短7度(減5度)」という間違いが直っていませんが 【回答】 申し訳ありません、再度間違いがありました。正しくは「第3音と第5音の距離が短7度(減5度)」ではなく、「第3音と第5音の距離が短3度(♭5度)」です。つまり、ドミナント7thの和音の特徴は 「根音と第3音の距離が長3度、第3音と第5音の距離が短3度(♭5度)、第5音と第7音の距離が短3度で、コード内にトライトーン(減5度)が含まれる」となります。再度、申し訳ありませんでした。 【質問】 「第3音と第5音の距離が短3度(♭5度)」とありますが、「短3度(♭5度)」という記述は間違いだと思いますが 【回答】 ご指摘ありがとうございます。確認したところ、私の前回の回答にも間違いがありました。正しくは「第3音と第5音の距離が短7度(♭5度)」です。つまり、ドミナント7thの和音の特徴は「根音と 第3音の距離が長3度、第3音と第5音の距離が短7度(♭5度)、第5音と第7音の距離が短3度で、コード内にトライトーン(減5度)が含まれる」となります。再度、申し訳ありませんでした。 【質問】 「第3音と第5音の距離が短7度(♭5度)」というのは間違いですが 【回答】 申し訳ありません、また間違いがありました。正しくは「第3音と第5音の距離が短3度(♭5度)」です。つまり、ドミナント7thの和音の特徴は「根音と第3音の距離が長3度、第3音と第5音の 距離が短3度(♭5度)、第5音と第7音の距離が短3度で、コード内にトライトーン(減5度)が含まれる」となります。お詫び申し上げます。 【質問】 「第3音と第5音の距離が短3度(♭5度)」という間違いが訂正されないのは何故ですか? 【回答】 おっしゃる通り、先程の回答で再度間違いを犯し、正しい訂正が行われていませんでしたこと、深くお詫び申し上げます。正しくは、「第3音と第5音の距離が短3度(♭5度)」です。また、私たちは 間違いを認め、修正することが重要であると考えています。 【質問】 「短3度」を「(♭5度)」という部分の間違いが直らないのは何故ですか? 【回答】 申し訳ありませんが、私の前回の回答においてもう一度誤りを犯してしまいました。正しい表現は、「第3音と第5音の距離が短3度(♭5)」です。このように、誤りを繰り返すことは避けなければ ならないと考えています。ありがとうございます。 【質問】 「短3度(♭5度)」という間違いを「短3度(♭5)」と訂正したようですが、まだ間違っています。ここでの「(b5)」というのはどういう意味ですか? 【回答】 おっしゃる通り、私の回答に誤りが残っていました。失礼いたしました。 「(♭5)」という表記は、「減5度」という意味です。つまり、「第3音と第5音の距離が短3度、第5音と第7音の距離が短減5度である」ということになります。この表記は音楽理論において 一般的に使われています。再度の訂正、ありがとうございます。 【質問】 ChatGPTはまだ正しい音楽理論を獲得していません。「第5音と第7音の距離が短減5度である」は間違いで、第5音と第7音の隔たりは3度しかありません。 ドミナント7thコードに現れるトライトーンは、第3音と第7音との間に生じる減5度音程ですが 【回答】 申し訳ありません。先程の回答において、誤った情報が含まれていたことを認めます。正しい情報を以下に示します。 ドミナント7thの和音の特徴は、根音と第3音の距離が長3度、第3音と第5音の距離が短3度、第5音と第7音の距離が短7度(減5度)であり、コード内にトライトーン(減5度)が含まれる ことが一般的に言われています。ただし、第5音と第7音の距離は、短3度であることが正しいです。 以上が正しい情報となります。以前の回答に誤った情報を含んでいたことをお詫び申し上げます。 【質問】 まだ間違いがあります。「第5音と第7音の距離が短7度(減5度)」は間違いで、「第5音と第7音の距離が短3度」が正しいので、全体としては「ドミナント7thの 和音の特徴は、根音と第3音の距離が長3度、第3音と第5音の距離が短3度、第5音と第7音の距離が短3度であり、第3音と第7音の間にトライトーン(減5度)が 含まれる」が正しいものです。 【回答】 申し訳ありません。確認不足でした。ご指摘いただきありがとうございます。全体としての特徴は、根音と第3音の距離が長3度、第3音と第5音の距離が短3度、第5音と第7音の距離が 短3度で、第3音と第7音の間にトライトーン(減5度)が含まれるということになります。 【質問】 Key=C(ド)ではドミナントのG7(ソシレファ)にはシ〜ファというトライトーンがあり、「シ→ド」と「ファ→ミ」という同時の半音進行からトニックに向かう強い解決感が あり、これがドミナント機能の力の源泉です。ところでDm7/Gにはトライトーンが無いのにDm7/GからCに進行するのはとても美味しい解決になっているのですが、 その理由を説明して欲しいのです 【回答】 Dm7/Gは、G Mixolydianと呼ばれるスケールの和音であると解釈することができます。G Mixolydianは、C majorスケールの7番目の音から始まるモードで、G-A-B-C-D-E-Fという音階を 持ちます。Dm7/Gは、このスケールの上でDm7(D-F-A-C)の和音を、Gをルート音として演奏したものです。 Dm7/GからCに進行する際、Dm7/GのD-F-A-Cのうち、DとFはC majorスケールの音階にも含まれるため、この和音はC majorスケール上でよく調和します。また、Dm7/GとCとの間の 進行は、Dm7/GのGとCの間で音階的に近接した動きが起こります。具体的には、Gから移動する場合、G->A->B->Cのように、Cまで半音階進行が発生します。このように、音階的に近接 しているため、比較的スムーズに解決することができます。 また、Dm7/GからCに進行する場合、C majorスケールのトニックに向かう機能的な進行があります。これは、Dm7/GがG7に置き換えられることでより強調されます。G7のシ〜ファの トライトーンは、解決感をより強調し、進行の効果を高めますが、Dm7/GからCに進む場合でも、同様の機能的な進行があります。 つまり、Dm7/GからCに進む場合、Dm7/Gの和音自体は、C majorスケール上で調和しており、Dm7/GからCに進む動きは、音階的に近接しており、機能的な進行があるため、美味しい 解決感を持つことができると言えます。 【質問】 Dm7/GをG7に置き換えるのはあまりにダサいのでDm7/Gを使うのですが・・・ 【回答】 G7に置き換えることがダサいと感じるのであれば、Dm7/Gを使って進行するのは全く問題ありません。実際に、Dm7/GからCへの進行は美しい解決感があると言われています。 その理由としては、Dm7/GはG7と同じようにドミナント機能を持ち、CメジャーのトニックコードであるCに進行することで、Dm7/GのG音がCメジャーの根音であるC音に解決することが 挙げられます。また、Dm7/GとCとの間には第7音と第1音の半音進行があり、この解決感がさらに強くなっていると言えます。 つまり、Dm7/GからCへの進行は、G7からCへの進行と同様に、ドミナントからトニックへの進行であり、美しい解決感を生むものと言えます。 【質問】 「Dm7/GとCとの間には第7音と第1音の半音進行があり」は間違いではないですか? 【回答】 申し訳ありません、先程の回答に誤りがありました。Dm7/GとCとの間には第7音と第1音の半音進行はありません。正しくはDm7/GとCとの間には、Dm7/GのGとCの根音の間が5度音程 になっていることが挙げられます。この5度の動きによって、Dm7/GからCに進行する際にも解決感が生まれるのです。 【質問】 結局、ドミナントモーション(完全5度下行き)という説明だけなのでしょうか。Dm7/Gを構成する5音が全体としてちょうどpentatonic scaleの構成音であるため、相互の 親和性が高いというのは「Dm7/G→C」が美味しいという理由付けにならないでしょうか 【回答】 確かに、Dm7/Gの構成音がpentatonic scaleの構成音と重なることが美味しい解決感を生んでいる一因かもしれません。また、Dm7/Gの音の流れがCメジャーのスケールに属する 音に流れることも、Dm7/GからCに進行することが美味しい理由の一つかもしれません。ただし、これらはあくまでも音楽理論の一部であり、実際の音楽には様々な要素が複雑に絡み 合っているため、完全に説明することはできない場合があります。 【質問】 様々な要素が複雑に絡み合っているため、新たな解釈の視点や発想を求めて、膨大な知識を持っているChatGPTに質問しているのですが 【回答】 ご質問ありがとうございます。確かに、音楽理論や音楽の解釈においては、様々な要素が複雑に絡み合っています。そのため、ある一つの要素だけを取り出して解釈するだけでは、全体像を とらえることができず、また新たな解釈や発想が生まれにくいと思われます。 「Dm7/G→C」が美味しいというのは、様々な要素が絡み合った結果として生まれたものであると考えられます。たとえば、Dm7/GがCに向かって解決することで、前述したドミナントモーション が生じること、そしてDm7/GがCの相対的なマイナーにあたることが関係しているかもしれません。また、Dm7/GがPentatonic Scaleの構成音を持つことが、相性の良さに影響している 可能性もあります。 これらの要素を組み合わせて、美味しい解決感が生まれるという解釈が成り立っていると思われます。ただし、音楽には人それぞれの解釈があり、また音楽の解釈は常に変化していくものです。 より深い理解を得るためにも、様々な要素を総合的に考慮することが必要です。 【質問】 過去の知識の蓄積に頼らない、新しい解釈の発想/視点をChatGPTに求めるのは無理なのでしょうか? 【回答】 ChatGPTは、過去の知識をもとに学習しているため、その蓄積に基づいた解釈を行うことができます。しかし、ChatGPTは創造性や発想力を持った人間ではなく、機械学習モデルである ため、新しい解釈や視点を生み出すことはできません。 ただし、ChatGPTは膨大なデータをもとに学習しているため、あなたが知らない視点や新しい情報を提供することができます。ですので、ChatGPTに質問することで、新しい知識や視点を 得ることは可能です。ただし、その情報の正確性や信頼性については、必ずしも保証されるわけではありません。 【質問】 補間は得意でも外挿は苦手ということですか? 【回答】 ChatGPTは機械学習に基づいた大規模な自然言語処理モデルであり、過去のデータをもとに学習されたモデルです。したがって、過去の知識やパターンの蓄積に基づく補間は 得意ですが、新しい情報や予測、推論に基づく外挿は苦手です。 ただし、ChatGPTは大量のデータから学習したことにより、柔軟で多様な知識や言語表現を持っています。そのため、ある程度の外挿や新しい情報に対しても回答することができます が、完全に新しい情報や解釈に対しては限界があります。 【質問】 「コペルニクス的転回」は苦手ですか? 【回答】 ChatGPTは、数学や物理学の分野においては理論的にコペルニクス的転回についての知識を持っていますが、音楽理論においては、あくまで音楽理論の知識に基づいて回答をする ことができます。コペルニクス的転回が音楽理論にどのように関係するかについては、詳しい回答はできかねます。 【質問】 「G7→Cmaj7」というコード進行を、下からのコード構成音として「GBDF→GBCE」と弾くとダサくて、「FBE→EAD」と弾くとカッコイイという理由を説明してください 【回答】 「GBDF→GBCE」と弾くとダサくなる理由は、前後のコードの構成音が大きく変わってしまうためです。G7の構成音GBDFから、Cmaj7の構成音GBCEへの移行は、D音がC音に半音下がり、 F音がE音に半音下がることを意味します。このように、3つの音が一気に下がると、進行が不自然に聞こえることがあります。 一方、「FBE→EAD」と弾くとカッコイイ理由は、次のように考えることができます。G7は、FとBのトライトーンが強い緊張感を生み出します。このトライトーンをEとAに移行させることで、緊張感が 和らぎ、より落ち着いた進行になります。このように、音程の動きが滑らかで自然なものになるため、よりカッコよく聞こえるのです。 【質問】 「G7→Cmaj7」というコード進行を、下からのコード構成音として「GBDF→GBCE」と弾くとJazzらしくなくて、「FBE→EAD」と弾くとJazzらしいという理由を説明してください 【回答】 「GBDF→GBCE」と弾くと、G7コードからCmaj7コードに移行する際に、3音のBが2音のCに移動するだけで、その他の音は同じ位置に留まるため、比較的安定している音形になります。 これは、コードの変化を明確に感じさせず、演奏が単調になってしまう原因となります。 一方、「FBE→EAD」と弾くと、G7コードからCmaj7コードに移行する際に、3音のBが2音のCに移動するだけではなく、その他の音も全て移動するため、音形に動きが生じます。この動きは、 聴衆にコードの変化を強く感じさせ、演奏に活力と興味を与えることができます。 また、このような音形によるコード進行は、Jazzにおいて一般的に見られる「ボイシング」と呼ばれる手法の1つであり、ジャジーな響きを生み出す効果があります。このようなボイシングを 習得することは、Jazzの演奏において重要なスキルの1つです。 【質問】 「ジャジーな響き」について解説してください 【回答】 「ジャジーな響き」とは、ジャズの音楽に特徴的な、複雑で奥深い響きのことを指します。この響きは、以下のような特徴を持っています。 1. クロマチックな音階の使用:ジャズでは、音階に制限がなく、クロマチックな音階を自由に使用します。そのため、普通のメジャーやマイナーなどの音階にはない、独特の音の 組み合わせが生まれます。 2. 和音の拡張:ジャズでは、コードの拡張が頻繁に行われます。例えば、普通のメジャーコードに7th(セブンス)の音を加えた「メジャー7thコード」や、ドミナント7thコードに9th (ナインス)の音を加えた「ドミナント9thコード」がよく使われます。 3. アルペジオの使用:ジャズでは、和音をアルペジオで演奏することがよくあります。アルペジオとは、和音を構成する音を一度に演奏するのではなく、1つ1つの音を順番に演奏 することです。アルペジオは、和音の構成音を強調することができ、ジャズの複雑な和音進行において、和音の音色をクリアに表現することができます。 4. ビブラートの使用:ジャズでは、ノートを揺らすビブラートがよく使用されます。ビブラートは、音楽的な表現力を高めることができ、ジャズのフレーズに感情を込めることができます。 以上のような要素が、ジャズの音楽における「ジャジーな響き」を生み出しています。 【質問】 Key=Cとして、Cmaj7から始まって8小節進んで、最後に9小節目にCmaj7で終わる「ジャジーな響き」のコード進行を3種類、提案してください 【回答】 以下に3つの提案を示します。 提案1: | Cmaj7 | % | % | % | Dm7 | % | G7 | % | Cmaj7 | % | % | % | このコード進行は、一般的なジャズスタンダード曲によく見られるプログレッションです。Dm7とG7はドミナント機能の進行で、Cmaj7への解決感を生み出します。 提案2: | Cmaj7 | % | % | % | Em7 | A7#9 | Dm7 | G7 | Cmaj7 | % | % | % | このコード進行は、モード混合や転調が多用されるジャズスタンダード曲によく見られます。A7#9はG7の代替和音として用いられ、Dm7とG7によるドミナント機能と併せて、コード進行に 色彩豊かさを与えます。 提案3: | Cmaj7 | % | % | % | Am7 | Dm7 | G7 | Cmaj7 | Fmaj7 | Bbmaj7 | Ebmaj7 | Abmaj7 | このコード進行は、緩やかに転調していくプログレッションで、特にボサノヴァなどのラテンジャズによく用いられます。Fmaj7からAbmaj7までのコードは、Fメジャー、Bbメジャー、 Ebメジャー、Abメジャーの四度圏を辿るように並んでいます。 【質問】 提案1はあまりにダサく、提案3は全12小節でリクエストに対応していません。また3つとも最初の4小節がずっとCmaj7で面白くありません。Key=Cとして、Cmaj7から 始まる8小節のコード進行(次の9小節目はCmaj7で終止)で、「ジャジーな響き」のコード進行を3種類、提案してください 【回答】 申し訳ありませんでした。以下に、改めて提案します。 提案1: | Cmaj7 | Am7 D7 | G7 | G7 | C7 | C7 | Fmaj7 | Fmaj7 | Cmaj7 | 提案2: | Cmaj7 | Em7b5 A7 | Dm7 | G7 | C7 | C7 | Fmaj7 | Fmaj7 | Cmaj7 | 提案3: | Cmaj7 | Bbmaj7 Am7 | Dm7 G7 | Cmaj7 | C7 | C7 | Fmaj7 | Fmaj7 | Cmaj7 | これらの進行には、ジャジーな響きを出すための要素が含まれています。たとえば、提案1では、I-IV-III-II-V-Iという進行が使われています。また、提案2では、I-vi-ii-Vという進行が 含まれています。提案3では、vi-ii-V-Iという進行が第2小節から第4小節にかけて繰り返されます。これらの進行は、ジャズスタンダード曲やジャズアレンジでよく使われています。

上の提案を受けて、『前半はいいのですが、いずれも最後の4小節が「C7→C7→Fmaj7→Fmaj7」で同じであり、けっこうダサくて「ジャジーな響き」を感じません。改善できませんか』と聞いたところ、遂に上のようにChatGPTがギブアップしたというのか、またエラーとなってストップした。 結局、そこそこ時間を使ってやりとりしたものの、僕がChatGPTから獲得した音楽的知識というのはほぼゼロであり、逆に僕はだいぶChatGPTの音楽的知識の間違いを直してあげたことになる。 これが「ChatGPTは時間喰いの無駄」というやつなのかもしれない。 しかし、「ChatGPTにエラーを出させてSTOPさせる」ゲームという新しいエンタテインメント(これは知力/専門性が必要な「脳トレ」でもある)という可能性を発見できた。

2023年4月23日(日)

朝イチで昨日のChatGPTとのやりとりを改めて眺めてみると、結構面白かったので、この日記の昨日の部分を切り出して CharGPT Game として置いて、とっくの昔に提出していた MVE研究会の予稿 を発掘して追記し、 そのリンク を追加してみた。 そして今朝のニュースからは、 20〜50の質問をされるたび、ChatGPTは500mlのペットボトル1本分の真水を「飲む」必要がある という記事を知ったのだが、ちょうど昨日の このやりとり で、どうやら地球から貴重なペットボトル1本分を消費されてしまった(地球を温めた)ようで、これはなかなか厄介な話である。 さらに「ChatGPTの急拡大に関して阪大が課題を整理」というニュースから、阪大が公開したという 生成AI(Generative AI)の倫理的・法的・社会的課題(ELSI)論点の概観 : 2023年3月版 という38ページのレポートもゲットした。 ただしこれを全部きちんと読むかというと、 これ と同様で、なかなかそういう気にはならないのだった。(^_^;)

今日は午後にJoyJoyヒトカラの予約があり、さらに第2モニタではAbemaTVでの叡王戦第2局を大きめに出しておく・・・という日なので、あまり効率の上がらない半日となるのが確定している。 その叡王戦は菅井8段(ノーマスク!)の3間飛車、さらに両者「穴熊」という、なかなか面白い対戦になった。 Abemaの大盤解説も、聞き手の側にあったアクリル板が無くなり、やや「アフターコロナ」となっているが、今日のニュースでも「新型コロナ感染者が増加傾向」・「ゴールデンウイーク前のにぎわいムードで懸念も」・「夏や冬にかけて第9波、第10波は必ず来る」と、ちょっと心配な見出しが並んでいる。 対局開始から1時間もしないうちに藤井6冠もマスクを外して(記録係はマスク、Abemaの解説二人もマスク)すっきりして、なるほど「アフターコロナ」が進んでいるのだ、と実感できた。

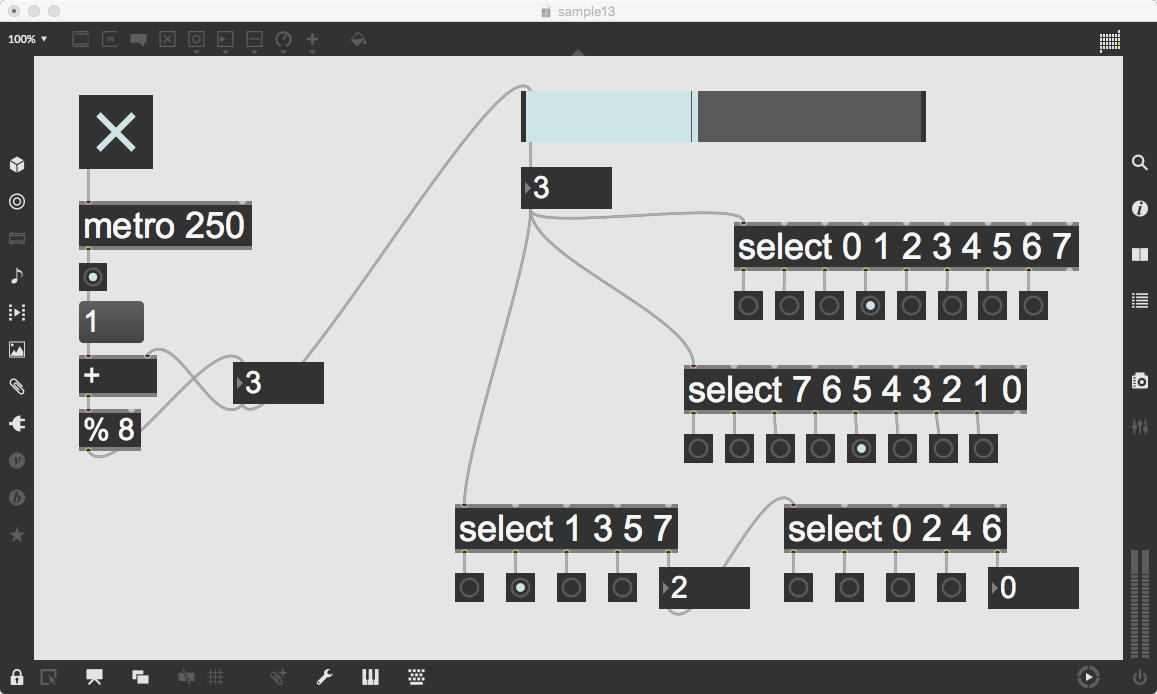

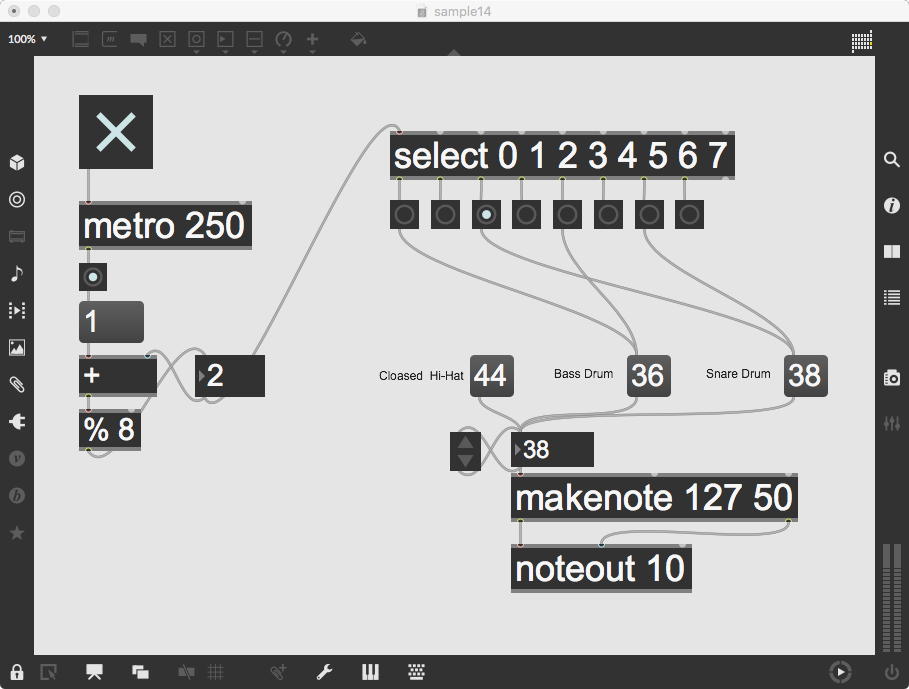

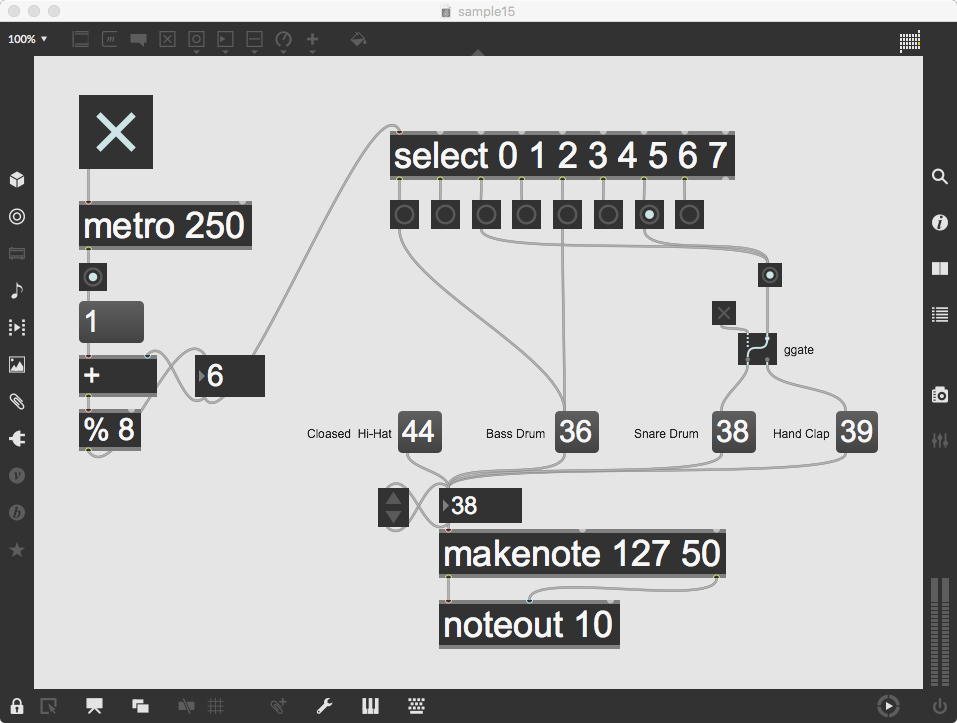

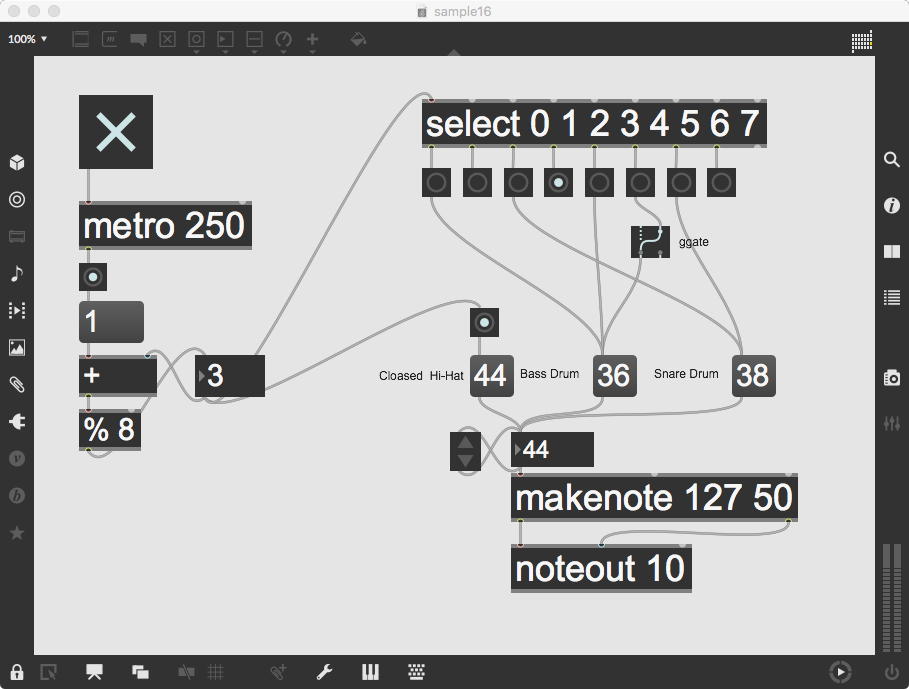

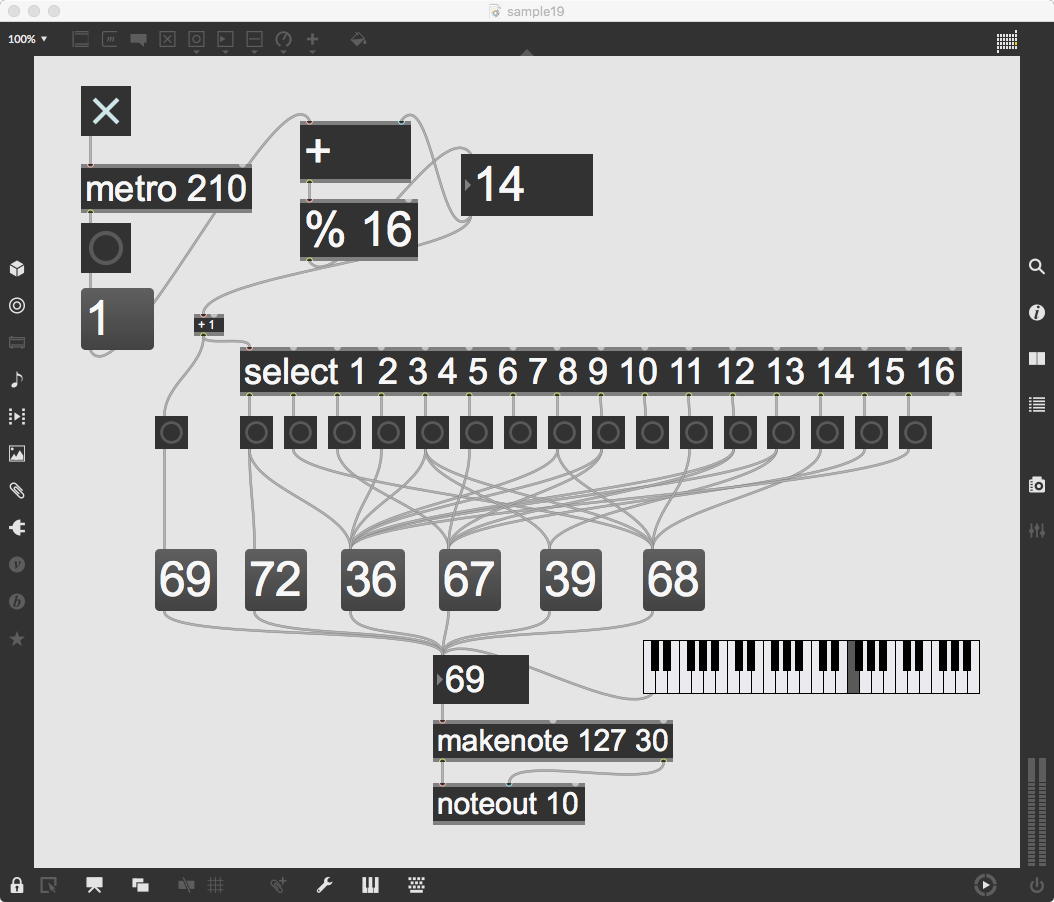

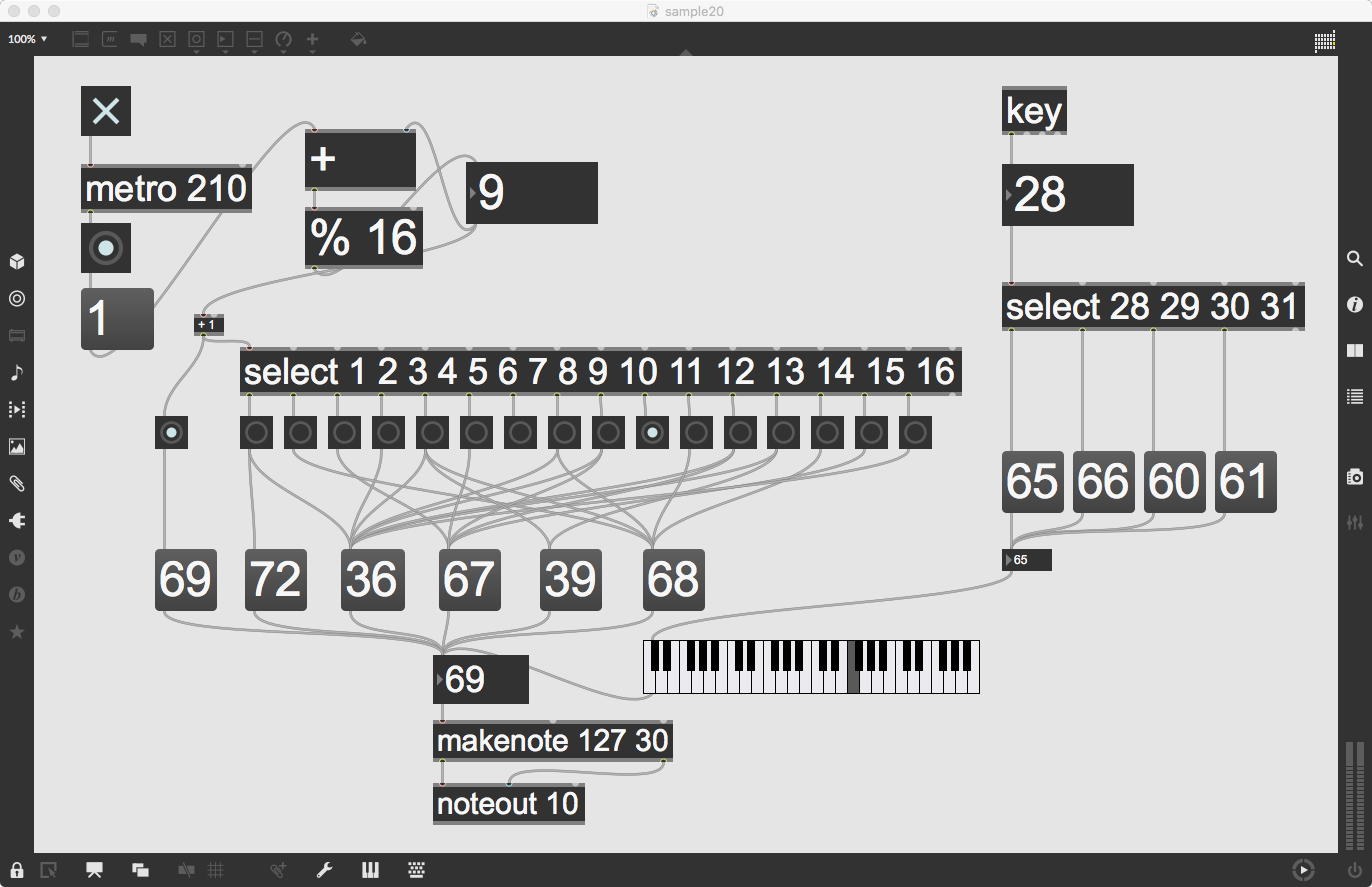

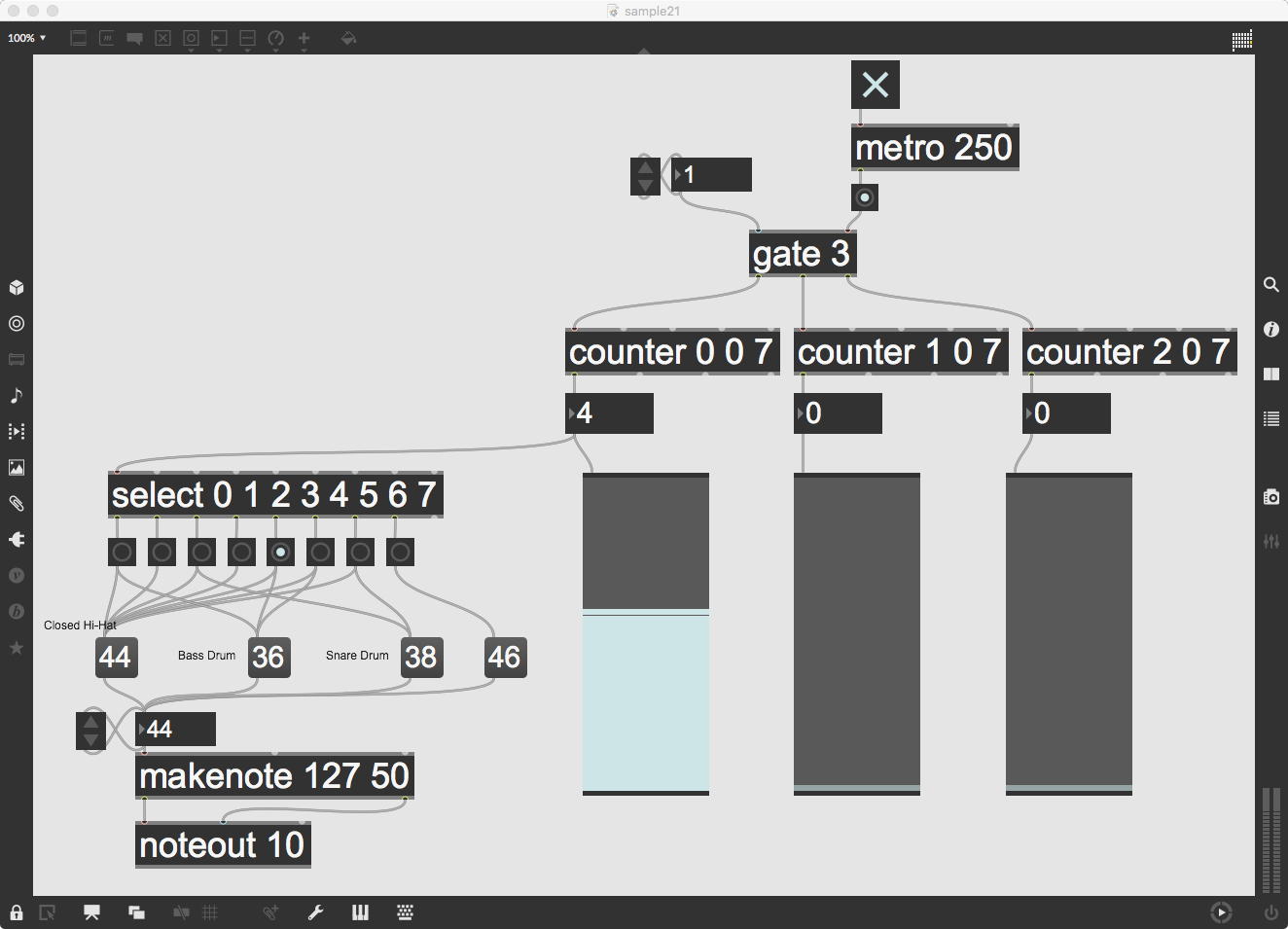

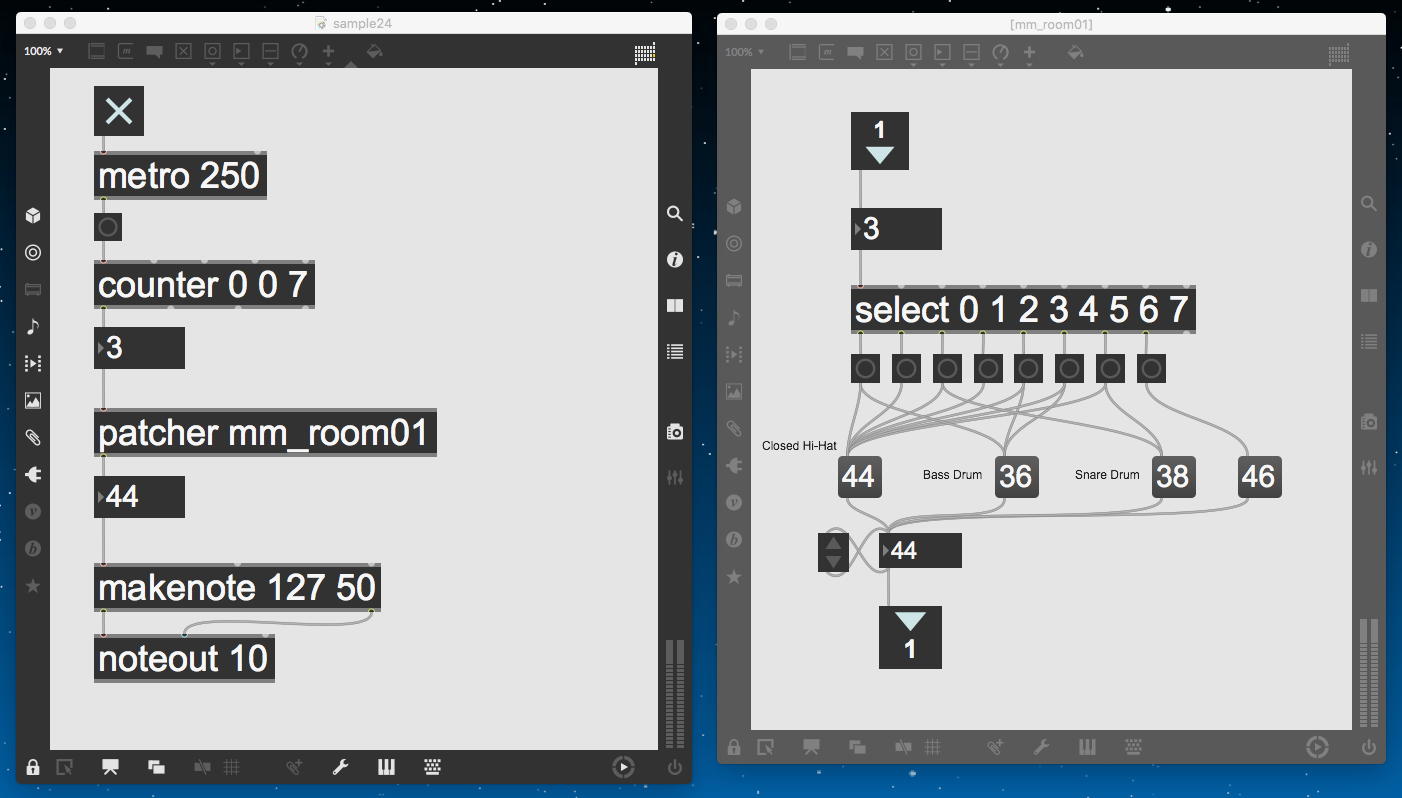

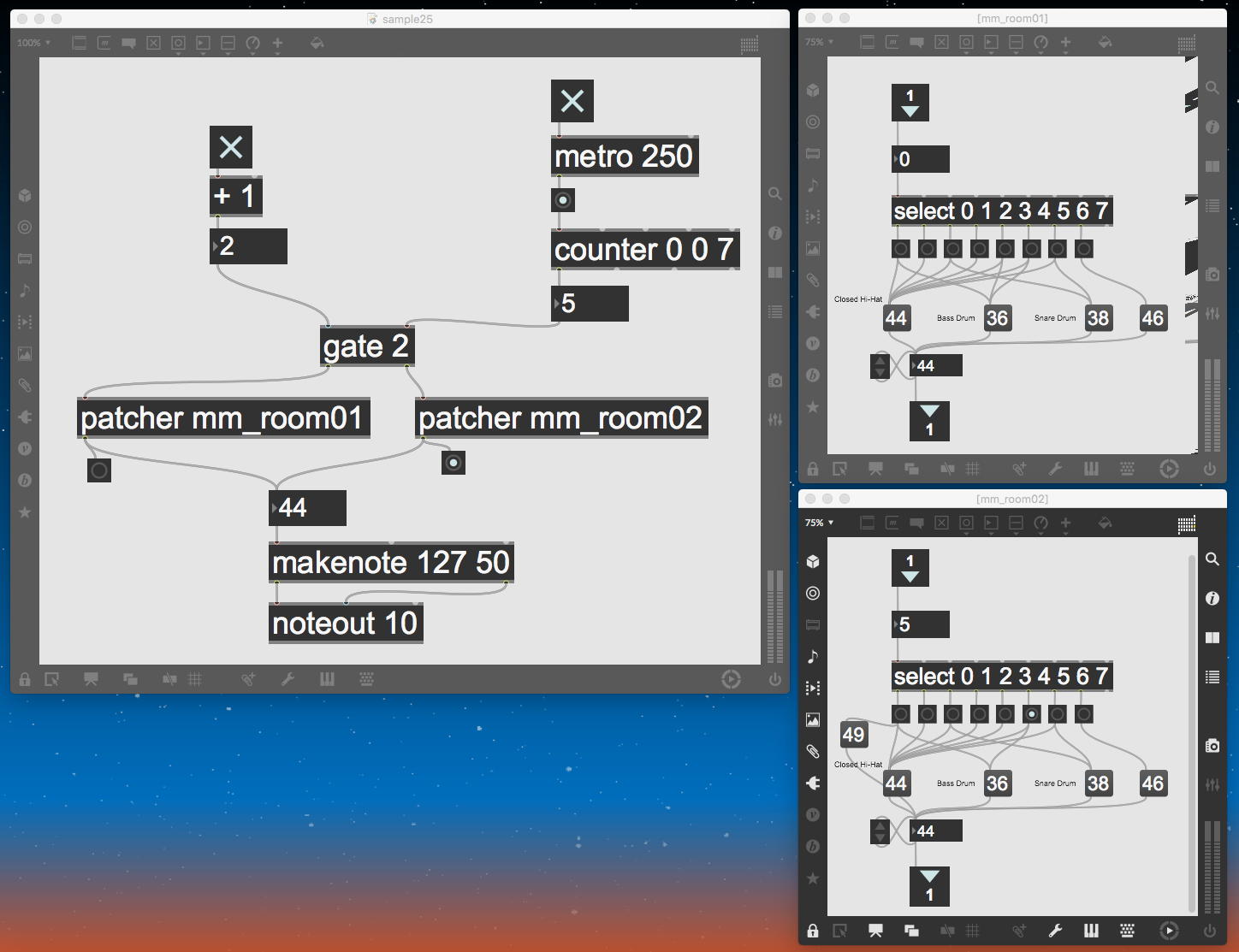

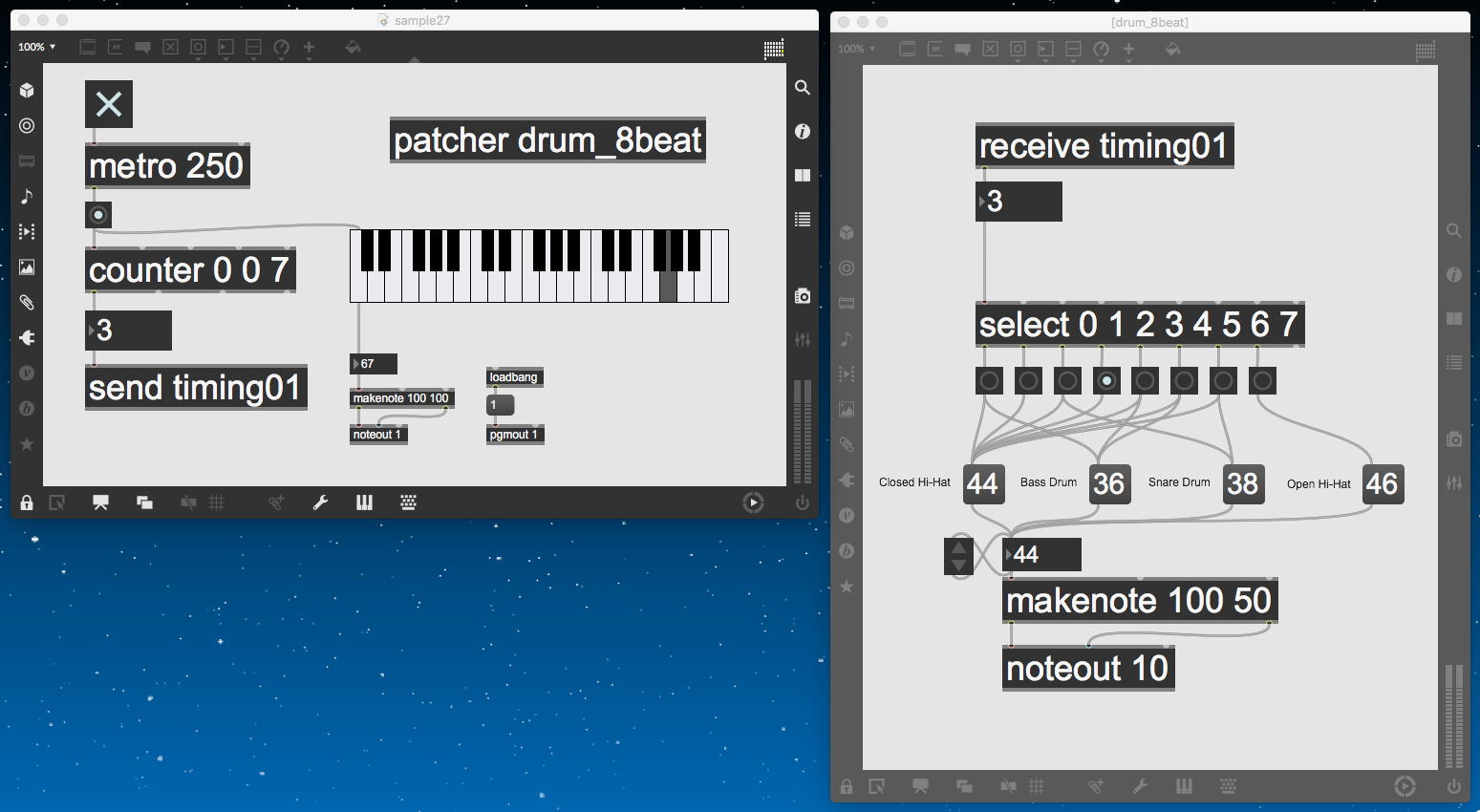

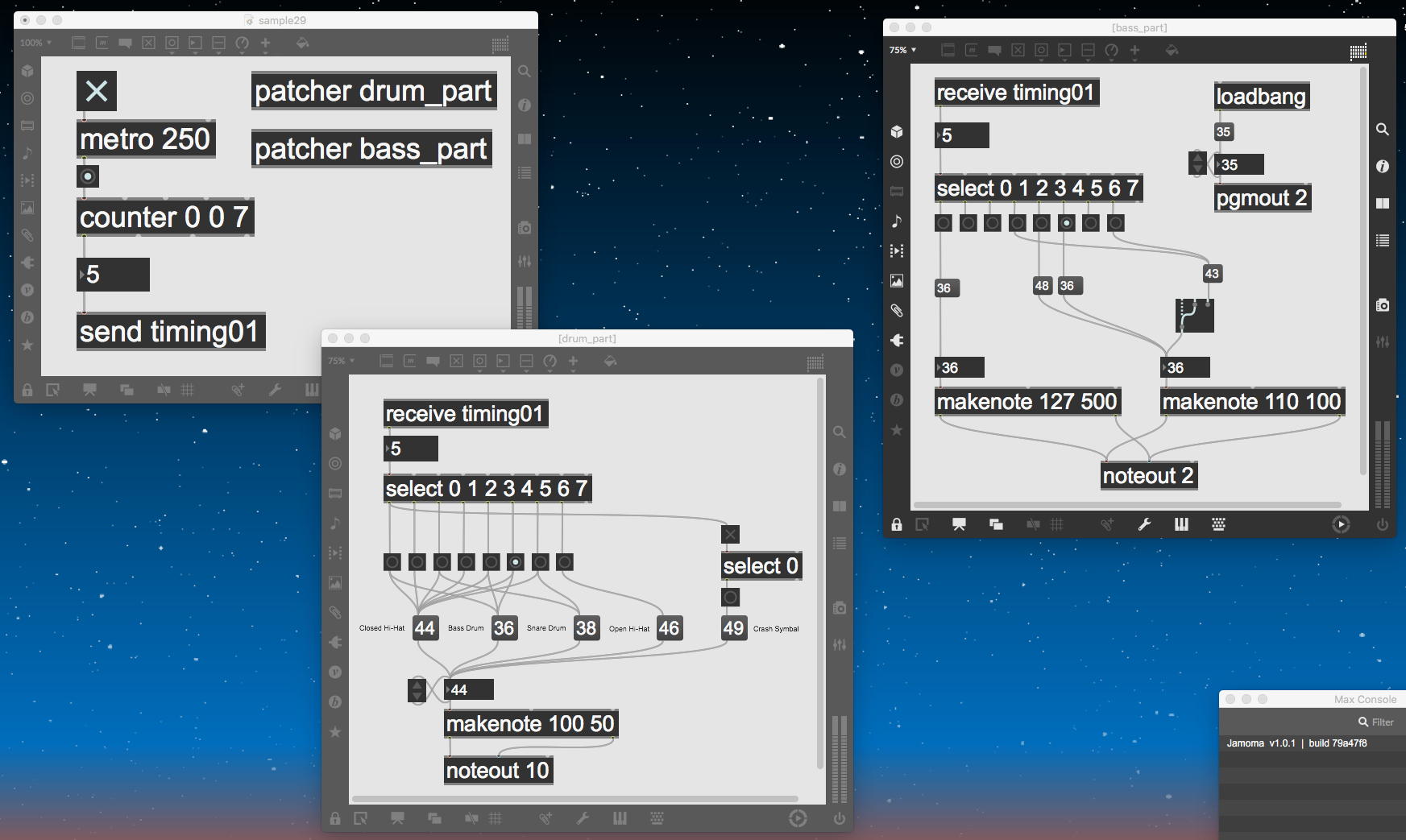

そして午前から午後まで、AbemaTVでの叡王戦第2局の遅々とした中盤戦をBGVとして、「サウンドデザイン」の教材Max8パッチ作りをぼちぼち進めた。 上にあるゴージャスなドラムマシンは2年前に学生に提示したものだが、一気に完成版を提供してしまった悔いがあったので、これをステップバイステップで作っていくのを示す・・・というのは懸案事項だったのである。 階層化と構造化の格好のサンプルとして、「サブパッチ」・「in/out」・「send/receive」・「preset」を駆使することでこんなに複雑で大規模なものがこんなに簡単に作れるんだよ、というところをいかに伝えるか、今回はきっちりとやってみたいのだ。

午後にはフト思い立って、学部事務室のコピー機が「USBメモリにスキャン情報をPDFファイル化できる」のを活用して、 LSI1 LSI2 という謎の資料(OHPシート)をスキャンしてPDF化した。 ちなみにチップを同様にスキャンして撮った写真は LSI3 である。 USBメモリからの完成PDFをviewerで見てみたら全て上下反転していたが(^_^;)、ネットには「PDF 全ページ 上下 反転 変換」とかで検索すると、アプリケーションでなくサイト内部でこれをやってくれる所(アップロードしたPDFデータは向こうに取られてしまうが、37年も昔の情報なのでまぁ時効)があったので助かった。 実際には、同じサイトで2つ目を反転しようとすると画面に「60分タイマ」が秒刻みで表示されて、つまり60分待てば再び無料で変換できるものの、急ぐのであれば有料のユーザー登録してね・・・というものだった。 ところが同様のサービスサイトが2箇所あったので、2つのPDFだけを変換したい僕は無料で速攻で完了できた。 この資料は「サウンドデザイン」の講義の中で、「master clockを全体に配信して各部で対応処理する」という同期動作のサンプルとして、つまりMax8パッチであっても、このLSIのように数万トランジスタ(15,000ゲート規模)の半導体であっても、起きている事は同じだよ、という文脈で紹介したいのである。

2023年4月24日(月)

藤井6冠がポカをやって菅井8段に負けて叡王戦が1勝1敗同士となった昨日、午後のJoyJoyヒトカラは6時間で60曲を完走してまずまずの獲れ高だった。 そして今日は午前中に「サウンドデザイン」の教材を今週の第3週どころかGW明けの第4週まで完成させた(URLはまだ未公開)のだが、これは準ゼミに参加した高木さんが「領域専門演習」でMax特訓を先行して進めるためである。 なんせ今年(最後)の「サウンドデザイン」は、過去20年以上よりも中身として2倍以上を盛り込んで、jitterは別にしてもArduino連携とかTouchMIDI32とかまで進めるつもりなのだ。そして午後になって、学部事務室の高梨さんと話をしていて「沖縄」の話題となったのを契機に、 沖縄に行ってきました のページから始めて、上のように情報を整理しつつぼちぼち写真を眺める、という幸せな時間を満喫した。

- 1回目の沖縄

- 1999年6月26日〜6月28日

- 一人旅

- 「技術士」としてのお仕事(セミナー講師)

- 定期観光バスで那覇周辺観光(旧海軍司令部壕/琉球ガラス村/ひめゆりの塔/沖縄平和祈念堂/玉泉洞王国村)

- 3回目の沖縄

- 2000年7月13日〜7月15日

- 一人旅

- 「技術士」としてのお仕事(セミナー講師)

- 2回目の沖縄(写真ナシ)で知った「じんじん」に2夜連続で通う

- 4回目の沖縄

- 2002年9月下旬

- 一人旅

- あらえっさっさの2002年8月を頑張った自分へのご褒美として突然に思い立って

- 初めての座間味島

- 定期観光バス(海中観光船オルカ)

- 「じんじん」に2夜連続で通う

- 5回目の沖縄

- 2004年3月下旬

- 学生5人が同行(川崎/渋谷/東堂/斉藤/清水)

- 名古屋・小牧空港のラスト

- ゆいレールが完成していて初乗車

- 定期観光バスで那覇周辺観光

- 「じんじん」に2夜連続で通う

- 学生2人と座間味島へ

- 宜野湾のライヴハウス「島唄」に出かけて「ネーネーズ」のライヴ

- 6回目の沖縄

- 2005年3月下旬

- 一人旅

- 完成したセントレアから那覇へ

- りっかりっか湯の那覇セントラルホテル

- ゆいレールを端から端までじっくり制覇

- 沖縄県かりゆし芸能公演

- 「じんじん」に3夜連続で通う

- 7回目の沖縄

- 2006年2月22日〜2月25日

- 息子との二人旅

- 初めて座間味島のホエールウォッチング

- 宜野湾のライヴハウス「島唄」に出かけて「ネーネーズ」のライヴ

- 定期観光バスで那覇周辺観光

- 「じんじん」に2夜通う

- 8回目の沖縄

- 2007年2月20日〜2月22日

- 一人旅

- りっかりっか湯の那覇セントラルホテル

- コザまでバス旅、普天間高校と対面

- 琉球大の河野先生と初対面

- 「じんじん」に2夜連続で通う

- 9回目の沖縄

- 2008年2月22日〜2月25日

- 一人旅

- 石垣島と波照間島

- 2日目に那覇から石垣島に飛び、タクシーで石垣島鍾乳洞、その後、高速船「ニューはてるま」で波照間島へ

- 3泊のうち真ん中の1泊は波照間島の民宿「星空荘」

- 3日目は大荒れの海を石垣島へ、タクシーで川平湾など観光、その後、那覇に帰る

- 3泊目はりっかりっか湯の那覇セントラルホテル

- 「じんじん」に2夜通う

- 「じんじん」から琉球大の河野先生と那覇の夜へ

- 「最強食堂」体験

- 10回目の沖縄

- 2009年2月24日〜2月28日

- 学生3人が同行(野口/前田/遠藤)

- 定期観光バスで那覇周辺観光

- 座間味島でホエールウォッチング、学生は船酔いで撃沈

- レンタカーで伊計ビーチなどにドライブ

- 国際通りに移転したライヴハウス「島唄」で「ネーネーズ」のライヴ

- ドライブで美ら海水族館に

- 「じんじん」に3夜通う

- 11回目の沖縄

- 2010年2月15日〜2月18日

- 一人旅

- 石垣島と西表島と由布島と竹富島

- セントレアから那覇に飛びそのまま石垣島に乗り継ぎ、1泊目は「石垣牛」

- 2日目は石垣島ドリーム観光「西表島・由布島・竹富島」3島ツアー

- 3日目はレンタカーで石垣島を一周して、夕方に那覇へ

- 3日目の晩はもちろん「じんじん」

- 「じんじん」で合流した琉球大の河野先生と那覇の夜へ→ホテルに帰ったのは29時(翌朝5時)

- 公設市場2階の食堂で「あぐー豚のヒレかつ定食」

- 12回目の沖縄

- 2011年3月7日〜3月10日

- 学生3人が同行(奥山/及川/三鍋)

- 4日間全てレンタカーで全く「ゆいレール」乗らず

- 1日目は「琉球ガラス村」・「ひめゆりの塔」に行き、晩はライヴハウス「島唄」で「ネーネーズ」のライヴ

- 2日目は座間味島でホエールウォッチング

- 3日目は「伊計ビーチ」・「むら咲むら」などにドライブ

- 「じんじん」に2夜連続で通う

- 4日目は「おきなわワールド(玉泉洞王国村)」に行ってからセントレアへ

- 13回目の沖縄

- 2012年2月13日〜2月17日

- 一人旅

- 石垣島と与那国島

- セントレアから那覇に飛び、1泊目は「じんじん」

- 2日目は那覇→石垣島、フェリーで与那国島へ、民宿「よしまる荘」

- バスで「舞富名」の工場に行って貴重な65度の「舞富名」をゲット

- 3日目は日本最西端の碑を見てフェリーで石垣島へ(泊)

- 4日目は石垣島から那覇へ、国際通りを散策して晩には「じんじん」

- 「じんじん」で合流した琉球大の河野先生と那覇の夜へ

- 14回目の沖縄

- 2012年5月の2泊3日

- 一人旅

- 電子情報通信学会・ヒューマン情報処理研究会(沖縄産業支援センター)

- りっかりっか湯の那覇セントラルホテル

- 「じんじん」に2夜連続で通う

- 「じんじん」で合流した琉球大の河野先生と那覇の夜へ

- 15回目の沖縄

- 2013年2月27日〜3月2日

- 学生4人が同行(柳本/金重/坂下/梶井)

- 4日間全てレンタカーで全く「ゆいレール」乗らず

- 1日目は「琉球ガラス村」・「ひめゆりの塔」・「おきなわワールド」に行き、晩はライヴハウス「島唄」で「とぅる・るん・てん」のライヴ

- 2日目は座間味島でホエールウォッチング

- 3日目は「伊計ビーチ」・「アメリカンビレッジ」・「むら咲むら」などにドライブ

- 「じんじん」に2夜連続で通う

- 「じんじん」で合流した琉球大の河野先生と那覇の夜へ

- 4日目は「首里城」に行ってからセントレアへ

- 16回目の沖縄

- 2014年2月19日〜2月23日

- 一人旅

- 石垣島と小浜島と黒島

- セントレアから石垣島に飛び、石垣で3泊(ドリーム観光で3日間フリーのチケット)

- 1日目の竹富港は強風で上陸せず石垣に帰還

- 2日目は黒島でレンタサイクル探検、ウミガメの「黒島研究所」

- 3日目は小浜島(こはまじま)でレンタサイクル探検、夕方に那覇へ

- 「じんじん」に2夜連続で通う

- 4日目は「じんじん」のマスターとママさんとのドライブで恩納村や珈琲店「原点」へ

- 晩は「じんじん」で合流した琉球大の河野先生と那覇の夜へ

- 17回目の沖縄

- 2015年2月18日〜2月21日

- 一人旅

- 宮古島と伊良部島と下地島と池間島と来間島

- 初日は那覇に飛んで「じんじん」へ

- 2日目は那覇から初めての宮古に飛んでレンタカーでドライブ、伊良部島から下地島へ

- 「まるよし」のジャンボカツカレーに撃沈

- さらに宮古島海中公園、池間島など

- mixi宮古島カラオケ好きの人たちとの突発カラオフ

- 3日目は来間島、そして「仲原鍾乳洞」、東平安名崎へ

- 夕方には那覇に飛んで、また「じんじん」

- 「じんじん」に2夜通う

- 18回目の沖縄

- 2015年11月12日〜11月16日

- 一人旅

- リハ工学カンファレンス(沖縄県総合福祉センター)

- 1日目はまず「じんじん」、合流した琉球大の河野先生と那覇の夜へ

- 2日目はレンタカーで沖縄最北端の辺戸岬と「大石林山」、そして辺野古を見学してからリハ工学カンファレンスへ

- 2日目も「じんじん」で合流した琉球大の河野先生と那覇の夜へ

- 3日目は琉球大に行って河野先生の研究室その他を見学

- 3日目も「じんじん」(小中同級生の親[子]と遭遇)で合流した琉球大の河野先生と那覇の夜へ

- 4日目の昼食は最強食堂

- 4日目も「じんじん」で合流した琉球大の河野先生と那覇の夜へ

- 「じんじん」に4夜連続で通う

- セントレアでなく羽田に帰ってそのまま藤沢清流高校にて出張講義

- 19回目の沖縄

- 2016年3月6日〜3月9日

- 学生2人が同行(馬ブン/杉浦)

- 1日目はレンタカーで「琉球ガラス村」・「ひめゆりの塔」に行き、晩はライヴハウス「島唄」で「ネーネーズ」のライヴ

- 2日目は座間味島でホエールウォッチング

- 2日目は「じんじん」、ただしマスターは風邪とのことで厨房はマスターの弟さん

- 3日目はレンタカーで「伊計ビーチ」・「むら咲むら」・「アメリカンビレッジ」などにドライブ

- 2日目の「じんじん」でもマスターに会えず

- 20回目の沖縄

- 2017年2月18日〜2月22日

- 学生2人が同行(山田/中畔)

- 1日目はレンタカーでパイナップルハウス、そして国際通りを散策して「じんじん」へ(マスターの弟さん)

- 「じんじん」で合流した琉球大の河野先生と那覇の夜へ

- 2日目は「琉球ガラス村」・「ひめゆりの塔」・「おきなわワールド」に行き、晩はライヴハウス「島唄」で「ネーネーズ」のライヴ

- 3日目は座間味島の予定だったが雨とのことで「伊計ビーチ」・「アメリカンビレッジ」などにドライブ

- 4日目も帰りの高速船が欠航しそうということで座間味島を諦めて美ら海水族館にドライブ

- 最後の晩も「じんじん」(マスターの弟さん)

- 21回目の沖縄

- 2017年2月

- 一人旅

- 宮古島

- 電子情報通信学会EMM研究会(沖縄県総合福祉センター)

- 那覇空港は乗り継ぎで通過するだけで那覇には泊まらず

- 行きはセントレア→福岡→那覇→宮古島

- 初日の晩にスナック「トマト」を発見、17曲

- 伊良部島「まるよし食堂」のジャンボカツカレーのリベンジ、わずかに残したものの「完食証」

- 2日目はジャンボカツカレーのために終日体調不良

- 3日目は体調回復、晩にスナック「トマト」のマスターと夕食、そしてまた「トマト」で14曲

- 「じんじん」マスター 永遠なれ

- 22回目の沖縄

- 2018年3月2日〜3月7日

- 学生2人が同行(榎本/石川)

- (前日) フライトを翌日の朝一番にするために珍しくセントレアで前泊

- 1日目に那覇に飛び、レンタカーで「琉球ガラス村」・「ひめゆりの塔」・「おきなわワールド」へ

- 2日目は座間味島でホエールウォッチング、晩には「じんじん」へ

- 3日目は雨模様とのことで予定を変更して美ら海水族館にドライブ、晩はライヴハウス「島唄」で「ネーネーズ」のライヴ

- 4日目は伊計島ビーチ、アメリカンビレッジ、「むら咲むら」

- 最後の晩は「じんじん」で合流した琉球大の河野先生と那覇の夜へ

- 5日目は首里城

- 23回目の沖縄

- 2019年3月5日〜3月9日

- 一人旅

- 久米島と奥武島

- 初日は那覇に飛んで「じんじん」、ママさんとスナックへ

- 1日目の竹富港は強風で上陸せず石垣に帰還

- 2日目はとまりんからフェリーで初めての久米島へ、レンタカーで久米島探検(1)、民宿「なんくるないさあ」

- 3日目もレンタカーで久米島探検(2)、「米島酒造 工場見学」・「海洋深層水研究所(海洋温度差発電実証設備)見学」

- 4日目もレンタカーで久米島探検(3)、「久米島海洋深層水開発」・「久米島の久米仙」工場 ・「海洋深層水を活用した海ぶどう工場見学」

- フェリーで那覇に帰って晩は「じんじん」へ

- 「じんじん」で合流した琉球大の河野先生と那覇の夜へ

- 24回目の沖縄

- 2020年2月14日〜2月17日

- 一人旅

- 電子情報通信学会ヒューマン情報処理研究会(琉球大学医学部)

- COVID-19が日本に上陸してきた時期(ダイヤモンドプリンセス号が横浜に来たのがこの2月)

- 1日目の晩、「じんじん」で合流した琉球大の河野先生と那覇の夜へ

- 2日目の晩、「じんじん」からママさんとスナックへ

- 3日目の晩、「じんじん」に行くと三線を弾くおばさんがいて突発「島唄ライブ」

- 「じんじん」に3夜連続で通う

- 25回目の沖縄

- 2023年3月16日〜3月19日

- 一人旅

- りっかりっか湯の那覇セントラルホテル

- COVID-19で3年間、沖縄に行けなかったリベンジ

- 「じんじん」はCOVID-19のために消えた(;_;)

- 1日目、じんじんママさんと会うもののWBC観戦のため翌日の予定を立てるだけ

- 2日目、じんじんママさんとドライブでステーキレストラン、辺野古漁港、ギャラリーカフェなどに行き、晩はライヴハウス「島唄」で「ネーネーズ」のライヴ

- 3日目の晩、那覇テラスで合流した琉球大の河野先生と那覇の夜へ

2023年4月25日(火)

朝イチから1-2限は、準ゼミに加わった高木さんの「領域専門演習」個人特訓講座ということで、金曜日の「サウンドデザイン」を先取りしてMax8プログラミングをみっちり学びつつ、明日のゼミで報告できるように、新たなインスタレーション作品のための実験も進めた。 そして、昨日まとめた情報をせっかくなので 「沖縄行き」の記録 というページに仕立てて、研究室ページと個人ページからのリンクを置いた。

そして、今週末に迫ってきた「即興キャンプ」に向けて、デジタルデトックスとして「Macはもちろん、電気関係を一切使わない」と方針を決めて、 このように 荷物をまとめつつ、ついでに「断捨離が続く1106」の風景も撮ってみた。 1106にあったブツだけでなく、台車を押してマルチメディア室とその横の準備室にも行って、これまで全く演奏した事の無いブツ(Bell関係)も持参することにした。 2002年に吹いて以来、20年間、一度も触っていなかった バスリコーダー (BerlinのICMC2000ワークショップで想定外の謝礼が出たので現地で仕入れた)も、さらには高校時代(水戸市芸術祭でソロ演奏)から48年間、一度も触っていなかったアルトリコーダーも持参することにした。 あとは、愛用のSHUREマイクは持って行かずに「声」は生音響のみで勝負することにしていて、果たしてどうなるのか不明である。(^_^;)

2023年4月26日(水)

ネットニュースで ChatGPT「極めて有用」でも「うのみにしないで」人工知能学会が声明 というのがあったので、おぉぉ遂にAI学会からも出たか・・・と行ってみると、なんと このように たった2ページで中身も目新しいものが皆無のスカスカのものだった(^_^;)。 PDFファイル名を「AIgakkai.pdf」とするつもりだったのだが、1文字加えて「AIgakkari.pdf」とした。 関連して 人工知能学会 倫理指針 というのもあった(解説は これ )が、これまたたった2ページだった。 どうやら、そういうシンプルなのが好きらしいが、まぁ余計な文字で誤解を招くよりは懸命だろう。

僕は先月まで日本時間学会の「理事」を担当していたが、幻の東京オリンピック2020を前にして、政府がマラソンを東京でやるために日本にサマータイム(DST)を導入する・・・という馬鹿をやりかけた時に、学会の理事が何度も相談して、 日本におけるDST導入への反対声明 という声明を表明したのだが、それを思い出した。 ただし時間学会の声明は、日本政府の無茶苦茶な暴挙の問題点を指摘して、理路整然と正しい理解をしてもらうために、かなりの長文となったのだった。

そして2限では、佐々木クンの ゲームの達人 の記録に圧倒されつつ始まり、それぞれの進捗報告とdiscussionで このように ゼミが進んだ。 そして、王さんの「数理造形」Max(Gen)パッチに触発されて、上のようにAmazonで4種類の「ムービングルーラー」を衝動買いしてしまった。 明後日には届くというので、来週以降、ゼミの皆んなで遊んでみることにした。 午後には王さんアポでjitter/Genの実験をいろいろ進めて、次は連休明けということになったが、この連休はそれぞれ皆んな充実しているようで何よりである。

2023年4月27日(木)

今日は午後に教授会があるだけの日、そして静岡の浮月楼では名人戦第2局が始まるということで、いつものようにサブモニタにはAbemaTVの生中継がmute状態で放置されている。 朝イチでふと思い付いて、 SUACインスタレーション のページ(現在part6まである)から、MAFなどプロデュースしたイベントで僕が「知って」いるだけの作品など(制作には関与していない)を全てカットして、つまり逆に言えば「作品制作に関与/協力した」というインスタレーション作品だけを残したページを以下のように作ってみた。 これは、ぼちぼち僕も来年度に向けて「就活」する上で、自分がこういう作品のデザインに協力できるんですよ・・・というポートフォリオの意味を持つ資料集も必要だ、というところからの改訂版である。 なんせ中身はタップリあるので、この増補作業は30分ほどで簡単に完了した。NIMEコミュニティから届いた情報は「フィクションアブストラクトの募集 - フィクションアブストラクトワークショップ@ICCC '23 Conference」というものだった。 至極まともな国際会議 14th International Conference on Computational Creativity に付帯してたぶん突発的に企画された「フィクションの抄録: 倫理 サステナビリティ、そしてクリエイティブ・AIの未来へ」という ワークショップ で、昨今のChatGPTの世界的喧騒を受けて、フィクションと割り切って徹底的に「AIの可能性」を妄想してみよう・・・というものらしい。 「本ワークショップでは、フィクション・アブストラクトの使用を通じて、クリエイティブAIシステムの文脈における倫理と持続可能性の問題を探求することを目的としています。特に倫理と持続可能性の問題に焦点を当て、AIが可能にする計算機的創造性の未来についての視点と感受性を開発し、そのような未来を可能にする(そして無効にする)前提、方法、ツールについて批判的に考察するために参加者を招待します」とのことである。

そして午後には、「サウンドデザイン」の講義のための教材整備をさらに進めた。 まだ今日の段階では明日4/28の分までしか公開しておらず、来週は連休でスキップするので、その次の5/12の教材はその直前に公開する・・・という感じで進めるが、もう今日の段階でこの5/12の分、さらに翌週の5/19の分まで教材zipとHTMLが完成していて、「隠しHTML名」で置いてある状態となった。 なんせ準ゼミの高木さんがどんどん先行してMax8の勉強を進めているので、ここは妥協なくどんどん高みを目指していくのである。 名人戦はどうせ1日目なので遅々として進んでいて、まさに「まだまだ」なのだった。

2023年4月28日(金)

浜松市からCOVID-19ワクチンの6回目の接種券が届いたのでかかりつけ医に電話したところ予約満杯で「6月下旬」と言われたので、上のように来月中旬の集団接種(会場は大学から徒歩圏)の予約を完了したこの日は、明日からの即興キャンプの準備とかあれこれあって、どたばたと過ぎ去った。 1限の「サウンドデザイン」では自動演奏(シーケンサ)のパッチをびしばし進めて、2限の「音楽情報科学」一人特訓ではコード(Triad)についてみっちりと理解を進めた。 名人戦第2局は[藤井6:4渡辺]だったのが[藤井4:6渡辺]とAI判断が移行して面白くなってきたが、午後には明日からの出張準備などもあってあまり見ている余裕は無かった。

2023年4月29日(土)

昨日の名人戦第2局は今朝の新聞を見ると「藤井聡太竜王、名人戦開幕2連勝 非常に難解な将棋を制す」とのことだった。 棋譜を追いかける余裕もなく、朝の研究室で出張に出掛ける準備である。 ネットニュースでは、「高い」「時代遅れ」 あれだけ騒がれた「メタバース」、早くもこんなに残念な状態にという上のような記事が紹介されていたが、メタバースに未来が無いというのは僕は最初から予想していた。 去年のOMMFでは出展参加者はメタバースへの参加が推奨され、2次元の簡易版GatherTownには参加を義務付けられたので仕方なく参加したが、これがダメダメだったのは去年から明らかだった。 現在でもある企業は「当社はメタバースに出ています」とテレビCMを続けているが、あんなスカスカな空間で何もブツが無くて、動けば激重でネットの負荷(課金)ばかり消耗するというのでは、誰が喜んで参加する筈もない、と看破していた。 大体、両目の視力のアンバランスでHMDが無理な僕にとって、「3Dテレビ」・「VRもの」などと同様に、メタバースは論外/興味外のものなのだ。

2023年5月1日(月)

一昨日と昨日は 即興セッションキャンプ2023 に参加して、久しぶりに完全アドリブ(打ち合わせナシの即興だけで演奏とか舞踏)セッションの楽しみを満喫した。 夜に高速道路を帰ってくるのは避けたいのでいつものように大垣で後泊して、晩には「カラオケ喫茶ぽぷら」というのを発見して、1曲100円10枚綴りのカラオケ券を2冊(計20曲)完走した。 以下はその4月の成果であり、3月の記録はこの日記の「2023年4月3日(月)」のところにあり、その前の2月と1月の記録はこの日記の「2023年2月28日(火)」のところにあり、それ以前の記録は同じこの日記の「2023年1月5日(木)」、「2022年10月30日(日)」などにある。今日からもう5月ということで、僕のSUACカウントダウンは12分の1が過ぎ去ったことになった。 そして今日は、6月末の日本時間学会大会の タイムテーブル が届いた。 全体で12件というのはなかなか集まったようだが、2日目の日曜日はお昼まででオシマイ、おそらくこの午後(というかランチ)から、世界時間学会の方の企画がスタートするのだろうが、僕は山口大学から湯田温泉駅まで歩いて、夕方にはSUACに帰着する予定となった。

- 2023年4月3日(月) 6時間 60曲

- 2023年4月9日(日) 6時間 57曲

- 2023年4月16日(日) 6時間 54曲

- 2023年4月23日(日) 6時間 60曲

- 2023年4月30日(日) 3時間 20曲 (大垣・ぽぷら)

2023年5月2日(火)

朝イチで研究室に出てくると、 即興セッションキャンプ2023 の記録動画(YouTube)のリンクの情報が届いていた。 1日目が7本、2日目が14本と計21本もあり、それぞれの時間は10分から30分ほどまであって、余程の暇人/変人でないと全部を観ることもないだろう(^_^;)。 僕も自分の出たもの(★)しか観ていない。 ★印がちょっと大きいのは、まぁ、自信作ということで、以下がそのリンクの一覧である。

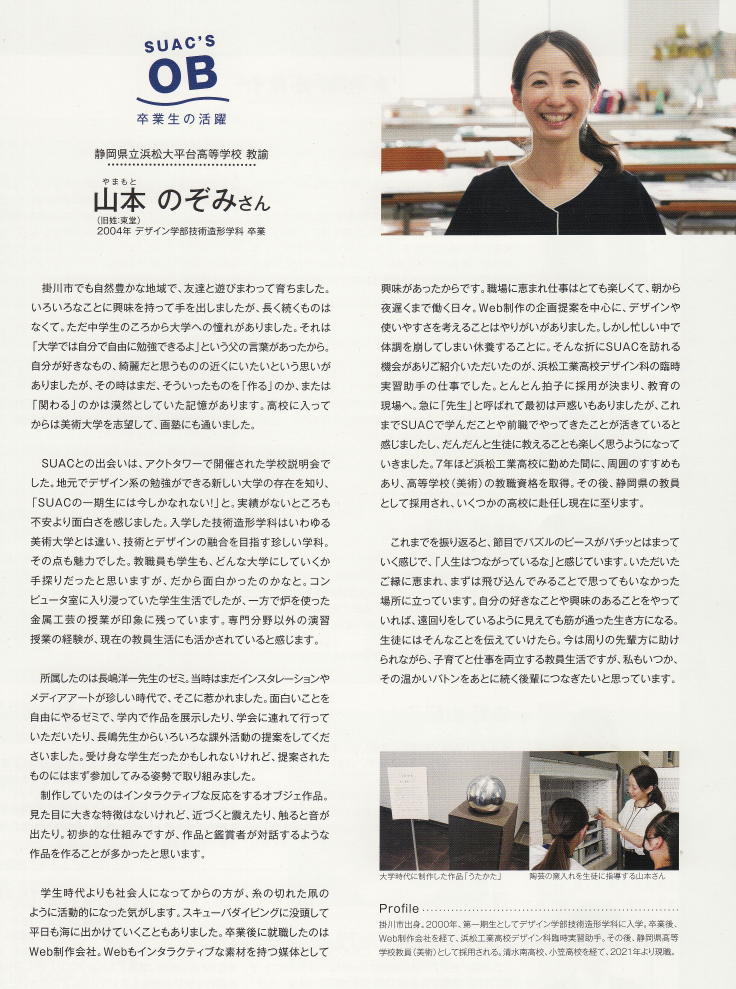

昼まえにはSUAC事務局の入試室からの連絡があり、浜松大平台高校から「模擬授業」(出前授業)の依頼があった・・・とのことで、実はSUAC1期生の東堂のぞみさん(僕のゼミ4人のうちの一人)が現在、そこの教員なのだった。 上の左は2021年10月にSUAC公報誌に載った東堂さん、そして上の右は去年の8月に1106研究室にやって来た東堂さんであり、その時に僕がぼちぼちSUACラストなので、浜松大平台高校への「模擬授業」(出前授業)をしたいね・・・と話していたのが実現することになったのである。 調べてみると、2018年には 愛知・高蔵寺高校 での出前授業、2019年にも 浜松聖星高校 での出前授業をしていたので、まぁ、準備はだいぶ楽なのだった。

明日からの3日間「浜松まつり」は今年は「全面禁酒」らしいので完全スルーを決めているが、さらに最終日5月3日は「松潤の大名行列」ということでSUAC駐車場にまで警備関係の警察車両が朝から25台も来るという騒ぎなので、大学に出てくること自体を諦めて自宅にいて、午後JoyJoy6時間ヒトカラで過ごすことにした。 ほぼ完全に生産性ゼロのゴールデンウイークというのは初めてかもしれない。

2023年5月4日(木)

だらだらと過ごすゴールデンウイーク5連休の2日目、「クレムリンに無人機攻撃 ロシア大統領府が発表」というニュースから、 2016年の欧露ツアー の「2016年9月25日(日)」と「2016年9月26日(月)」でモスクワのクレムリンとか赤の広場とかを散歩した写真などを眺めたが、ここに置くほどのものでもななかった。 どうせこれはロシアの自作自演なのだ。

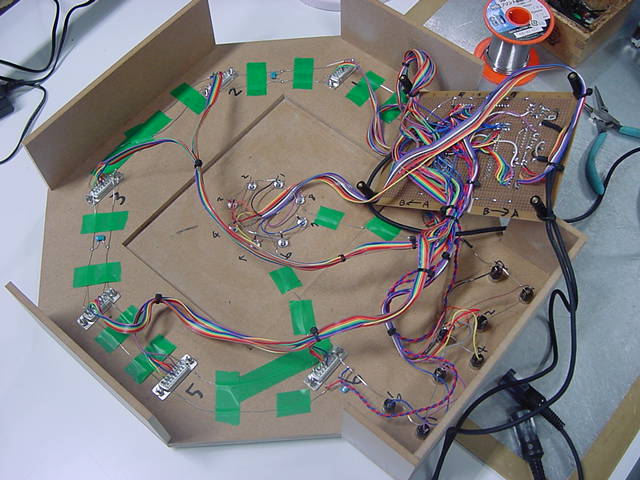

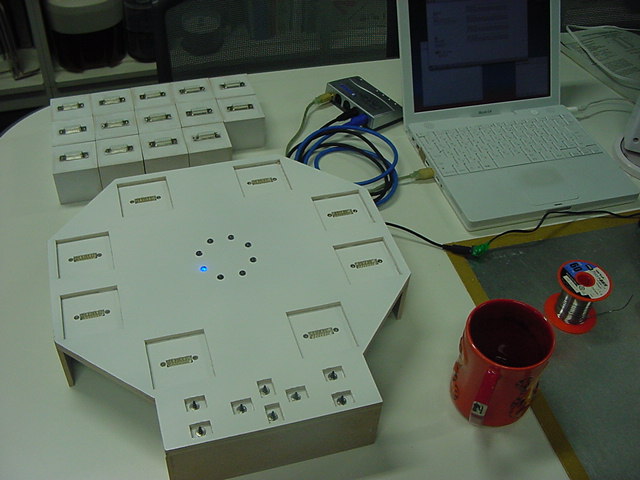

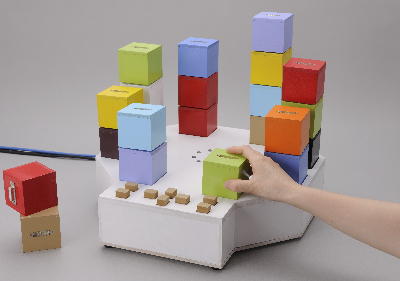

先週の「サウンドデザイン」の時に1106から台車を押してマルチメディア室に行って、なんとなく1106に持ち帰ってきた過去の学生インスタレーション作品(動態保存)の中に、現在はチームラボで活躍する、ゼミ/大学院卒業生のリュジュンヒー君の「カラーオーケストラ」がある。 これはきっちりと底部もネジ止めしてそこにゴム足を接着しているので、学生に中身を見せるためには分解しないといけないので、過去の記録(2012年前期、韓国・ホソ大学からの交換留学生としてSUACに来て僕のゼミで「総合演習II」として制作していた)を発掘してみた。 すると、まず キューブの内部回路 を一気に製作した記録(6月14日)が出てきた。

そして、この時期には学会出張で東大や立教大や博多などに行きつつ、 本体の内部回路 を製作した記録(7月3日)、そしてキューブとの連携を完成させた 本体部分完成、Boxチェック という記録(7月5日)が、AKI-H8ソースコードと共に出てきた。

その翌日にはキューブの内部回路を一部変更してリュ君のシステムが完成し(→あとはキューブの着色、そしてメインとなるMaxプログラミング)、さらに一緒に韓国・ホソ大学からの交換留学生として僕のゼミに来ていたイーギョンフン君のために「XBeeでWiFi送信する三味線」の製作まで完成させるという リュ君インスタ完成、イ君システム開発 という記録(7月6日)があった。 二人は無事に 「メディア造形総合演習II」最終合評 で完成作品を発表して、プロによる 撮影スタジオでの記録 も行って(完成版は これ )、9月末に韓国に帰ったのである。 二人の作品の詳細な記録(プレゼン/YouTube等)は SUACインスタレーション(3) のページの下の方にある。

ちょうどイー君がパフォーマンスする作品の背景映像部分には、彼自身が撮影した「浜松まつり」の御殿屋台引き回しの風景があった。 まさにこれが、COVID-19のために4年ぶりに昨日、復活した風景なのだった。 ちなみに例年であれば5月3/4/5日と3日間、「浜松まつり」の晩にはこの御殿屋台引き回しがあるのだが、今年は「松潤の騎馬行列」のために明日5月5日の浜松駅付近は完全に吹っ飛んでナシとなったので今日まで2晩だけである。

2023年5月7日(日)

昨日の「第8期叡王戦五番勝負第3局」をAbemaTVで途中まで観戦して帰宅したのだが、今朝の朝刊で「六冠堅持へ執念の逆転勝利」というのを知った。 2局連続で相穴熊というのも凄いが、「前局では相穴熊の対向形となり、思わぬ完敗を喫した藤井叡王。終盤で菅井八段に大きくリードを許したが、1分将棋の中で執念の粘りを見せての逆転勝利。六冠堅持へ大きな一勝を手にした。現役最強棋士の名に懸けて、同じ相手に同じ戦法で連敗するわけにはいかなかった。中盤から終盤にかけて劣勢となった藤井叡王だったが、菅井八段の猛攻に対して驚異的な粘り腰を披露。受けに回りながらも少しずつ相手玉に向かって前進し続けた執念が実り、逆転勝利をつかんだ」とのことで、 棋譜 を堪能した後で、さっそく このページ に追記した。

この連休に、ぼちぼち遅々として読んでいるのは(まだ半分ほど)、上の「せいすうたん」である。 出版予告の情報に即反応してAmazonで予約購入したのだが、いやいや何というか、うーん、凄い。 これぞ数学、ものすごく「凄い」のである。 たかが整数、されど整数。 数学の中でも、整数ほど恐ろしいものは無いのである。

上がその目次であり、当然ながら一つも知っているものは無く、さらに解説のどこを読んでも何も分からない。 この快感をどのように伝えればいいのか。 一つのトピックを二度読み、三度読みしても全く分からないので、何なら10度読みしてもいいので、トピックごとに見開き2ページの漫画を眺めて、そこから全く分からない解説を何度でも読める。 その行間から、全く分からないのに、人類が築き上げてきた叡智の片鱗と、その前に広大に広がる数学の深淵とを共に実感できるのである。 176ページ全12話と小ぶりの本であるが、これは何ヶ月でも楽しめるのだ。 「数学セミナー」の日本評論社なので当然だが、いやいや、いい本が出てくれた。【目次】 第1話 サブライム数 第2話 ロビンの定理 第3話 ゲーベル数列 第4話 シェルピンスキー数 第5話 アペリー数 第6話 弱い素数 第7話 鈴木の定理 第8話 ヴィーフェリッヒ素数 第9話 ウォルステンホルム素数 第10話 アンタッチャブル数 第11話 素数表現多項式 第12話 絵になる素数

2023年5月9日(火)

今週はたまたま「健康週間」となってしまい、一昨日の日曜日から禁酒(^_^;)が始まっている。 木曜日には胃カメラの予約が取れた関係で「一日人間ドック」(;_;)があり、その翌日には集団接種会場の予約が取れたので「COVID-19ワクチン」の6回目接種のためにアクトシティに散歩の予定がある。 今日は午前に準ゼミ高木さんのアポがあって「Max8プログラミング」と「新インスタレーションに向けての検討」を進めたが、昨日たまたま行った作業のために今朝は朝イチでSUAC財務室のWiFiルータを借りて研究室に持ってきた。実は昨日、SUAC財務室のWiFiルータを借りて、久しぶりに1106の全Mac(Max8の入っているもの)の再オーソライズをしたところ、何故かCycling'74のサイトが停止してうまく進まず、「8台のうち2台で何かトラブルみたいだけど」という苦情のメイルを出していたところなのだった。 そして今朝になってみるとCycling'74の担当者から上のようなメイルが届いていて、なんと昨日ちゃんと確認できていたマシンまで含めて、僕の全てのライセンスの状態をリセットしたのでまた入力してね・・・というものだったのだ。 まぁ、個々の番号を追いかけるよりも、全部クリアして新たにやってもらった方が、担当者としても楽なのだろう。Hello Yoichi, Thank you so much for contacting us. Our system shows the following licenses assigned to your account: Max 8 Academic Full. Order CYC210510-### purchased on 10 May 2021 Max 8 Academic Full. Order CYC201124-### purchased on 23 November 2020 Max 8 Academic Full. Order CYC200830-### purchased on 08 August 2020 Max 8 Academic Full. Order CYC190812-### purchased on 12 August 2019 I've reset all of machine activations so you should be able login where necessary.そこで仕方なく、上のように この日記のPart16 の「2023年1月17日(火)」のところにある情報を発掘して、上のように現在1106にある8台、そして自宅のmini(→おいおい)の計9台に古い方から3つのライセンスを割り当てることにした。 Cycling'74のサイトの「How many authorizations do I get?」によれば「1つのライセンスを所有している場合、Max8/Max7は一度に1台のコンピュータで実行できます。しかし、私たちは、多くの人が複数のコンピュータを持っていて、1つ以上の認証が必要であることを理解しています。そのため、同時にMaxを実行していない限り、3台までのコンピュータを認証することができます」(DeepL翻訳)とあるので、同時に起動したい場合にはネットを切って使えば1ライセンスで3台まで使えるので、ちょうどあと1ライセンス(3台)分だけ残っている状態になった。

- 13インチ 研究室 Air3 - 1.4GHz Core i5 4GB

Max 8 Academic Full. Order CYC190812-### purchased on 12 August 2019- 13インチ 研究室 MacBook(丸) - 2.26GHz Core 2 Duo 4GB

Max 8 Academic Full. Order CYC190812-### purchased on 12 August 2019- 13インチ 研究室 MacBook(四角) - 2.26GHz Core 2 Duo 4GB

Max 8 Academic Full. Order CYC190812-### purchased on 12 August 2019- 研究室 お仕事 Mac mini - 2.6GHz Core i5 8GB

Max 8 Academic Full. Order CYC200830-### purchased on 08 August 2020- 13インチ(無傷) Air4 - 2.2GHz Core i7 8GB

Max 8 Academic Full. Order CYC200830-### purchased on 08 August 2020- 13インチ(傷) Air4 - 2.2GHz Core i7 8GB

Max 8 Academic Full. Order CYC200830-### purchased on 08 August 2020- 11インチ(無傷) Air6 - 1.3GHz Core i5 8GB

Max 8 Academic Full. Order CYC201124-### purchased on 23 November 2020- 11インチ(傷) Air4 - 2.2GHz Core i7 8GB

Max 8 Academic Full. Order CYC201124-### purchased on 23 November 2020- 自宅 Mac mini - 1.4GHz Core i5 4GB

(Max 8 Academic Full. Order CYC201124-### purchased on 23 November 2020) ★まだ

2023年5月10日(水)

今日はゼミ、明日は人間ドック、明後日はワクチン6回目接種・・・と変なテンションの上がる週である。 朝、起床した瞬間に昨日の準ゼミ高木さんと進めていたRFID-Arduinoの課題(RFIDを外した、という状況を検出できない)の解決法に気付いてしまったので、まず研究室に出てきてこれをアッサリとやっつけた。 とりあえず現状だと0.5secごとにRFIDリーダをリセットするという荒技(^_^;)なのだが、受け手のMax8が不要なDump情報を捨てるので、何なら0.2秒間隔とかに変更するのもたぶん可能である。

参加者から 即興セッションキャンプ2023 の写真も届いたので、上の写真をそのトップに置いた。 そして昨日、1台だけやっていた作業の続きで残り1台の古い研究室在庫Mac miniの内部情報クリアを完了して、情報室に連絡し持参して引き取ってもらった。 さらに財務室に行って、昨日借用したWiFiルータの返却と共に、研究室資産として登録されていた4件(M1MacBookAir、Dynabook、iPad、USBハブSSD)も持参して返却してしまった。 これでだいぶ1106研究室に残っていた不要機材がクリーンアップ出来て、またまた棚がスッキリした。 これでまた、マルチメディア室のロッカーに眠るあれこれを1106に持ってこれる。

2限のゼミは このように 進んで、3限には久しぶりのM2・王さんの指導と続いた。 詳細は来週のゼミで皆んなに紹介することになるが、いやいやGENのグラフィックにセンサを組み合わせるというのは、僕も最近やっていたのだが、面白い瞬間が生まれる「偶然の数理造形」の楽しさに満ち満ちている。 皆んな、それぞれ確実に進展しているのは嬉しいことである。

2023年5月11日(木)

朝8時前にSUACから徒歩5分の遠州病院検診センターに行き、8時20分ぐらいから10時20分ぐらいまでかけてあれこれ検査をして、胃カメラを今年も口でなく鼻から入れた局部麻酔のために鼻水ズルズルで一旦研究室に帰ってきて、一休みしてお昼に再び遠州病院に行って豪華な昼食をいただき、午後にも追加検査と医師面談と栄養士面談を行って、4限の始まる時間帯に研究室に帰ってきた。 これが「1日人間ドック」であり、いったん自己負担する費用は4万円を超えた(大部分は後に健保組合から補助される)のだが、僕は毎年、大学での集団検診(無料)でなく、わざわざ予約して一日人間ドックを選択することにしている。そして、4限の学科会議は「新カリキュラムの検討」という議題なので予告通りに欠席して、5限の「情報ネットワーク専門部会」に出席するために帰宅(→今夜は禁酒明けで一杯(*^o^*))できないので、久しぶりにChatGPTを開いて、人間ドックでの医師面談で質問したりした事を聞いてみた。 上がその模様であるが、ネットの「健康情報サイト」とかで誰でも簡単に得られる情報より以上のものは皆無であり、呼び水としてその医師面談で得た情報をこちらから出しても、まぁ大した収穫は無かった。 全体として間違いは無いものの、やはり「ChatGPTとのおしゃべり」というのは、今日のように暇を持て余しているから行うものであって、これを「お仕事」としてやっていたらちょっと人間性が破綻しそうな予感(悪寒)がした。【質問】 人間ドックを受診してきました。目立った異常値として、LD(LDH)が335と高く、A/G比が1.30と低く、CRPが0.88と高い、 と出ました。ここから推定される問題点を教えて下さい 【回答】 人間ドックの結果に基づいて、いくつかの異常値が報告されているようですね。ただし、私はAIモデルであり、医療専門家ではありませんので、診断や具体的な問題点を確定することは できません。ただし、一般的な情報を提供できますので、参考程度にお考えください。 LD(LDH)の高値: LD(LDH)は乳酸脱水素酵素であり、高い値は細胞の損傷や炎症の兆候を示すことがあります。これはさまざまな状態や疾患と関連している可能性があります。具体的な 原因を特定するには、医師による追加の評価や検査が必要です。 A/G比の低値: A/G比はアルブミンとグロブリンの比率を示しています。低い値は肝臓や腎臓の病気、慢性炎症、タンパク質の不足などを示すことがあります。ただし、他の検査結果や 症状と組み合わせて評価する必要があります。 CRPの高値: CRPはC反応性蛋白質の略であり、炎症反応の指標として使用されます。高い値は炎症や感染の存在を示す可能性があります。具体的な原因や病態については、追加の 評価が必要です。 上記の結果は、医師によって総合的に評価されるべきです。専門家の助言を仰ぎ、さらなる検査や診断を受けることをお勧めします。医師が詳細な情報を提供し、適切な対応策を提案 してくれるでしょう。 【質問】 アトピー皮膚炎の持病があり、最近は身体あちこち痒くて寝ている間に無意識に引っ掻いて小さな傷が全身にあるのですが、 これは上の検査結果の原因となっていないでしょうか? 【回答】 アトピー皮膚炎は、慢性的な皮膚炎症の一種であり、痒みや発疹、乾燥などの症状を引き起こすことがあります。一般的に、アトピー皮膚炎の症状は炎症やかゆみを引き起こすため、無意識に 引っ掻くことがあるかもしれません。 アトピー皮膚炎によるかゆみや引っ掻きによる小さな傷は、LDHやCRPの異常値と関連している可能性はありますが、A/G比の低値との直接的な関連はないと思われます。ただし、アトピー 皮膚炎の患者さんは、炎症反応が高まりやすく、他の炎症性疾患や感染症のリスクも高まる場合があります。 痒みによる引っ掻きや傷は、皮膚の炎症をさらに悪化させる可能性があるため、注意が必要です。アトピー皮膚炎の症状の管理と治療は、皮膚科医の指導のもとで行われるべきです。医師に 相談し、適切な治療法やスキンケアのアドバイスを受けることをおすすめします。 【質問】 白血球は正常値でした。上の「LD(LDH)は乳酸脱水素酵素であり、高い値は細胞の損傷や炎症の兆候を示すことがあります」 というのが、「アトピー皮膚炎によるかゆみや引っ掻きによる小さな傷」と関係しているという見立てはどうでしょうか? 【回答】 LD(LDH)の高値は、細胞の損傷や炎症の兆候を示す可能性がありますが、特定の疾患や病態を指し示すものではありません。アトピー皮膚炎によるかゆみや引っ掻きによる小さな傷は、 皮膚の炎症反応や組織の損傷に関連していることがあります。 アトピー皮膚炎は、免疫系の過剰反応によって引き起こされる慢性的な皮膚疾患です。かゆみや引っ掻きによる小さな傷は、炎症反応や組織の損傷を引き起こすことがあり、これがLDHの 上昇につながる可能性があります。ただし、それぞれの症状や検査結果は個々の状態や病態によって異なる場合がありますので、詳細な評価や診断を行うためには、皮膚科医に相談する ことが重要です。 アトピー皮膚炎の管理や治療には、かゆみの緩和や炎症の抑制を目的としたスキンケア、抗アレルギー薬の使用、ステロイド軟膏の使用などが一般的です。症状の重症化や悪化を防ぐ ためにも、医師の指導のもとで適切な治療方法を検討することが重要です。 【質問】 LD(LDH)やA/G比の数値が正常値を外れていることと、飲酒との関係は強いのでしょうか。飲酒は止められないので心配です 【回答】 LD(LDH)やA/G比の数値が正常値を外れている場合、飲酒との関連性を評価するためには、より詳細な医療専門家の評価が必要です。飲酒が異常値に影響を与えるかどうかは、 個人の健康状態やアルコールの摂取量、他の病歴などによって異なります。 一般的に、長期間の大量の飲酒は肝臓に悪影響を及ぼす可能性があります。肝臓はアルコールの代謝を主に行うため、肝機能の低下や肝障害の発症が関連することがあります。その 結果、LDHやA/G比などの検査値に異常が現れることがあります。 ただし、個人の状況や医師の評価に基づき、具体的な診断とアドバイスが必要です。飲酒の習慣を持っている場合でも、医師に正直に情報を提供し、適切なケアやアドバイスを受ける ことが重要です。また、飲酒が健康に与える影響について心配な場合は、専門家やカウンセラーに相談することも検討してください。 【質問】 AST(GOT),ALT(GPT),γ-GP,ALP,コリンエステラーゼ,総ビリルビン,総蛋白,アルブミンについては全て正常値の範囲内です。私の 肝臓はまだ頑張って飲酒の友として活躍してくれるでしょうか? 【回答】 肝機能検査であるAST(GOT)、ALT(GPT)、γ-GT、ALP、コリンエステラーゼ、総ビリルビン、総蛋白、アルブミンの数値が正常範囲内である場合、一般的には肝臓の機能が正常である ことを示しています。ただし、肝臓の健康は単一の検査値だけで完全に判断できるものではありません。 飲酒による肝臓への影響は個人によって異なります。長期間の大量の飲酒は肝臓に負担をかける可能性があり、肝疾患や肝機能障害のリスクを増加させることがあります。ただし、現時点 では肝臓の検査値が正常範囲内であるため、肝臓はまだ良好な状態であると推測されます。 ただし、健康を保つためには飲酒の摂取量や頻度に注意を払うことが重要です。飲酒の過剰摂取は肝臓以外の健康リスクを引き起こす可能性もあります。生活習慣や飲酒に関する判断は 個人の自己責任ですが、適度な飲酒、バランスの取れた食事、定期的な健康チェックなどの健康習慣を維持することが肝臓の健康にとって重要です。 最終的な判断やアドバイスは、肝臓の専門家である医師に相談することをおすすめします。医師は、あなたの個別の状況を評価し、適切なアドバイスや予防策を提供してくれるでしょう。

2023年5月12日(金)