|

生体センサとMax4/MSP2による事例報告長嶋 洋一

1. はじめにコンピュータ音楽を中心としたメディア・アート、システムと人間とのインターフェース等に関するテーマの研究活動 とともに、その具体的な応用を実験的に検証する意味で、実際にいろいろなインタラクティブ・マルチメディア作品を 創作して公演・発表する活動を行っている(1-14)。オリジナルセンサを用いた実験的なシステムをリアルタイム パフォーマンスに応用することで、開発の過程や作品・公演の中から新たな研究テーマや課題が出てくることも多い。 サブテーマであるオリジナルセンサの研究開発に関して、 新しい筋電センサ "MiniBioMuse-III" (図1) については、既に2001年8月の音楽情報科学研究会にて報告した(15-18)。

図1 MiniBioMuse-IIIのセンサ片腕部分 本稿では、この"MiniBioMuse-III"を作品公演・パフォーマンスに活用した事例の報告を行う。2001年9月に フランス(パリ)とドイツ(カッセル、ハンブルク)で筆者が行った講演と、計4回の新作初演コンサートを含む、 音楽と工学を学際的に横断して行われた、 "Workshop on "Human Supervision and Control in Engineering and Music" という国際会議についても報告する。センサフュージョン情報のトラフィック、グラフィクスのミラーリング同時表示、 多チャンネル・ソフトウェアシンセシス、等の評価、その適切なチューニングによる作品実現のノウハウやTipsとともに、 マルチメディアアートのパフォーマンスプラットフォームとしてのMax4/MSP2(19)の性能と課題も検討した。 2. 2001年9月の欧州ツアーについて例年であればICMC (International Computer Music Conference)に参加することの多い筆者が、 2001年については例外的にキューバでのICMC2001参加を最初から断念して前年から進めたこの企画は、 1998年にJACOM (日本コンピュータ音楽協会)が神戸で開催したICMF1998 (International Computer Music Festival)、 および京都で開催されたIFAC-MMS 98 (7th Symposium on Analysis, Design and Evaluation on Man-Machine Systems) がその伏線であった。IFAC-MMS 98で「音楽への応用」セッションを組織したIEEEフェローのGunner Johannsen教授(Kassel大学) が、パネラとして同席した筆者の、新作 "Visional Legend"(笙:東野珠実)の公演を神戸まで駆け付けて聴いてくれたことがきっかけで、 日本の伝統音楽とComputer Musicとを融合したコンサートの企画が3年後に欧州で結実したのである。システム工学が専門であるが音楽にも造詣が深く、自らジュニアオーケストラを指揮するJohannsen教授の企画は、 地元Kasselで開催されるIFAC-MMS 2001に併設して、1998年の1セッションよりも拡大した国際ワークショップとして、 より工学と音楽との深い関係を議論しよう、というものであった。このため、世界中の工学と音楽の専門家数十名を招待し、 さらにオーケストラにおける指揮者の役割は工学的に高度なシステムの熟達した操作者と類似する、という視点から、 リハーサル公開を含むオーケストラコンサートを企画した。演目はベートーベンとコープランドの交響曲、そして 武満徹の「ノベンバー・ステップス」については尺八演奏家として京都の三好芫山・大師範を指名するとともに、 筆者の作品 "Visional Legend"(笙:東野珠実)を欧州でも再演して欲しい、という招待であった。もちろん、 現代音楽だけでなく日本の古典音楽の紹介も重要な意義であった。

筆者はこの招聘を受け、国際交流基金にメンバーの渡航費の助成を申請した。会議参加者の旅費補助と全参加者の現地滞在費、

コンサート経費、演奏家報酬等もフォルクスワーゲン財団が助成した。東野珠実氏が企画していた、フランスのCCMIXでの

交流企画とも合体して、ここでも筆者がインタラクティブComputer Musicのワークショップを開催し、デモンストレーション

コンサートを行うこととなった。以下は国際交流基金への企画申請書の抜粋である。

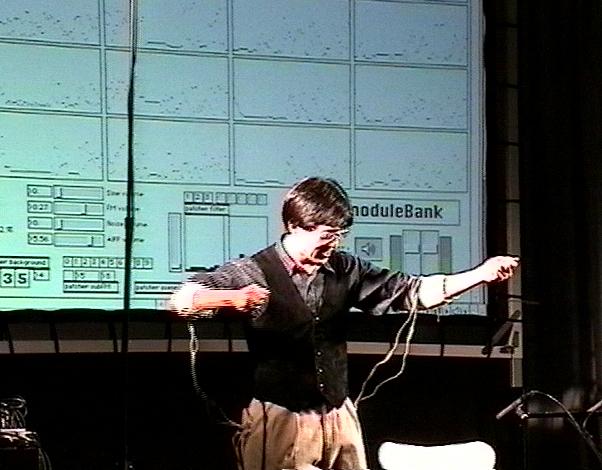

3. "MiniBioMuse-III"のセンシング情報図2は、"MiniBioMuse-III"の両腕16チャンネルのセンシング情報をリアルタイムに表示するMaxパッチの画面である。 中核にあるマイコンAKI-H8の処理能力としては十分に高速なデータ収集が可能であるが、実際にはMIDI情報を受信する Maxの側でのトラブルに悩まされた。図2 MiniBioMuse-IIIのMIDI出力情報の例 図2は、Max3.6.2の走るPowerBook2400/G3 (320MHz)の画面のスクリーンショットであるが、このMacはシリアルポート経由 のMIDIインターフェースであるために、10msec間隔で16channelsを連続受信して、さらにこの画面を外部ディスプレイにミラー リング出力しても何も問題が起きなかった。ところが、まったく同じこのMaxパッチを、PowerBookG3(400MHz)で走らせ、 スクリーンをミラーリング出力したところ、ほぼ確実に深刻なフリーズが頻発して使えない、という現象に遭遇した。最大の原因は MIDIインターフェースがUSB経由となったためと思われ、OMSが十分にUSB対応できていないらしく、この段階でライブでの使用には 大きな不安となった。その後、主にMSPの信号処理関係が充実してMSP1.0からMSP2.0となった新しいMax4/MSP2(19)がリリース されたが、どうやらMIDI周辺は今後はUSBでいくしかない、という気合いの入った改良が行われたらしく、一挙に状況は改善された。 それまではQuickTimeのGM音源でも不安だったMIDI処理が非常に軽快になり、図2のようなライブグラフィクスとともに音源部分を MSPのソフトウェアシンセシスとした状態でも、iBook(500MHz)とUSBインターフェースで安定して動作することが確認できた。 この状況を受けて、欧州公演では初めて、MSP音源による作品のライブ演奏を決意した。それまではKymaやSuperColliderをMaxの MIDIで制御する、と限定してきただけに、筆者としてはやや勇気ある挑戦となった。これは、多数のMIDI音源等に対してMaxやシーケンサ 等から「MIDI出力」する分にはUSB-MIDIであってもまったく問題がない(暇な時に処理するので多忙ならモタりつつ遅れてMIDI送信する だけ)のに対して、多量のセンサ情報をライブで確実に受信するインタラクティブアートの宿命である。 4. "BioCosmicStorm-II"のメイキング図3は作品"BioCosmicStorm-II"のメインパッチの実行モード画面、図4はその編集モード画面である。作品の公演においては、 このiBookの画面ミラーリング出力をステージ後方の大型スクリーンにプロジェクションして、筋電情報が ライブに検出され、そこからリアルタイム楽音合成のパラメータとして音響に作用していることを作品のコンセプトとして明確に表現した。 センサ等を用いたインタラクティブパフォーマンスにおいては、「センサ技術のデモではない」という視点から、このように明確な 関係性を敢えて提示しないことも少なくないが、聴衆はせっかくのライブPerformerの動きとサウンドやグラフィクスとのリアル タイム連係に気付かず、ビデオやCDを「再生」して、それに合わせて何か動いている、と悲しい誤解をされることも多かった。 この点で、今回の作品公演では少なくとも「見えた」聴衆にはなかなか好評であった点が一つの収穫であったと思う。図3 作品"BioCosmicStorm-II"のメインパッチ 図4 作品"BioCosmicStorm-II"のメインパッチ(編集モード画面)

4-1. センサ情報のgating図5は、センサからMaxに入力されたMIDI情報をまずゲートする関門である。これ無しでは心配で何もできない、定番ノウハウである。図5 センサ情報のゲート群

4-2. シーン移行の管理図6は、スタートから時間的に全体のシーンが推移していく流れを管理する、一種の柔軟なシーケンサのようサブパッチである。 この作品では作曲者本人がperformanceを行ったので、シーンの推移について伝達する苦労は不要であった。画面の片隅には、 シーンの推移と同期して、テキスト表示で「現在はFM音源アルゴリズムの音です」というような内幕暴露サービスを行って みたが、これは賛否両論であった。図6 シーン移行の管理部分

4-3. 背景音響パートの再生図7は、作品全体の背景音響として流れるパートの「再生」サブパッチである。音響素材はあらかじめIndyとKyma等を 用いて作曲した。この作品ではほぼ演奏時間は一定であるが、BGMパートをCDに固定して再生するのはポリシーに反する こと、7分近い1本のサウンドファイルを再生することへの心配、オーバーラップ再生して重ねる部分にある程度の自由度を 持ちたかったこと、等の理由で、約1分の長さに分割して順番にオープンしてはplayする方式とした。図7 背景音響パートの生成部分 なお、2002年1月に東京都写真美術館で発表したインスタレーション作品では、逆に20分ほどの長大な背景サウンドパートを CD化してMSPでエンドレス再生し、その音量をコマ切れに絞って複数のサウンド生成を行った。新しいバージョンのMSPでは、 いずれも容易である。 4-4. オシレータバンクによるサイン合成図8は、センサからの16チャンネルのそれぞれに対応したサイン波ジェネレータによる、サイン合成ブロックの実験風景である。 ここからはいよいよ音源そのものとしての信号処理となるために、常にDSP稼働率を表示・監視して、過重な処理によるシステム ダウンを警戒した。最終的には、このブロックは多数のオシレータバンクのピッチ情報としてセンサ出力をそのままマッピングする だけで、イメージ通りの混然とした音響を得ることができた。図8 サイン合成の部分

4-5. Suguru Goto氏によるFM合成図9は、音源のメインとなったFM方式による音響生成ブロックのサブパッチである。この作曲期間である2001年8月に、 筆者はIAMASが開催するDSPSSに参加し、IRCAMで活動しているSuguru Goto氏と再会した(Goto氏はパリでの筆者の CCMIXワークショップにも来訪した)。Goto氏は従来から、センサを活用した作品とそのパフォーマンスにおいて、 ISPW / jMax / MSPなどを活用してFM方式の音響生成に手慣れた作曲家であり、このDSPSS2001の機会に、講師と してGoto氏が提供したMSP4のためのFMサンプルパッチをさっそく材料として活用したのがこのブロックである。 Max/MSPのパッチはオープンソースの発想で世界中に提供されている、その文化の恩恵を受けた形となった。なお、 比較的少数のオペレータでも面白いサウンドを生成できるFM方式であるが、音の分厚さを求めてオペレータを多数に していくと、DSP稼働率が上がって不安定な状態となったため、最終的にはトライ&エラーで現実解を捜した。あくまで 体感であるが、ピーク時でも33%程度が上限となる目安でチューニングした。図9 FM合成の部分

4-6. FFTバンクによるフィルタ音源図10は、センサからの情報をFFTバンクによるマルチバンドフィルタの周波数とレゾナンスのデータに変換し、 このフィルタにホワイトノイズを入力して音源とした部分のサブパッチである。アナログシンセサイザの感覚であった。図10 フィルタによる音源の部分

5. おわりに筋電センサ"MiniBioMuse-III"を活用した新作"BioCosmicStorm-II"のメイキング等について報告した。人間の振る舞い、 あるいは息づかいなどの連続的な情報とメディアアートとの熱い関係をさらに求めて、今回の公演はさらに新しい次の ステップにつながることとなった。公演作品そのものだけでなく、センサやシステムやソフトウェアもまた作品の重要な 一部である。その発展した内容や結果は、またいずれ次の機会に報告したい。参考文献[1] Y.Nagashima : Multimedia Interactive Art : System Design and Artistic Concept of Real-Time Performance with Computer Graphics and Computer Music、Proceedings of Sixth International Conference on Human-Computer Interaction(ELSEVIER)、1995年[2] Y.Nagashima et al. : A Compositional Environment with Interaction and Intersection between Musical Model and Graphical Model --- "Listen to the Graphics, Watch the Music" ---、Proceedings of 1995 International Computer Music Conference、1995年 [3] 長嶋洋一 : マルチメディア・インタラクティブ・アート開発支援環境と作品制作・パフォーマンスの実例紹介、 情報処理学会研究報告Vol.96,No.75 (95-MUS-16)』(情報処理学会)、1995年 [4] 長嶋洋一 : センサを利用したメディア・アートとインスタレーションの創作、京都芸術短期大学紀要[瓜生] 第20号1997年、1998年 [5] 長嶋洋一 : 生体センサによる音楽表現の拡大と演奏表現の支援について、情報処理学会研究報告 Vol.98,No.74 (98-MUS-26)、1998年 [6] Y.Nagashima : Real-Time Interactive Performance with Computer Graphics and Computer Music、Proceedings of the 7th IFAC/IFIP/IFORS/IEA Symposium on Analysis, Design, and Evaluation of Man-Machine Systems、1998年 [7] Y.Nagashima : BioSensorFusion:New Interfaces for Interactive Multimedia Art、Proceedings of 1998 International Computer Music Conference、1998年 [8] Y.Nagashima et al. : "It's SHO time" -- An Interactive Environment for SHO(Sheng) Performance、Proceedings of 1999 International Computer Music Conference、1999年 [9] 長嶋洋一 :マルチメディアComputer Music作品の実例報告、情報処理学会研究報告 Vol.97,No.71 (94-MUS-7)、1994年 [10] 長嶋洋一 : 「身体情報と生理情報」、長嶋・橋本・平賀・平田編「コンピュータと音楽の世界」、共立出版、1997年、pp.342-356 [11] 長嶋洋一 : 「コンピュータサウンドの世界」、CQ出版、1999年、pp.148-166 [12] 長嶋洋一 : メディアアートにおける画像系の制御について、情報処理学会研究報告 Vol.2000,No.76 (2000-MUS-36)、2000年 [13] 長嶋洋一 : 静岡文化芸術大学スタジオレポート、情報処理学会研究報告 Vol.2000,No.118 (2000-MUS-38)、2000年 [14] 長嶋洋一 : インタラクティブ・メディアアートのためのヒューマンインターフェース技術造形、静岡文化芸術大学紀要 第1号2000年、2001年 [15] 長嶋洋一 : 新・筋電センサ"MiniBioMuse-III"とその情報処理、情報処理学会研究報告 Vol.2001,No.82 (2001-MUS-41)、2001年 [16] Atau Tanaka : Musical Technical Issues in Using Interactive Instrument Technology with Application to the BioMuse、 Proceedings of 1993 International Computer Music Conference、1993年 [17] William Putnam : The Use of The Electromyogram for the Control of Musical Performance、Doctoral Thesis of Stanford University、1993 [18] 藤原義久・前川聡、「独立成分分析による筋電データからの各指運動の分離」、信学技報MBE99-7、電子情報通信学会、 1999年、pp.41-46 [19]ノイマンピアノ(赤松正行+佐近田展康):「トランスMaxエクスプレス」、リットーミュージック、2001年 [20] Y.Nagashima :Composition of "Visional Legend"、Proceedings of International Workshop on "Human Supervision and Control in Engineering and Music"、2001年

|