Max7日記 (1)

長嶋 洋一

2016年6月1日(水)

新学期となって2ヶ月、2016年も折り返しが見えてきた6月1日、久しぶりに過去を振り返る時間が取れた。 先月上旬まで続いていた「日記シリーズ」の最後は、 postGainer日記(5) の「2016年05月11日(水)」だったので、20日ぶりである。 これまでの「日記」シリーズと掲載期日は、前史となる「あらえっさっさ日記」と「Sabbatical2004」を加えると、以下のようになっていた。そして postGainer日記(5) の最後の「2016年05月11日(水)」のあたりで1106研究室に届いた電子ドラムセットは既に常設設置でなく片付けられた。 その週末には 日本音楽知覚認知学会(博多) に行って、さらに翌週には Team「さば」の記録 をしたり、 某作家のシステムを製作 したり、 情報処理学会音楽情報科学研究会(東京) に行ったりした。

- あらえっさっさ日記

- 「あらえっさっさ」の日記 2002年8月1日〜2002年9月1日

- Sabbatical2004

- Sabbatical2004 2004年7月26日〜2004年9月21日

- Propeller日記

- Arduino日記

- Arduino日記 2008年5月30日〜2008年7月5日

- Processing日記

- SuperCollider日記

- 続・Propeller日記

- 続々・Propeller日記

- RaspberryPi日記

- PureData日記

- PureData日記 2013年8月24日〜2013年9月9日

- Max6日記

- mbed日記

- Myo日記

- Myo日記 2015年2月15日〜2015年3月31日

- Xcode日記

- postGainer日記

そして、 postGainer日記(5) の最後の「2016年04月30日(土)」にあったように、照岡さんと僕とで進めていた最新の筋電センサ基板についてはSparkFunのCEOから「ご免なさい」のメイルが届いて、上のように紹介された「PCB:NG」も、ガーバーまで設計しないと試作できないと判明して、候補から落ちた。 そこで我々は腹を括って、以下のように照岡さんの気合いの入った回路設計とともに再開した。

回路図とともに「P板.com」に出す設計を照岡さんが進めるのと同時進行で、限られた時間をみて少しずつ、 part1、 part2、 part3、 と小分けに検証回路の製作を進めてきた。 そして昨日、遂に完成して、以下のように筋電センサ回路としての動作を確認できた(^_^)。

ここからが大変で、もはやCQ出版「インターフェース」誌の特集記事を書いてから1年以上も経過してほとんど忘却の彼方だったので、 筋電センサ関係情報 のページから過去の記録を探訪して、ホストNucleoF401REに最後に書き込まれたファームウェアがどうやら リサジュー認識の実装 であると発掘して、 mbed日記(3) の「2014年12月19日(金)」あたり(1年どころでなく1年半も昔(^_^;))にある、と見定めた。 そして、なんとかNucleoF401REに載せたこの試作基板からXBee経由で届いた情報で、 リサジュー・サウンド というMaxパッチで以下のように動作確認したところである。 CQの時の筋電センサ回路に比べて、やや出力レンジが狭いような気もするので、再度、NucleoF401REファームウェアとともにさらに過去に遡って調べてみる必要がありそうだ。

そしてこの間に、この日記のタイトルでもあるMax7についても進展した。 前期の講義「サウンドデザイン」・「音楽情報科学」でずっとMax7を使うようになって、あっという間に過去のMax6からMax7に慣れたこともあるが、ちょっとした懸案(宿題)だったMaxパッチも、 日本音楽知覚認知学会(博多) の合間の内職で319枚の素材データを選択し、 情報処理学会音楽情報科学研究会(東京) の合間の内職で完成してしまった。 よくある以下のようなものであり、素材の静止画がマス目で次第に開いていく、というものだが、 このように いろいろなバターンを用意してみた。

これ以外の空白期間についてメモしておくとすれば、去年の夏の SI2015(シンガポール) での発表が、ようやく ICMAの論文サイトに SI15発表論文 として掲載された(^o^)、という案内が届いた。 また「欧露ツアー」に関しては、 ICMC2016 への応募論文が採択されたのに続いて、 VS-Games2016 への応募論文も採択され(ただし3人のreviewerのうち2人がreject、1人がborderlineという謎の判定(^_^;))。IEEEのサーバがWordソース提出という邪悪な条件のため、レイアウトがぐちゃぐちゃに壊れたまま、Pagesからexportしたdocで「finalize」した。 本来であれば このようになる 筈のものであり、Referencesの末尾にこのURLを「correct PDF of this paper」と置いてみた。 果たしてどうなるか(^_^;)。

Dear friends, to conclude the tIM 2016, we have been proposed by the Rocher de Palmer to share the evening with a "stars evening" during which the audience will be invited to discover the sky through 4 telescopes with comments by scientists. We are invited to take part in this evening with improvisations or written pieces dedicated to the event. Link: http://abera.unblog.fr/ (organizers of the evening, sorry only in french) Schedule Friday 2d of September: 6.00 pm: concert (max: 1h30 of music) 8.00 pm: dinner (paella) 10.00 pm: "stars evening" Thanks for proposals and ideas. Of course, the evening is not compulsory. Didier Marc GARINそして、欧露ツアーの冒頭にあるtempora2016については、上のような続報が届いた。 最終日の晩に、4つの望遠鏡と科学者が集って「stars evening」というイベントが企画されたというので、さっそく「improvisationで参加する」と表明した。 ただしサウンドのみで、クラフィックス(プロジェクタ)は使えないだろうから、おいおい作戦を練って準備していきたい。 3つの国際会議とともに、ますます中身が充実しそうである。

そしてここから試したのは、「音楽情報科学」のテーマで「ドット絵をする、という須佐さんとの話の中で発見した、上の「ランダムドット・ステレオスコーブ」制作ツール「Sirds」である。 AppStore経由で600円で購入したが、どうも落としたアプリはそのまま他のMacにコピーするだけで使える模様である。 しかし、色々と試してみると、なかなかにチューニングが難しいと判明した。 試行錯誤は面白いが、わざわざ研究室で進める作業でもないそうなので、次の学会出張(時間学会・京都)の内職にする事にしたが、Maxでこのツールそのものを作るというのはちょっとチャレンジングかもしれない。

2016年6月2日(木)

「ひと晩、寝て待て」という言葉には重いものがある。 昨日の筋電センサ回路の実験では、どうも感度が悪い、そんなにゲインを下げていないのに・・・という疑問があった。 CQの記事の時には、異なるパターンで記録した筋電情報をサウンドファイル化して治具で再生していたが、それより近接した場所とはいえ、こんなにリサジュー解析で「差」が出ない筈がないのに、という印象だった。

そこでまず、上のように、照岡さんの設定した「パフォーマンスモード」でHPFのコンデンサを0.033μFにしたのが影響しているかも・・・と、「ノーマルモード」のために並列に0.33μFを接続してみた。 そして、ここで改めて以下のようにNucleoF401REのソースをmbedサイトで開いたところで、忘却の彼方にあったための大バグを発見した。

つまり、以下のNucleoF401REソースの赤い部分を忘れていたのを見落としていたのである。 これは筋電センサ回路の出力をチャンネル[0]とチャンネル[1]に接続しつつ実際にはシールド基板を挿さず、筋電情報ファイルを再生する治具からの電圧をチャンネル[2]とチャンネル[3]に接続するために、NucleoF401REのアナログコネクタ上で、[0]と[2]、[1]と[3]を接続するジャンパを繋いでいたのである。 つまり昨日の「あまりに微弱な変化」とは、接続されていないアナログ入力端子に、誘導で乗っていた微弱電圧変化だったのだ(^_^;)。

#include "notch.hpp" int main(){ common_setup(); int Lissajous = 50; xbee.baud(38400); xbee.attach(&rx_fifoset, xbee.RxIrq); timer_setup.attach_us(&timer_interrupt, 5); // 5usec while(1){ tx_fifo_check(); if(timer_value[1] > 19){ // 0.1msec sampling timer_value[1] = 0; data1 = (float)gain * (analog_value2.read() - 0.5f); // A/D in (3) if(data1 < 0) data1 = -data1; // always detection ON if(notch_1 != 0) data1 = notch_filter1(data1); data2 = (float)gain * (analog_value3.read() - 0.5f); // A/D in (4) if(data2 < 0) data2 = -data2; // always detection ON if(notch_2 != 0) data2 = notch_filter2(data2); data3 = (float)Lissajous / 10.0 * (data1 - data2) * sqrt( data1*data1 + data2*data2 ); } if(timer_value[2] > 999){ // 5msec timer_value[2] = 0; if(max_count != 0) data3 = move_mean_calc2(data3); tx_message(0x400000 + ((uint16_t)((data3 + 1.0f) * 2047)<<4)); } if(timer_value[0] > 199999){ // 1000msec timer_value[0] = 0; myled = !myled; } if(rx_fifo_check() == 1){ int sum = 0; for (int i=0; i<6; i++) sum += conv_hex(raw_data[i])<<(4*(5-i)); tx_message(sum); // Echo Back if(sum>>16 == 0x80){ switch((sum & 0xff00)>>8){ case 0x00: // fir_lpf = sum & 0x01; Lissajous = sum & 0x7f; break; case 0x01: gain = sum & 0x0f; break; case 0x02: max_count = sum & 0x7f; if (max_count>100) max_count = 100; sum_clear(); break; case 0x03: notch_1 = sum & 0x01; break; case 0x04: notch_2 = sum & 0x01; break; case 0x05: coef_set(sum & 0x3f); break; case 0x06: // emergence = sum & 0x01; break; } } } } }こうなればあとは一直線である。 まずは以下のように、せっかくなので照岡さんも設置を推奨しているDIPスイッチを0.33μFのところに入れてハンダ付けナシに両方のモードを切り替えられるようにして、改めて新しいディスポーザル電極で実験することにした。

そして結果は以下のように、見事にリサジュー認識で強調された筋電サウンドを再現することが出来た。 昨日ではまったく見えていなかったが、「ひと晩、寝て」みると、こういうあたりまで思い出して「見えて」くる、というのが、試作実験の醍醐味である。(^_^)

これでとりあえず、照岡さんの回路の確認ができたので、メイルで連絡することにした。 だいぶ思い出してきたので、おいおい、mbedのサイトからNucleoF401REの新しい実験に入っていきたいところである。

そして2限には有志3人の音楽理論講座、3限には「サウンドデザイン」の課題1合評とMSP入門を終えて、研究室に戻ってきてからしばし、昨日の「音楽情報科学」で話題だった「ランダムドット・ステレオグラム」をYahoo.com画像検索から調べて、「簡単に立体視が見えた」という50個を厳選してみた。 ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★ ★

ところがここで判明したのは、 立体視は疲れる という真実であり、突然にパタッと全て、立体視が見えなくなった事に気付いた(^_^;)。 僕がランダムドット・ステレオグラムを「見える」のは、眼鏡を外して視力が落ちた状態の方が良好であるが、それでも疲れると駄目だった。 モノによっては交差法に切り替えると見えるものもあったが、平行法というのはかなり不自然なものなのだ、というのは収穫である。

2016年6月3日(金)

昨日の昼間から突然に「飛蚊症」を発症した。 ランダムドット・ステレオグラムを凝視し続けたのが原因かどうかは不明だが、まだ慣れていないので、常に右目の視界にはあれこれ飛んでいる(^_^;)。 さらに暗いところでは「閃光」が視界を走るが、これもWikiPediaで問題ない、と確認した。 シリアスな病気ではなく、いずれ慣れて気にならなくなるとはいえ、なかなか新鮮な現象である。 僕の左目は視力良好の健康優良児だが、これで右目だけ、「視力が悪い」「乱視」「緑内障で左上1/4が見えず」「軽度の白内障」に加えて「飛蚊症」まで完備したことになる。 人間は眼が2個あるのでなんとかなっているが、1個だったらエラいことである。

朝イチで照岡さんのメイルで基板の進捗を確認して、昨日の日記の最後に置いた「動くランダムドット・ステレオグラム」を見てみると、飛蚊症にもめげず、眼鏡をかけていてもサッと立体視が実現できた。 やはり、披露によって立体化しにくくなるようなので、あまり凝視を続けるのはやめた方がいいようだ。

今日は3限にブンちゃん特訓講座、5限に「サウンドデザイン」があるが、昼休みにはまたまた新入生5人が1106にやってくる。 これは明日のカラオケマラソン(新入生の希望者と行うシリーズの6回目)の打ち合わせなのだが、今年はこのシリーズの収穫がとても大きい。 昨日のアカペラでは新入生の参加者5人(全てこの新歓カラオケで見込んで声をかけたら来てくれた)とともに歌いつつ、上の受験生向けSUACパンフレットに乗った須田さんの記事を紹介したが、なんと以下のようにSUAC公文書に、サークルでもない非公認任意団体のアカペラが載ってしまったのである。(^_^;)

そしてここから今日の空き時間は全て、しばらく放置していた、 この日記の「2016年02月19日(金)」 の続きに没頭する一日、と決めた。 MediaArtNet のサーベイ、というお勉強である。 ぼちぼち、来月のNIME2016参加に向けて、英語モードも鍛えていかなければいけないので、必然とも言える苦行なのだ。

2016年6月7日(火)

照岡さんの筋電センサ基板の制作進捗を待ちつつ、ゼミやUD-Musicや「サウンドデザイン」であれこれMaxプログラミングを進めつつ、基本的には MediaArtNet のサーベイを毎日、何時間か進める、という修行の日々である。 ただし、この週末に近づいてきた時間学会での発表の準備もときどきチラッと頭をよぎる(^_^;)。

Dear fellow Musicians and Composers, We are a Singapore-based team, who will be presenting our ongoing project "time:space". This project was conceived by Robert Casteels, Dirk Stromberg, and Andrew Thomas. The work is composed for fixed media, psychoacoustic diffusion, Sphere, Strombophone, any four instruments or instrumental groups, live processing and video. The work was made possible by a research grant through the National Arts Council of Singapore. The work led to the development of a flexible psychoacoustic diffusion program, the electronic instrument "Sphere" as well as the composition itself. Robert and Dirk composed "time:space" to explore the physical space through diffusion as well as the collaboration with different performers. This includes the participation of various performers ncluding dancers, traditional and classical musicians. The performers engage with the work through an open instrument graphic score. At the International meeting of in Bordeaux this year, we will be presenting an excerpt of "time:space". You can also find out more about it at timespace.sg. Therefore, we are seeking collaborators from anyone interested in 3 ways: 1. to perform with us in our presentation of "time:space" in Bordeaux, 2. to collaborate with others in their presentation, and 3. to seek other creative possibilities, such as us performing un your piece. ... We look forward to hearing from you.そしてtempora2016参加者のMLからは、上のように「time:space」というグループからのメイルが届いた。 シンガポールからのサポートを受けたこのプロジェクトの総集編として、ボルドーに参加するらしい。 さっそく「http://timespace.sg」にあった作品紹介やビデオを見たが、多数の静止画素材を撮影してのスライドショーに古式床しい電子音響音楽のBGM、というビデオ作品で、ちょっとここに手を挙げてコラボレーションを申し込む・・・という感じはしなかった。 とりあえずは様子見である。 他にも出てくれば、僕も何か提案して仲間を募る必要があるかもしれない。

2016年6月9日(木)

日々の怒濤のあれこれに追われて MediaArtNet のサーベイも遅々として進みつつ、いよいよ週末の時間学会のプレゼンを作らなくては・・・というプレッシャーが高まる日々である。 そんな中、ゼミでも「音楽情報科学」でも焦点はCVにまとまってきたのを機に、あちこちに分散していた、これまでにMaxで作ったパッチ群を大整理する、という長年の懸案に取り組んだ。 なんせ現在のMaxはMax7であるが、頑張ると、1990年代半ば(20年以上も昔)の、Max2.5.2のパッチですら再現可能なのである。 こんな継承性のある開発環境アプリケーションは他に無いのではないだろうか。

ということで、まずは上のように、「お仕事Mac mini」と「出張(公演)MacBookAir3」の、ドキュメントフォルダを確認した。 この中の「Max」というフォルダを整理して、ファイルが多数ある古いフォルダをzipにまとめる、という作業である。 そして、以下のようにその全貌が明らかになった。 まさにこれは長嶋洋一の歴史、「Maxとともに歩んだ25年」という感じである。(^_^)

2年目となった某T○Y○T○との共同研究の予算で新しいMacBookAir(クロックを上げてメモリを8GBに)を注文していて、上のMaxアーカイブの全ても入れつつ今年の欧露ツアーのメイン機「MacBookAir4」となる。 ただし、突然にホテルでMacBookAir1が即死して(帰国後に蘇生)、ウイーンのAppleStoreでiPad miniを急遽購入した苦い経験 ★ ★ から、今年はiPad miniとMacBookAir3も一緒に持参する予定である。

ちなみにMacBookAir1はYosemiteを経てEl capitanまで上げたが、なんとトラックパッドの手前にあるクリックパッドがハードウェア的に不調(OFFにならない(^_^;))となってほぼ引退モード(トラックボールを接続しないと使い物にならない)、また退職教員のお下がりを受け取ったMaxBookAir2も、原因不明の「起動したりしなかったり」を繰り返すので死蔵モードに入っている。 要するにMacBookの「ばりばり活用」寿命はまぁ長くて4-5年、想定としては3年で乗り換える必要がありそうだ。

2016年6月12日(日)

京都工繊大の60周年記念会館での、日本時間学会大会の会場である。 毎年恒例、「時の記念日」に近い昨日と今日の開催であり、去年は札幌での日本音楽知覚認知学会に参加するために山口大での時間学会をパスしたので、2年ぶりの参加となった。 ただしこの週末には、東京でバイオフィードバック学会の大会があり、そちらは泣く泣くパスしている。 既に昨日、発表を終えて、今日は午前の時間学会総会、午後の一般発表の聴講、という余裕のモードで、ようやくこのページを書く余裕が出来た。 昨日は朝イチで研究室に出て、浜松から京都に向かう新幹線の中で、ゼミの馬ブンさんのインスタレーション作品のためのMaxパッチを改訂して、かなり処理が軽くなった。 まだまだ途中経過であるが、以下のようなパッチを今朝、ホテルからブンちゃんにメイルで送った。

時間学会の一般講演のプログラムは以下であるが、昨日は「プリゴジンは言い過ぎである」というような面白い発表、さらに一般相対論を熱力学に適用して時間の対称性を否定する、というほぼトンデモ系スレスレの発表もあった。 これだから時間学会は楽しいのである。(^_^;)

今日の総会ではこれまでと違って「新入会員から一言」というコーナーがあったが、院生だけでなく、医者、弁護士、などなど多様なメンバーに圧倒された。 臨床心理学者とか外人の数学者とか、すごいものである。 そして昨日は、開催地の京都工繊大の小山先生につかまって千葉大の一川先生に繋がれて、なんと「時間学会の理事になってくれ」という驚くべきオファーがあった。 時間学会が学術会議で正式な学会としてスタートしたところ、理事など役員がほとんど山口大学の関係者でマズイ・・・というのが理由らしいが、基本的に何でも引き受ける僕は、謹んでお受けした。 情報処理学会音楽情報科学研究会の運営委員を長らくやってきたが、現在は学会の役員はやっておらず、これは新たなスタートということになる。 総会の場で、「新理事」ということで並ばされて承認されて、儀式は恙無く終了して、来年度は山口大の開催となった。 これは来年はまた山口に行く、という予定がほぼ確定した。

【統計/心理学】「危険を感じた瞬間に物事がスローモーションに見える」という現象が実際に生じることを確認 『「危ない!」の瞬間,全てがスローモーションで見える』は正しかった! 強い感情が視覚の“時間精度” を上昇させることを 世界で初めて確認 - 日本の研究.com - https://research-er.jp/articles/view/46637 千葉大学文学部認知心理学研究室の一川誠教授及び千葉大学文学部の卒業生の小林美沙は,画像観察で生じる 感情反応や印象が視覚の時間精度(※)や感じられる時間の長さに及ぼす影響を調べました.その結果,危険を感じた 瞬間に物事がスローモーションに見えるという現象が実際に生じることが確認されました. ※時間精度とは:短時間に処理できる能力 ■研究の背景:感情が視覚の時間精度に及ぼす影響 交通事故の瞬間や高いところから落下する瞬間など,突発的に危険な状況に陥った時に,物事がスローモーションの ように展開して見えた,その間の時間が長く感じられたという報告がしばしばなされます. こうした体験に感情による視覚の時間的精度の上昇が関わっているのか調べた過去の研究では,感情と対応して 視覚の時間精度が上昇することは確認されませんでした. ■研究の手法:画像観察を用いた実験 本研究では「(1)視覚の時間精度を測る実験」及び「(2)感じられる時間の長さを測る実験」により,画像観察で引き 起こされた感情や印象の強度と(1)時間精度や(2)感じられる時間の長さとの関係を調べました. 実験では,様々な強度の感情反応や印象を引き起こす画像のデータベースから,危険や安全の印象を生じるカラー 画像24枚を選びました. 16名の大学生(女性9名,男性7名)が実験に参加しました. (1)視覚の時間精度を測る実験 各画像を1秒間提示した後,10〜60ミリ秒の範囲で画像をモノクロに切替え,モノクロ画像が見えるのに必要な 最短時間を測定しました.その結果,危険を感じ,強い感情覚醒反応を引き起こす画像を見ると,短い時間でも モノクロ画像への切替えが気づかれました.これにより,危険な状況に陥ったときに,通常より早く視覚情報が 処理される可能性があることがわかりました. (2)感じられる時間の長さを測る実験 0.4〜1.6秒の範囲で各画像を提示し,1秒間の長さに感じられるのに必要な時間を測定しました.これにより, 危険を感じさせる画像の見えている時間は実際より長く感じられることが確認されました.また,(1)の実験の結果 との相関は認められませんでした. ■研究のまとめ 2つの実験の結果,危険な状況に陥った時に事態がスローモーションのように展開するように感じるということが 証明されました.短い時間のうちに通常よりも早く情報を処理することができれば,的確に身をこなすことでケガの 程度を軽くするなどして生存可能性を高めることになると考えられます. 本研究成果は,Japanese Psychological Research, Vol.58, No.3(日本心理学会の国際誌)で公開されます. (2016.7.1発行)初代の辻先生から引き継いで、新しい時間学会の会長となった千葉大の一川先生は、ここ1年もあちこち、基礎心理学の関係などでお会いしているが、この時間学会の直前に、ネットで上のような話題が出てきた。 ただし今回の一川先生の発表はこのネタとは違うらしく、この「タキサイキア現象」の研究は2年前にやった事らしい。 関連するWikipediaと2ちゃんの情報をまとめたファイルは これ である。

そしてさらに、筋電ネタで発表したところに食いついてきたのが、開催地の京都工繊大の小山先生である。 京都ではだいぶ昔から、「匠の技」を記録・解析するというテーマがあるらしく、学生さんとセットで筋電センサやMyoのあたりに興味がある、ということで繋がった。 とりあえず過去の関連発表PDFと「Myo日記」などのURLをメイルしたが、おそらくそのボリュームに驚くだろう(^_^;)。 その後、昼休みに学生さんとともにミーティングを行って、以下のような宿題をもらった。 今月中にとりあえずMyoを試してみたい、ということで、一気に忙しくなってきた。

ここで午後のセッションとなり、その合間に上記の宿題のために、しこしこと内職でMaxプログラミング三昧・・・と思っていたら、想定外にそれぞれの発表が面白く、途中からパソコンは閉じてしまった。 やはり、時間学会は、いいのだ。(^_^)

- Myoの注文先を知らせる → 小山先生が生協経由で購入

- Myoの「8ch筋電+9軸センサ」情報を記録するパッチを作り、Macアブリ化して送る

- 使い方をビデオに撮ってYouTubeに上げてURLを知らせる

2016年6月14日(火)

目覚めた朝から午前中あたりまで、不思議な感覚に包まれた日となった。 土日の京都での時間学会には このように 行ってきたのだが、写真にあるように日曜の夕方には大阪に行って阪神百貨店のタイガースショップでステッカーを買い物したり、その後はまたまた「鶴橋」に行ってホルモン焼肉三昧して自費宿泊して、昨日の午後に某ミーティングを行った。 その結果が、今日の「不思議な感覚」なのである。これまでどの「日記シリーズ」にもどこにも書いていないが、準備段階から数えるとすでに約2年半、という巨大プロジェクトを水面下で進めているのだが、当初はあと約1年、と計画していたこのプロジェクト完了目標を「あと約2年」に変更する、という重大な結論を得たミーティングだったのである。 元々の計画がかなり無謀なものだったので、ここ2年というもの、ストレス知らずの僕であっても、半ば無意識下には常にプレッシャーを感じ続けてきた2年間であり、今年は夏の欧露ツアーがあったり、引き続きのT○Y○T○共同研究テーマも重なったり・・・という中で、どうやって進めていくのか、相当に脳の奥底に澱のように堆積してきたプレッシャーが、当面あと1年という時間を確定させたことで見通しがサッと拓けてきて、ずっと爪先立ちだったのが、今日になって地に足が着いたような感覚に変化したのである。

たった1年間、プロジェクトの目標を延ばしたところで、行く先の道のりは膨大であるのは変わらないが、まずはSUAC図書館の蔵書を検索して、上のプリゴジン3冊を借りてきて、研究室にある下條先生の3冊とダマシオの4冊、計10冊を再読することにした。 先週までの「無意識下プレッシャーに押しつぶされた日々」には、頭の片隅にはあっても実行できなかった仕切り直しである。 そして、京都工繊大の小山先生と約束した「Myo実験ツール」に関するMaxプログラミングを昨日の浜松までの帰途の新幹線で進めてきた続きが、来週に予定されている帝塚山大学の村尾先生との「呼吸計測ツール」(下の写真)のためのMaxプログラミングと、かなり重なっていると気付いたのも、この新たな余裕の成せる技のようだ。

京都への出張中には、夏の欧露ツアーの最初のイベント、temporaに関してフランスの主催者から、「お前たちの泊まる場所はここ」と、 こんな マップが届いたが、こりゃフランス語で読めない(^_^;)・・・なんてのも舞い込んできた。 さらに来週には、いよいよ最後のICEC2016の査読結果が届くので、来月のオーストラリアのNIME2016とともに、こちらにもぼちぼち全力投球していく必要がある。 あれこれ忙しい日々としては変わらないのだが、とりあえず、確かな実感として「地に足が着いたような感覚」を楽しんでいるのだ。

2016年6月16日(木)

早いもので、もう木曜日である。 昨日の水曜日は、1限の「音楽情報科学」で、チーム「mogmogcurry」の新しい「顔はめインスタレーション」作品に関して、以下のような試作パッチを作っていたら時間になった。

そして昨日の2限にはゼミがあり、その後の3-4限には、以下のように、京都工繊大の小山先生に向けた「ダブルMyoの計測データを記録するパッチ」の制作を進めているうちに時間になった。

そして昨日の5限には、ゼミ(仮ゼミ)に来ていた井さんと有川さんに依頼されてアポを受けて、「音楽情報科学」のチーム「さば缶」の新しいインスタレーション作品のための画像認識パッチを以下のように試作していたら時間になった。

この中で、最新の環境のMax7では何度もクラッシュしていた「内臓カメラと外付けUSBカメラの切り替え」について、うまく解決するパッチが完成したので、以下のように「TIPS」として登録した。 さらに今朝にCycling'74から届いた情報のTutorialから、以下のようにウインドウをスマートに管理するテンプレートもゲットできたので、これも「TIPS」に置いた。 なんとも「Max7漬け」の日々である。(^_^)

そして今日の朝〜1限には、時間学会の新会長の一川先生からのメイルに返信して、さらにtemporaの主催者に僕の「20分conference」の提案を出していると、時間になった。 充実しているものの、なかなか小山先生に向けたパッチが完成しない。 これが出来ると、来週に1106に来る、村尾先生のための「腹式呼吸・計測記録パッチ」に繋がるので、ここをなんとか進めたいのだが、今日は2限に「音楽理論講座」、3限に「サウンドデザイン」、4限に学生委員会、5限にデザイン2回生の面談アポ。そして放課後にアカペラ、と予定満載なのである。 まぁ、Max浸けの日々というのは幸せなので、ぼちぼち進めていこう。

・・・と早々に1106に来た前澤さんと、寝坊遅刻メイルの井さんと音沙汰無しの須田さんを待っている間に、上のようなページから、 Time Machine で Mac をバックアップまたは復元する方法 とか、 コンテンツを新しい Mac に移動する とかのページをブックマークした。 事務局によれば、T○Y○T○共同研究費で発注した、4台目のMacBookAir(貼るステッカーも阪神百貨店のタイガースショップで獲得済)が今月末に届くらしいので、ぼちぼち準備である。

悩ましい問題は、El Capitanに上げたMacBookAir1号機とMacBookAir2号機が、このOSのためではないとしても不調なため、現在のメイン機であるMacBookAir3号機は買ったままのYosemiteで、まだEl Capitanに上げていない事である。 マルチメディア室のiMacは既に全てEl Capitanであり、新しく届くMacBookAir4号機も同じであるが、せっかく順調に稼働しているMacBookAir3号機を無理にEl Capitanに上げたくないのだが、それだとパックアップ機とリストア機のOSバージョンが異なるのだ。 現在のところの作戦としては以下を考えているが、なかなか悩ましい。

アカペラはぼちぼち新入生メンバーも固まってきて、久しぶりにBass(新人2人)がちゃんと響く、いい感じになってきた。 来週末にはそんな新人とともにカラオケである。(^_^)

- MacBookAir3号機(Yosemite)を、Time MachineでHDD(1)にバックアップする

- 届いたMacBookAir4号機(El Capitan)に、このHDD(1)でTime Machineリストアを試みる

- OKだったら、そのままで行く → これで完了(^_^)

- NGだったら、MacBookAir3号機をApp StoreからEl Capitanに上げる

- 上げたMacBookAir3号機(El Capitan)を、Time Machineで別のHDD(2)にバックアップする

- 届いたMacBookAir4号機(El Capitan)に、この別のHDD(2)でTime Machineリストアする

- 上げたMacBookAir3号機(El Capitan)の様子を見る

- OKだったら、そのままで行く → これで完了(^_^)

- NGだったら、上げたMacBookAir3号機を元のHDD(1)でTime MachineリストアしてOSをYosemiteに下げる

- 戻したMacBookAir3号機(Yosemite)の様子を見る

- OKだったら、そのままで行く → これで完了(^_^)

- NGだったら、MacBookAir3号機(Yosemite)を別のHDD(2)でTime MachineリストアしてOSをEl Capitanに上げる

- 上げたMacBookAir3号機(El Capitan)の様子を見る

- OKだったら、そのままで行く → これで完了(^_^)

- NGだったら、・・・・泣く(;_;)

2016年6月17日(金)

遂にアメリカからはイチローの偉業が届き、ネットには上のようなイチローTシャツ画像が出回ったこの日は、2限に「音楽情報科学」のためのうららアポ、3限にゼミの馬ブン特訓アポ、そして5限には「サウンドデザイン」がある。 そこで1限の冒頭からおよそ1時間、気合いを入れてMaxプログラミングに没頭して、遂に以下のように、無事に「ダブルMyoの全てのセンサ情報と操作動画とを記録するMaxパッチ」が完成した(^_^)。 記録はさっそく YouTube に上げた。 前半と後半でおよそ計2回分のデモが入っており、Myoのための環境設定なども記録してみたが、動画のサイズは353MBと巨大になった。

MyoからBluetoothで届くセンサ情報のサンプリングレートは非常に高いが、ここではjitterクロックを33msecとして、記録movieをフレームレート30fpsで記録しているので、2個のMyoそれぞれから届くセンサ情報のうち、9軸センサ(方向・ジャイロ・加速度それぞれ3次元)はpackに貯めておいて、jitterクロックの33msecリサンプリング(ダウンサンプル)で鋤いたデータになっている。 またそれぞれの8チャンネル筋電センサデータは、20ポイントの移動平均処理で筋電エンベロープとして表示しており、このデータを9軸センサデータと同じパケットで、msec単位のタイムスタンプとともにplain textファイル化して保存している。

上のサブパッチのうち上のものは、ダブルMyoを設定するオリジナルプログラムによって区別された2個のMyo情報をOSCプロトコルで受けてメッセージにデコードしているもの、下は実際にデータをQuickTimeムービーとplain textデータとしてロギングするものであり、後者は村尾先生のプロジェクトにも適用できる事を意識して開発したのである。

そして2限には、「音楽情報科学」でなく和田先生の科目の課題と碧風祭のための作品だ、と判明したネタの相談をを受けたが、さしたる進展が無いまま次回に持ち越しになった。 手法として「WiiリモコンをワイヤレスのWebカメラとして使う」というアイデアに到達したが、だいぶ昔に赤松さんが作った「aka.wiiremote」はMax7でもMax6でも、MacBookAirではMax5でも使えなかった(^_^;)。 そこでIntel MacでなくPowerPCのiBookとMax5でやってみると、もう数年前から使っていなかったWiiリモコンと通信できたが、とにかくペアリングのセッティングで難儀した。

そして「Bluetoothで画像を飛ばすWebカメラ」はまだ無い、というのを確認した上で、上のような「WiFiでUSBドングルに画像を飛ばすWebカメラ」は、サンワサプライとバッファローから出ている・・・と発見したが、いずれもMacOSは非対応だった。 念のためにMax7の「serial」オブジェクトで、Wiiリモコンから飛んでくるかもしれないBluetoothパケットを探してみたが、これも不発だった。 要するにとりあえずは万事休す、ということで、これは来週以降に持ち越しである。

昼休みには、最終となる新入生グループと明日のカラオケマラソンの集合の打ち合わせランチmeetingを行い、続く3限では、ブンちゃんに提供したbackup HDDが不調だというのでチェックして「謎の迷宮」に舞い込み(^_^;)、Disk Utilityと無駄に格闘した。 前期の大学院入試を受けるための準備(ポートフォリオと研究計画書)があるのでゼミの制作は棚上げして、過去の作品データの整理などに没頭した。 バックアップというのはディジタルに必須の「本質的摩耗作業」である、とまた実感したところでオシマイとなった。

2016年6月19日(日)

昨日は新入生歓迎カラオケマラソンシリーズのほぼ最終回、4人とともに9時間で僕は28曲を楽しんで、今日はぼちぼち休養日として研究室に出て来ると、ネットには上のようなほのぼの写真が流れていた。

ところが、昨日は研究室に出てこなかったので2日分のネットニュースを斜め読みしていると、上のようなショッキングなニュースに行き当たった。 神戸山手女子短大と言えば、独立してフリーになった1993年あたりから2000年あたりまで、非常勤として毎週3日、京都芸術短大(映像学科)、千里中央のイメージ情報科学研究所とともに、浜松から通っていた大学である。 神戸で最古の短大と由緒正しく、音楽科の学生は僕の作品のパフォーマンスなどで活躍した、僕のComputer Music歴史にとって外すことの出来ない拠点だった。 ただし関西で先行した短大消滅の雲行きに対応して共学の4年制大学に移行していたので、このニュースは時代的必然でもあるのだ。

その後、小山先生のためのMaxパッチを改良して、明日の村尾先生を迎えるMaxパッチを上のようにほぼ完成させた。 動画のレコーディングとともに音声もサウンドファイルにレコーディングして、さらに3チャンネルの呼吸センサ(伸縮ベルト)のデータを記録する。 いろいろ調べて「Unixコマンド実行」というのも実装して、新しい記録の際に、前回の3本の記録データファイル(movとaiffとtxt)をリネームコピーする機能と、新しい記録開始に備えて存在している3本の記録データを削除する機能を追加してみた。

2016年6月20日(月)

朝イチで届いた情報は、IAMASの小林さんがSketchingコミュニティに紹介した、 Hack the World という刺激的なタイトルのサマーキャンプの情報である。 IAMASと国際交流基金Asia Centerが企画したもので、かつてIAMASの企画するイベントに参加してきた身としてはソソラレルが、やはりここは「若手」向けなのかも・・・と不安になり、こっそり小林さんに日本語で問い合わせの私信メイルを出してみた。 オブザーバーであっても参加できるようなら、ちょっと前向きに考えてみたい。

そして午後には、帝塚山大学の村尾先生と宮田先生が研究室に来てくれて、上のように、新しいシステムでの「村尾・腹式呼吸・新理論」のための計測実験を進めた。 まだまだ問題点なども露見したが、大いなる進展でもあった。 やはりMaxは便利なツールなのだ。(^_^)

2016年6月21日(火)

T○Y○T○との共同研究の予算で発注した4台目のMacBookAirが届いて、初めてのことだが、 このように TimeMachineバックアッップを使って、MacBookAir3から全てのコンテンツを移動させてみた。 YouTubeムービーにあるように、転送終了時に何度も何度も自動でリブートを繰り返したのは心臓に悪かったが(^_^;)、外付けHDDを抜いたら正常に起動して、移動はなんとか完了した。

YouTube

YouTubeあれこれアプリを試してみて、エラーが出たUnityはアッサリと消して、Max7とQuickTimePlayer7のユーザ登録を移行させて、たいていのものはそのままスムーズに移行できた模様である。 あとはUpdateしているXcode、そしてleap motionとかMUSEとかMyoまわりの確認ぐらいで、ほぼ同等の環境を短時間で再現できた。 これで欧露ツアーはこの2台を抱えて行くことになりそうなので、せっかくだから「2台使い」の作曲に挑戦しよう。 MacBookAir3はYosemiteのままで、こちらMacBookAir4はEl CapitanというデュアルOS体制で行きそうだ。

2016年6月24日(金)

またまた、もう週末である。 水曜日は「音楽情報科学」と「ゼミ」、木曜日は「 音楽理論特訓講座 」と「サウンドデザイン」と教授会とアカペラ、そして金曜日の今日は「馬ブン特訓」と「サウンドデザイン」、と充実の週の後半の予定だっだが、大学院受験のためのポートフォリオ制作で徹夜したブンちゃんから「今日はバス」のメイルが届いたので、5限の講義までぽっかりと時間が出来た。 ただし、今週の月曜の村尾先生の来訪まで集中的にMaxプログラミングを進めた反動で、今週の空いた時間には下條先生の本とプリゴジンの「散逸構造」の本の精読に没頭していて、今日もMaxプログラミングは棚上げである。

そして、午前から午後まで、上のようにBBCニュースのライヴ画面を開いて、2週間後にNIME2016に行く「耳リハーサル」を兼ねてずっと英語の音声を流しつつ、プリゴジン「散逸構造」の精読を進めた。 するとなんのことはない、複雑な非線形偏微分方程式での議論は、何年か前から入り浸ってきた、電子情報通信学会・非線形問題研究会で接してきた、非線形現象とカオスのお話なのだった(^_^;)。 またここで、回り道してきた自分の足取りが収斂してきた・・・という予感でワクワクしながら気付いてみると、イギリスの国民投票は「EU離脱」が僅差で勝ったようで、一気にドルもユーロも「額面低下」、つまり円高になった。 これは夏まで続くとすると。だいぶ欧露ツアーで「お得」になる予感がある。 つまり、これまで1ユーロの買い物をするのに140円ぐらい必要だったのに、105円ぐらいで済むということなのだ。

2016年6月28日(火)

新入生歓迎シリーズの最終回で10週連続カラオケを堪能した土曜日、その休養日として文献精読に暮れた日曜日、そして昨日の月曜日には後述の講義資料制作に1日がかりとなる合間にプリゴジン「散逸構造」を読み進めるとともに、自宅では下條先生の著書3冊のうち2冊目までクリアした。 約2年ぶりの下條先生の著書は、その間の勉強によってか、まったく違って染み渡ってくるのが快感だった(^_^)。

そして自宅に届いたのは、ゼミの教え子のOG・山村知世さんからの、今年も焼津で開催するという個展の案内だった。 たしか去年も このように 駆けつけて、いつものように焼津の美味しさを堪能したのだった。 今年は開催後半には僕はオーストラリアに行っているので、なんとか前半に駆けつけられないか、さっそく打診メイルを出したが、去年のように行くことは難しい、と今年はパスする事になった。 残念(^_^;)。

そしてまったく予定の入っていない月曜日にほぼ一日かけて行ったのは、上のデータの整理だった。 「サウンドデザイン」の講義で学生に紹介している、過去の先輩が課題で作ったMaxパッチの作品集は、マルチメディア室のMacがMax5になった時期から、それ以前と途絶していた。 たいていは互換性を持って成長してきたMaxだが、LCDオブジェクトの作法だけはMax4までと、Max5以降とで大きく変わったために、過去のパッチは開けるものの、「graphic」という消滅したオブジェクトの部分で、「何も表示されない」という分断があったのだ。

そこで遂に一念発起、過去のPowerBookG4を持ち出して、さらにバックアップHDDから発掘して、2002年からの全ての学生課題パッチを見て、厳選に厳選を重ねて上のように整理したのである。 講義の中で学生に見せるためには、Max4が走る過去のPowerBookG4を持参する必要があるが、しかし、この手間をかけた甲斐があるほど、その作品は素晴らしかった。(^_^)

2016年7月1日(金)

水曜には1限に「音楽情報科学」、2-3限にゼミ、そして晩には「居酒屋むっちゃん」のメンバーとの飲み会→カラオケ、という充実の懇親会があった。 木曜はそのダメージを残しつつ(^_^;)、2限に「音楽理論講座」、3限に「サウンドデザイン」、4限に「さば缶アポ」、放課後にアカペラがあって、こちらも充実の日となった。 そして今日は金曜日、3-4限にM2杉浦アポ、5限に「サウンドデザイン」があるだけで午前中にぽっかり時間が出来たチャンスに、前日に納品された新しい2個のホワイトMyoを含めて、10日後のNIME2016(ブリスベン)と、夏の欧露ツアーを睨んで、新しく届いたMacBookAir4号機の動作確認をする事にした。

そして1時間もかからずに、 このように 無事に新しい環境で、新たに2個のMyoを加えて、ファームウェアを最新にして動作確認を完了した。 次のステップとしては、MacBookAir3号機で稼働しているXcodeを使って(4号機にもバックアップコピーしたがまだ動作は未確認)、「同時に4個のMyoを使う」という環境を開発したいところである。 一人で4個のMyoを装着するのはちょっとキツくて苦しいかもしれないが、「2個のMyoを装着した2人がコミュニケートする」というシステムとしては必須になるので、これは挑戦し甲斐があるのだ。

散逸構造 : 自己秩序形成の物理学的基礎. G. ニコリス, I. プリゴジーヌ [著]/小畠陽之助, 相沢洋二訳. 岩波書店, 1980. 1階閲覧書架 007.1/N 71 近代文明を超える新しい思考の原型 (モデル) を求めて. 統合学術国際研究所編/イリヤ・プリゴジン [ほか著]. 晃洋書房, 2003 (統合学研究叢書:第1巻, 文明の未来、その扉を開く). 1階閲覧書架 041/To 23 混沌からの秩序. I. プリゴジン, I. スタンジェール [著]/伏見康治, 伏見譲, 松枝秀明訳. みすず書房, 1987. 1階閲覧書架 420/P 93その後、SUAC図書館で「プリゴジン」で検索したら出てきた上の3冊の精読に取りかかり、遂に1冊目の「散逸構造 : 自己秩序形成の物理学的基礎」を読了した。 個々の非線形偏微分方程式などは全て軽くパスしたものの、最後の2-3章は実に圧巻だった。 3冊目はかつて読んだ本なので、次に取りかかったのは、プリゴジンは実は「巻頭言」を寄稿しただけ、という2冊目の「近代文明を超える新しい思考の原型 (モデル) を求めて」だったが、これは1時間ほどで斜め読み完了、ちょっとトンデモ系の本だった。(^_^;) 出版者の「統合学術国際研究所」というのを調べてみると、以下のように何故か仏教色に染まっていて、要するに混沌とした21世紀はもう西洋宗教では救えないから仏教の時代なのだ・・・という文脈で、あれこれの論者を集めていた。 これはもしかすると、時間学会よりも凄いかもしれないが、深入りは避けることにしよう。

そしてその後は、プリゴジンの「混沌からの秩序」の再読(3回目)に取り組む前に、あと少し残っていた、下條先生の著書「サブリミナル・インパクト」の後半を精読して、これまた読了した。 まったく違う世界のようで、この両者がけっこう似た事を言っている・・・と理解できるのも、ここ2年ほど頑張って勉強してきた成果かもしれない。

午後には院生の杉浦さんのMacBookに新しいMyoを接続する環境設定を完了して、赤松さんたちの力作「2061オデッセイ」を貸し出した。 そしてプリゴジンの「混沌からの秩序」の最初を読んでみると、なんとこの本の「まえがき 科学と変化」を寄稿していたのは、アルビン・トフラー氏であった。 トフラー氏の訃報が届いたのは、まさに昨日である。 なんという巡り合わせ・・・と思いつつ、この本を再び精読していくことにしよう。

2016年7月2日(土)

珍しく、というか新学期になってから初めて、何もない土日である。真夏日で天気がいいが、研究室に引き蘢りである。 プリゴジンの「混沌からの秩序」の精読(再読)とともに、新しいMacBookAir4に入れて最新に上げたXcodeの試運転と、新しくホワイトの2個が加わって計4個になったMyoを同時に使うために、これまでの「DoubleMyo」から新しく「QuadMyo」というディレクトリを作って、DoubleMyo→OSCというオリジナルプログラムを以下のように改訂した「MyoMax_05.cpp」を作った。 以下は、 ここ にまとめたそのソースのうち、使っていない「方向」「ジャイロ」「加速度」の部分を省略したソースである。 UDPポート番号は、これらのセンサのために予約したままにしてある。

#define MAC "00:00:00:00:00:00" #define _USE_MATH_DEFINES #include <cmath> #include <array> #include <iostream> #include <iomanip> #include <sstream> #include <stdexcept> #include <string> #include <myo/myo.hpp> #include <vector> #include "osc/OscOutboundPacketStream.h" #include "ip/UdpSocket.h" #define OUTPUT_BUFFER_SIZE 1024 UdpTransmitSocket* transmitSocket1; UdpTransmitSocket* transmitSocket2; UdpTransmitSocket* transmitSocket3; UdpTransmitSocket* transmitSocket4; UdpTransmitSocket* transmitSocket5; UdpTransmitSocket* transmitSocket6; UdpTransmitSocket* transmitSocket7; UdpTransmitSocket* transmitSocket8; class DataCollector : public myo::DeviceListener{ public: DataCollector(): roll_w(0), pitch_w(0), yaw_w(0), emg() {} int roll_w, pitch_w, yaw_w; float w, x, y, z, roll, pitch, yaw, a_x, a_y, a_z, g_x, g_y, g_z; char buffer[OUTPUT_BUFFER_SIZE]; std::array<int8_t, 8> emg; void onPair(myo::Myo* myo, uint64_t timestamp, myo::FirmwareVersion firmwareVersion){ knownMyos.push_back(myo); myo->setStreamEmg(myo::Myo::streamEmgEnabled); myo->vibrate(myo::Myo::vibrationShort); myo->lock(); emg.fill(0); } void onConnect(myo::Myo* myo, uint64_t timestamp, myo::FirmwareVersion firmwareVersion){ std::cout << "Myo " << identifyMyo(myo) << " has connected." << std::endl; } void onDisconnect(myo::Myo* myo, uint64_t timestamp){ std::cout << "Myo " << identifyMyo(myo) << " has disconnected." << std::endl; } size_t identifyMyo(myo::Myo* myo){ for (size_t i = 0; i < knownMyos.size(); ++i){ if (knownMyos[i] == myo){ return i + 1; } } return 0; } std::vector<myo::Myo*> knownMyos; void onEmgData(myo::Myo* myo, uint64_t timestamp, const int8_t* emgData){ for (int i = 0; i < 8; i++){ emg[i] = emgData[i]; } osc::OutboundPacketStream p(buffer, OUTPUT_BUFFER_SIZE); p << osc::BeginMessage("EMG") << MAC << emg[0] << emg[1] << emg[2] << emg[3] << emg[4] << emg[5] << emg[6] << emg[7] << osc::EndMessage; if (identifyMyo(myo) == 1){ transmitSocket2->Send(p.Data(), p.Size()); } else if (identifyMyo(myo) == 2){ transmitSocket4->Send(p.Data(), p.Size()); } else if (identifyMyo(myo) == 3){ transmitSocket6->Send(p.Data(), p.Size()); } else if (identifyMyo(myo) == 4){ transmitSocket8->Send(p.Data(), p.Size()); } } void onAccelerometerData(myo::Myo* myo, uint64_t timestamp, const myo::Vector3<float>& accel){ } void onGyroscopeData(myo::Myo* myo, uint64_t timestamp, const myo::Vector3<float>& gyro){ } void onOrientationData(myo::Myo* myo, uint64_t timestamp, const myo::Quaternion<float>& quat){ } }; int main(int argc, char** argv){ try{ std::cout << "OSC to 127.0.0.1:7777\n"; transmitSocket1 = new UdpTransmitSocket(IpEndpointName("127.0.0.1", 7777)); std::cout << "OSC to 127.0.0.1:7778\n"; transmitSocket2 = new UdpTransmitSocket(IpEndpointName("127.0.0.1", 7778)); std::cout << "OSC to 127.0.0.1:7779\n"; transmitSocket3 = new UdpTransmitSocket(IpEndpointName("127.0.0.1", 7779)); std::cout << "OSC to 127.0.0.1:7780\n"; transmitSocket4 = new UdpTransmitSocket(IpEndpointName("127.0.0.1", 7780)); std::cout << "OSC to 127.0.0.1:7781\n"; transmitSocket5 = new UdpTransmitSocket(IpEndpointName("127.0.0.1", 7781)); std::cout << "OSC to 127.0.0.1:7782\n"; transmitSocket6 = new UdpTransmitSocket(IpEndpointName("127.0.0.1", 7782)); std::cout << "OSC to 127.0.0.1:7783\n"; transmitSocket7 = new UdpTransmitSocket(IpEndpointName("127.0.0.1", 7783)); std::cout << "OSC to 127.0.0.1:7784\n"; transmitSocket8 = new UdpTransmitSocket(IpEndpointName("127.0.0.1", 7784)); myo::Hub hub("com.samy.myo-osc"); DataCollector collector; hub.addListener(&collector); while (1){ hub.run(1000/20); } } catch (const std::exception& e){ std::cerr << "Error: " << e.what() << std::endl; std::cerr << "Press enter to continue."; std::cin.ignore(); return 1; } }そしてこのオリジナルツールは簡単に作れたものの、驚くべき事実に遭遇した。 なんと最新のArmband Managerでも、「同時に最大3個のMyoとしか接続できない」という事だった。 個々のMyoには名前を振ってあり、Myo Armband Managerでそれぞれと任意にconnect/disconnectできる。 ところがいざ、上のツールで4個のMyoからの情報を同時に受けようと、次々にconnectしていくと、3個目のMyoまではどのような順序であっても問題なくconnectできるのに、4個目のMyoはどれであっても繋がらないのだった。 これはMyoのBluetoothドングルの仕様(ないし限界)、ということのようである。

結局、上のようにこのツールを「TripleMyo」に改訂することはやめて(将来的には3個の制限が4個に拡張される可能性を期待して)、「QuadMyo」という名前のままで、とりあえず「Myoの同時3個使い」までを実現したところで、今日はオシマイとなった。 なんかMyo3個というのは中途半端なのだが、もともとダブルMyo、それも「スリープ禁止」で使っているのも、ほぼ世界で僕ぐらいなので、仕方ないのかもしれない。

2016年7月5日(火)

日曜はダラダラと研究室のデータのBackUpを整理しつつ過ごしてしまったが、いよいよNIME2016に向かう週となって、一気にあれこれが煮詰まってきた。 昨日の月曜日には、ゼミの馬ブンさんが3限〜5限ブチ抜きのアポを入れてきて、前週から何度かメイルでやりとりした「研究計画書」などとともに、以下のような力作のポートフォリオを全20ページ、新しいプリンタで印刷して完成させて、そのまま郵便局に行って、SUAC大学院への願書の提出まで完了した。

そして放課後には「UD-Music」のミーティングがあったが、なんとも遅々としていまだに「見えて」こないまま、終了した。 発表の8/27には僕は欧露ツアーに出発するので参加しない、と確定していて、それまでの制作支援に重点を置きたい、と身構えているのだが、いつまでたってもブレストでは、「形のある」「実際に動く」ものは難しいようであるが仕方ない。

プリゴジンの「混沌からの秩序」の精読(再読)も佳境を迎えてきて、これまでに勉強してきたあれこれがジグゾーパズルのように嵌っていく壮快さを堪能して、遂に日曜には図書館の貸し出しでなくペンを入れるためにAmazonに中古本を発注した。 そして昨日はさらにテンションが上がってきて、無理と知りながらも英語版の原書を入手したくなって、アメリカのAmazon.comに中古本を発注してしまった。 以下のように、ちょうどNIME2016から帰ってきた頃に届く模様である。

そして今日は、院生の杉浦さんが「Max猛勉強」のために1限〜3限ブチ抜きのアポを入れてきて、ネットのMax情報、赤松さんたちのMax本、そしてSUAC学生のMax課題作品などを参考に頑張っている。 ぼちぼち長期予報が出ているので、NIME2016のブリスベンの天気予報を検索してみると以下のように好天が続くようだが、注意して気温を見てみると「最低気温4℃」という日もある。 真冬である。(^_^;)

土日を跨いだとしても、Myo Developerサイトに「Myoは3個までは接続出来るけど4個は無理なの?」という質問には回答が無い。 どうやら、MyoがDeveloperの注目を集めて盛り上がっていた時期は既に過去のものとなっているようだ。 それで、頻繁に「キャンペーン特価」などのメイルが届くのだろう。

2016年7月8日(金)

「音楽情報科学」とゼミのあった水曜日、委員会と「サウンドデザイン」とアカペラのあった木曜日を経て、もう週末の金曜日である。 総合演習IIと修了制作中間発表のプレゼンが遠くに見えてきて、ゼミの馬ブン・前澤・杉浦と2-3限にアポが入っていて、5限には「サウンドデザイン」がある。 これで土曜日に家族サービスのホームセンター買い出しなどすれば、もう日曜日には羽田空港からオーストラリアに向けて飛び立つことになる。

ネットには毎度お馴染みの、上のような情報が届いたが、それよりも大変そうなのは、ここ最近のスパムである。 これまでと違って、きちんとした日本語で、「クロネコヤマト」「宿泊サイト」「三井住友銀行」などからの状況確認メイルのように偽装して、添付のマルウェアを開かせる、というものである。 本文中の企業ページへのリンクURLは本物で、さらに「簡単に添付を開かないように」と警告した上でのスパムであり、ここ最近の完成度は画期的なものがある。 これまでの中国から届くヘンな日本語スパムと違って、おそらくきちんと日本人スタッフをリクルートした模様である。 おそらく7月〜8月あたりに、日本国内あちこちでこのスパム/マルウェアの被害が爆発的に話題となる、と予言しておこう。

論文応募期限を延長したあおりを受けて、ICEC2016の結果通知もextendedされていたが、それが7/6だというので待ち構えていたら届かず、改めてICECのサイトを見るととシレッとさらに延長されていた(^_^;)。 こんなこともあろうかと、Ryan先生の英語チェックを受けた改訂版は既に作ってあるが、どうやらNIME2016に行っているブリスベンで結果通知を受けて、締め切りまでに帰国できないので、オーストラリアからcamera readyを送る必要がありそうである。 いつもの「お仕事パソコン」でない出張先の環境でちゃんと出来るか不安があるが、まぁ仕方ない。

そして2限から3限は、上のようにゼミの3人が「追い込み制作」でなく「追い込まれ制作」に精を出した。 既に就職先が決まっている石井さんは、水曜2限のゼミの後で液タブを使ってサクサクとアニメーションの描画を進めていたが、就活が難航している杉浦さんと前澤さんは、作品制作にも追われて苦しい展開となっている。 今月末の大学院入試を受ける馬ブンさんも、入試の準備(研究計画書とポートフォリオの作成)に没頭していたので、総合演習IIの作品制作はこれから追い込みなのだ。

2016年7月10日(日)

夜の羽田空港・国際線ラウンジである。 このページを改訂しようとHTMLを開くと、いきなり毎回JeditXがクラッシュして困ったが、最新の2.50にアップデートすると無事に正常に戻った。 やはりEl CapitanはYosemiteとは違うようだ。

前回、初めての南半球としてシドニーに行った NIME2010 の時には、シンガポールを経由してだったが、羽田空港の国際線としてANAが直行便を飛ばすようになったので、時差もなく快適にオーストラリアに行けるようになった。 ただし今回はシドニーから乗り継いで、ブリズベンまで飛ぶ。 いつものように写真を撮りまくるつもりではあるが、内職で何か新しいプログラミングを進める、という具体的なモチベーションが無いので、この日記はけっこう淡白なものになりそうである。(^_^;)

2016年7月11日(月)

完全に体調万全、ということでもなく今回の出張に出かけたので、色々と慎重にスタートした。 上の日記から続ければ、羽田からの出発(夜22:30)が定刻より10分遅れのANAはそのまま10分遅れ(朝08:40)でシドニー空港に到着した。 なんとシドニーの入国手続きは完全に自動化されていて、チェックイン機にパスポートを通すとチケットが出てきて、そのチケットをゲートの機械に入れると正面のカメラで本人の顔を画像認識して通してくれた。

しかし、そこから国内線はグダグダだった(^_^;)。 いったん通関で受け取ったbaggageを再び預ける国内線乗り継ぎカウンターがもたもたして30分以上も待たされたが、そこからバスでシドニー国内線空港に移動してみると、10:30のフライトが11:30に変更されていて、さらに搭乗間際になってゲート変更のアナウンスに、待っていた人々とともに慌てて移動した。

いつものパターンであれば、土地勘が無いので、到着したブリスベン空港からホテルにはタクシーで移動するのだが、今回はAirport TrainのCentral駅からGoogle Mapで見ると徒歩圏内にホテルがあり、まだ昼間ということでスーツケースを押しながら坂道を上って無事にSOHO Brisbaneというホテルに到着した。 1日目はWelcome ReceptionとKeynoteとConcert1の予定だったが、ホテルからNIME会場まではおよそ30分ほどあり、レジストレーションデスクで名札など一式を受け取って、Welcomeチケットでワインを2杯いただくとドッと疲れが出て、そのまま暗くなってきた川べりの風景を堪能しつつ、坂道を上ってホテルに帰り、睡眠不足のためバタンキューして、時差が1時間しか無い筈なのに、夜中の24時に目覚めたところである。

そして、ずっと気がかりなのだが、延びに延びている、ICEC2016のNotificationメイルが、まだ、届かないのだった。 日本と欧州との時差から、あと8時間ほどで届けば期限内であり、これは「寝て待つ」しかない。 そして、ごく直前に届いたのが、以下の「Poster and Demo Schedule」である。 Paperの応募をDemoに変更依頼されたが、なんだか1部屋をもらったようなので、明日はこの発表を乗り切れば、あとは聴講聴衆モードで気楽になる。

Poster Session 1 (Tuesday July 12, 1:30pm) Posters Towards a Perceptual Framework for Interface Design in Digital Environments for Timbre Manipulation (Sean Soraghan, Alain Renaud, Ben Supper) Table 3 Augmenting the iPad: The BladeAxe (Romain Michon, Julius Orion III Smith, Matthew Wright, Chris Chafe) Table 4 Towards a Mappable Database of Emergent Gestural Meaning (Doug Van Nort, Ian Jarvis, Michael Palumbo) Table 5 An Analogue Interface for Musical Robots (Jason Long, Ajay Kapur, Dale Carnegie) Table 6 The ‘Virtualmonium’: an instrument for classical sound diffusion over a virtual loudspeaker orchestra.(Natasha Barrett, Alexander Refsum Jensenius) Table 7 The Smartphone Ensemble. Exploring mobile computer mediation in collaborative musical performance(Julian Jaramillo Arango, Daniel Melán Giraldo) Table 8 Development of Fibre Polymer Sensor Reeds for Saxophone and Clarinet (Alex Hofmann, Vasileios Chatziioannou, Alexander Mayer, Harry Hartmann) Table 9 PdMIs: Embedded Acoustic DMIs Expressed through 3D Printing (Oliver Hancock, Todd Cochcrane) Table 10 Transforming 8-Bit Video Games into Musical Interfaces via Reverse Engineering and Augmentation(Benjamin Olson) Table 11 Musician and Mega-Machine: Compositions Driven by Real-Time Particle Collision Data from the ATLAS Detector (Juliana Cherston, Ewan Hill, Steven Goldfarb, Joseph Paradiso) Table 12 Mapping Everyday Objects to Digital Materiality in The Wheel Quintet: Polytempic Music and Participatory Art (Anders Lind, Daniel Nylén) Table 13 Haptic Music Player – Synthetic audio-tactile stimuli generation based on the notes "pitch and instruments" envelope mapping (Alfonso Balandra, Hironori Mitake, Shoichi Hasegawa) Table 14 Notation for 3D Motion Tracking Controllers: A Gametrak Case Study (Madeline Huberth, Chryssie Nanou) Table 15 Embodiment on a 3D tabletop musical instrument (Edgar Hemery, Sotiris Manitsaris, Fabien Moutarde) Table 16 Networked Virtual Environments as Collaborative Music Spaces (Cem Çakmak, Anıl Çamcı, Angus Forbes) Table 19 Drum-Dance-Music-Machine: Construction of a Technical Toolset for Low-Threshold Access to Collaborative Musical Performance (Christine Steinmeier, Dominic Becking, Philipp Kroos) Table 20 The Laptop Accordian (Aidan Meacham, Sanjay Kannan, Ge Wang) Table 21 Music Maker: 3d Printing and Acoustics Curriculum (Sasha Leitman, John Granzow) Table 22 The Hexenkessel: A Hybrid Musical Instrument for Multimedia Performances (Jacob Sello) Table 23 Snare Drum Performance Motion Analysis (Robert Van Rooyen, Andrew Schloss, George Tzanetakis) Table 24 Active Acoustic Instruments for Electronic Chamber Music (Otso Lähdeoja) Table 29 SensorChimes: Musical Mapping for Sensor Networks (Evan Lynch, Joseph Paradiso) Table 30 NAKANISYNTH: An Intuitive Freehand Drawing Waveform Synthesiser Application for iOS Devices (Paul Haimes, Kyosuke Nakanishi, Tetsuaki Baba, Kumiko Kushiyama) Table 31 StrumBot – An Overview of a Strumming Guitar Robot (Richard Vindriis, Dale Carnegie) Table 32 Unfoldings: Multiple Explorations of Sound and Space (Tim Shaw, Simon Bowen, John Bowers) Table 33 BlockyTalky: A Physical and Distributed Computer Music Toolkit for Kids (Benjamin Shapiro, Rebecca Fiebrink, Matthew Ahrens, Annie Kelly) Table 34 XronoMorph: Algorithmic Generation of Perfectly Balanced and Well-Formed Rhythms (Andrew J. Milne, Steffen A. Herff, David Bulger, William A. Sethares, Roger T. Dean) Table 35 Focal : An Eye-Tracking Musical Expression Controller (Stewart Greenhill, Cathie Travers) Table 36 Demos The Haptic Capstans: Rotational Force Feedback for Music using a FireFader Derivative Device (Eric Sheffield, Edgar Berdahl, Andrew Pfalz) Table 1–2 Electromagnetically Actuated Acoustic Amplitude Modulation Synthesis (Herbert H.C. Chang, Spencel Topel) Table 17–18 Dooremi: a Doorway to Music (Rebecca Kleinberger, Akito Van Troyer) Table 25–26 A Multi-Point 2D Interface: Audio-Rate Signals for Controlling Complex Multi-Parametric Sound Synthesis(Stuart James) Table 27–28 Multi Rubbing Tactile Instrument (Yoichi Nagashima) Room 1.21 The Extended Clarinet (Carl Jörgen Normark, Robert Ek, Peter Parnes, Harald Andersson) Room 1.39 SpectraScore VR: Networkable virtual reality software tools for real-time composition and performance(Benedict Carey) Room 3.66 Poster Session 2 (Wednesday July 13, 1:30pm) Posters MalletOTon and the Modulets: Modular and Extensible Musical Robots (Ajay Kapur, Jim Murphy, Michael Darling, Eric Heep, Bruce Lott, Ness Morris) Table 3 speaker.motion: A Mechatronic Loudspeaker System for Live Spatialisation (Bridget Johnson, Michael Norris, Ajay Kapur) Table 4 Transdisciplinary Methodology: from Theory to the Stage, Creation for the SICMAP (Barah Héon-Morissette) Table 5 Kinéphone: Exploring the Musical Potential of an Actuated Pin-Based Shape Display (Xiao Xiao, Donald Derek Haddad, Thomas Sanchez, Akito van Troyer, Rébecca Kleinberger, Penny Webb, Joe Paradiso, Tod Machover, Hiroshi Ishii) Table 6 Church Belles: An Interactive System and Composition Using Real-World Metaphors (Si Waite) Table 7 residUUm: user mapping and performance strategies for multilayered live audiovisual generation (Ireti Olowe, Giulio Moro, Mathieu Barthet) Table 8 Pendula: An Interactive Swing Installation and Performance Environment (Kiran Bhumber, Nancy Lee, Brian Topp) Table 9 Hitmachine: Collective Musical Expressivity for Novices (Kasper Buhl Jakobsen, Marianne Graves Petersen, Majken Kirkegaard Rasmussen, Jens Emil Groenbaek, Jakob Winge, Jeppe Stougaard) Table 10 Rhizomatic Approaches to Screen-Based Notation (Lindsay Vickery) Table 11 3D Modelling and Printing of Microtonal Flutes (Matthew Dabin, Kraig Grady, Terumi Narushima, Stephen Beirne, Christian Ritz) Table 12 Csound Instruments On Stage (Alex Hofmann, Bernt Waerstad, Kristoffer Koch) Table 13 Controlling Complex Virtual Instruments – A Setup with note~ for Max and Prepared Piano Sound Synthesis(Thomas Resch, Stefan Bilbao) Table 14 Emovere: Designing Sound Interactions for Biosignals and Dancers (Javier Jaimovich) Table 15 Designing a Flexible Workflow for Complex Real-Time Interactive Performances (Esteban Gómez, Javier Jaimovich) Table 16 Driftwood: Redefining Sound Sculpture Controllers (Alexandra Rieger, Spencer Topel) Table 19 Leimu: Gloveless Music Interaction Using a Wrist Mounted Leap Motion (Dom Brown, Nathan Renney, Adam Stark, Chris Nash, Tom Mitchell) Table 20 Music Aid – Towards a Collaborative Experience for Deaf and Hearing People in Creating Music (Ene Alicia Søderberg, Rasmus Emil Odgaard, Sarah Bitsch, Oliver Høeg-Jensen, Nikolaj Schildt Christensen, Søren Dahl Poulsen, Steven Gelineck) Table 21 The Prospects of Musical Instruments For People with Physical Disabilities (Jeppe Larsen, Dan Overholt, Thomas B. Moeslund) Table 22 SoundMorpheus: A Myoelectric-Sensor Based Interface for Sound Spatialization and Shaping (Christopher Benson, Bill Manaris, Seth Stoudenmier, Timothy Ward) Table 23 PORTAL: An Audiovisual Laser Performance System (Gorkem Ozdemir, Anil Camci, Angus Forbes) Table 24 Materiality for Musical Expressions: an Approach to Interdisciplinary Syllabus Development for NIME (Rikard Lindell, Koray Tahiroglu, Morten Riis, Jennie Schaeffer) Table 29 Frontiers: Expanding Musical Imagination With Audience Participation (Marcelo Gimenes, Pierre-Emmanuel Largeron, Eduardo Miranda) Table 30 PourOver: A Sensor-Driven Generative Music Platform (Kevin Schlei, Chris Burns, Aidan Menuge) Table 31 Hacking NIMEs (Abram Hindle) Table 32 Drumming with style: From user needs to a working prototype (Sergi Jordá, Daniel Gómez-Marín, Ángel Faraldo, Perfecto Herrera) Table 33 Understanding Cloud Service in the Audience Participation Music Performance of Crowd in C[loud] (Sang Won Lee, Antonio Deusany de Carvalho Junior, Georg Essl) Table 34 An Interactive Software Instrument for Real-time Rhythmic Concatenative Synthesis (Cárthach Ó Nuanáin, Sergi Jordà, Perfecto Herrera) Table 35 Demos Wireless Vibrotactile Tokens for Audio-Haptic Interaction with Touchscreen Interfaces (Edgar Berdahl, Danny Holmes, Eric Sheffield) Table 1–2 Very Slack Strings: A Physical Model and Its Use in the Composition “Quartet for Strings” (Edgar Berdahl, Andrew Pfalz, Stephen David Beck) Table 17–18 A Musical Game of Bowls Using the DIADs (Sam Ferguson, Oliver Bown) Table 25–26 x2Gesture: how machines could learn expressive gesture variations of expert musicians (Christina Volioti, Sotiris Manitsaris, Eleni Katsouli, Athanasios Manitsaris) Table 27–28 Headline grabs for music: The development of the iPad score generator for “Loaded (NSFW)” (Cat Hope, Stuart James, Aaron Wyatt) Room 1.21 How to Stop Sound: Creating a light instrument and ‘Interruption’ a piece for the Mimerlaven, Norberg Festival 2015. (Ben Eyes, Laurits Esben Jongejan) Room 1.39 Tango: Software for Computer-Human Improvisation (Henning Berg) Room 3.66今日ここまでに撮った写真は240枚であるが、これは帰国後にでもまとめてアップする予定である。 ここで日本時間で7/11の23:55、オーストラリア時間で7/12の25時になったので、ここで朝まで寝ることに挑戦することにした。

2016年7月12日(火)

寝不足から擬似時差ぼけ状態にあったが、その後ちゃんと眠れて、身体の奥底にある体内時計でちゃんと朝5時には目覚めた。 ホテルのFree Wifiは快適だが、サーバにデータをアップロードする事は出来ない(Webアクセスのみ)、と判明したので、データをFTPで上げる時だけ、レンタル持参したモバイルWiFiルータに切り替えてアップする、という体制が整った。 最終的には帰国後に完成するが、とりあえず撮った写真を、以下のように ここ に上げていくことにした。

そしてニュースなどをザップしていると、ロシアのDenisから、以下のような情報が届いた。 既にその内容は伝えられていたが、欧露ツアーで行くYekaterinburgの文化庁みたいなところからの、正式な招待状である。 ロシア語で読めない(ただしこれは入国審査とかの場で提示できる強力な資料となる)ので、Denisが 英訳したもの も一緒に送ってくれた。 さっそく感謝のリプライを送ったが、オーストラリアにいながらこうして欧露ツアーの準備も進むというのは、いい時代である。

そして数分後には、Denisから続報のメイルが届いた。 ここで朝7時ということは、たぶんYekaterinburgは深夜2時あたりなのだが、起きているのだろうか(^_^;)。 それによると、昨日は「international music festival "Crazy days"」というイベントで、"I am conductor"という こんなインタラクティブ作品 を発表したのだという。 これは、ウイーン音楽博物館にある こんなシステム と同じようなものであるが、決定的な違いは「指揮棒が不要」という事である。 Denis本人が言及するように「leap motionでも出来ること」ではあるが、過去の「指揮に従う音楽システム」が、たいていMIDIベースでサウンドだけだったのに対して、これらは演奏ビデオをフレーム単位で追従させているし、さらにDenisのシステムでは「手だけ」なのに、そこそこレイテンシを改善するためにCV回りをチューニングしているようで、さすがである。(^_^)

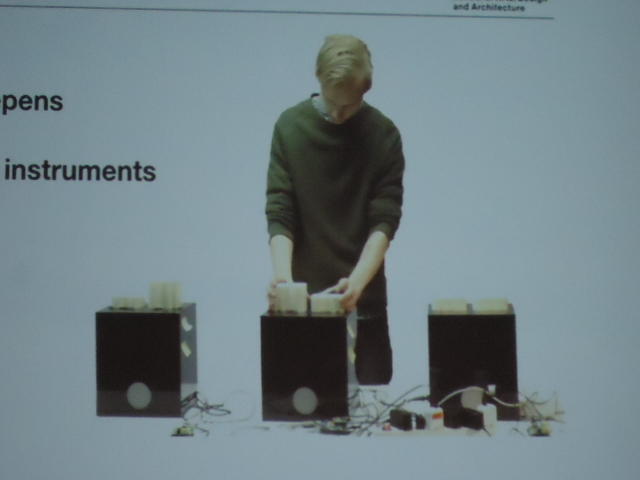

Keynote Presentation 1 - Miya Massoka (17:30, Mon Jul 11) Not Just Gadgets: Interfaces as tools towards empathy and meaning. Miya Masaoka Paper Session 1 (09:00, Tue Jul 12) The Closed-Loop Robotic Glockenspiel: Improving Musical Robots with Embedded Musical Information Retrieval Jason Long, Dale Carnegie, Ajay Kapur Electromagnetically Actuated Acoustic Amplitude Modulation Synthesis Herbert H.C. Chang, Spencer Topel Tromba Moderna: A Digitally Augmented Medieval Instrument Alex Baldwin, Troels Hammer, Edvinas Pechiulis, Peter Williams, Dan Overholt, Stefania Serafin 3D-Sound and VR-Audio: Interfacing specific sound dramaturgies and new perceptional paradigms Sabine Breitsameter Paper Session 2 (11:00, Tue Jul 12) Action-Sound Latency: Are Our Tools Fast Enough? Andrew McPherson, Robert Jack, Giulio Moro The Global Metronome: Absolute Tempo Sync For Networked Musical Performance Reid Oda, Rebecca Fiebrink Coronium 3500: A Solarsonic Installation for Caramoor Scott Smallwood 5500: performance, control, and politics Tomas Laurenzo Paper Session 3 (15:30, Tue Jul 12) A Web Application for Audience Participation in Live Music Performance: The Open Symphony Use Case Leshao Zhang, Yongmeng Wu, Mathieu Barthet Understanding Cloud Support for the Audience Participation Concert Performance of Crowd in C[loud] Antonio Deusany de Carvalho Junior, Sang Won Lee, Georg Essl Game Design for Expressive Mobile Music Ge Wang Design and evaluation of a gesture driven wave field synthesis auditory game Jan Banas, Razvan Paisa, Iakovos Vogiatzoglou, Francesco Grani, Stefania Serafin Paper Session 4 (09:00, Wed Jul 13) The Perception of Live-sequenced Electronic Music via Hearing and Sight Mehmet Aydın Baytaş, Tilbe Göksun, Oğuzhan Özcan Skip the Pre-Concert Demo: How Technical Familiarity and Musical Style Affect Audience Response S. Astrid Bin, Nick Bryan-Kinns, Andrew P. McPherson Evaluating the Audience’s Perception of Real-time Gestural Control and Mapping Mechanisms in Electroacoustic Vocal Performance Jiayue Cecilia Wu, Madeline Huberth, Yoo Hsiu Yeh, Matt Wright Live Writing : Writing as a Real-time Audiovisual Performance Sang Won Lee, Georg Essl, Mari Martinez Paper Session 5 (11:00, Wed Jul 13) The HandSolo: A Hand Drum Controller for Natural Rhythm Entry and Production Kunal Jathal, Tae-Hong Park The 'E' in QWERTY: Musical Expression with Old Computer Interfaces Chris Nash Focal : An Eye-Tracking Musical Expression Controller Stewart Greenhill, Cathie Travers The Laptop Accordion Aidan Meacham, Sanjay Kannan, Ge Wang Paper Session 6 (15:30, Wed Jul 13) Reflection On Action in NIME Research: Two Complementary Perspectives Benjamin Carey, Andrew Johnston An Interactive Software Instrument for Real-time Rhythmic Concatenative Synthesis Cárthach Ó Nuanáin, Sergi Jordà, Perfecto Herrera XronoMorph: Algorithmic Generation of Perfectly Balanced and Well-Formed Rhythms Andrew J. Milne, Steffen A. Herff, David Bulger, William A. Sethares, Roger T. Dean Rhizomatic approaches to screen-based music notation Lindsay Vickery Paper Session 7 (11:00, Thu Jul 14) A Multi-Point 2D Interface: Audio-Rate Signals for Controlling Complex Multi-Parametric Sound Synthesis Stuart James Acoustic Localisation for Spatial Reproduction of Moving Sound Source: Application Scenarios & Proof of Concept Dominik Schlienger Towards a perceptual framework for interface design in digital environments for timbre manipulation Sean Soraghan, Alain Renaud, Ben Supper Minimally Invasive Gesture Sensing Interface (MIGSI) for Trumpet Sarah Reid, Ryan Gaston, Colin Honigman, Ajay Kapur Keynote Presentation 2 - Garth Paine (13:30, Thu Jul 14) Now Garth Paine Paper Session 8 (15:00, Thu Jul 14) BlockyTalky: A Physical and Distributed Computer Music Toolkit for Kids R. Benjamin Shapiro, Rebecca Fiebrink, Matthew Ahrens, Annie Kelly One Knob To Rule Them All: Reductionist Interfaces for Expansionist Research John Bowers, John Richards, Tim Shaw, Jim Frieze, Ben Freeth, Sam Topley, Neal Spowage, Steve Jones, Amit Patel, Li Rui Trends at NIME - Reflections on Editing "A NIME Reader" Alexander Refsum Jensenius, Michael J. Lyons Non-intrusive Counter-actions: Maintaining Progressively Engaging Interactions for Music Performance Koray Tahiroğlu, Juan Gomez Vasquez, Johan Kildalそしてここから、Griffith大学のホールでのNIME2016ペーパーセッションの会場である。 配布されたUSB Proceedingsから、上のようにペーパーの一覧をコピペ整形してみた。 昨日のKeynoteは早退して聞けていなかったが、PDFを眺めてみると、テクニカルというよりはアーティストとしての講演だったようだ。 トップバッターの「The Closed-Loop Robotic Glockenspiel: Improving Musical Robots with Embedded Musical Information Retrieval(Jason Long, Dale Carnegie, Ajay Kapur)」は、小型のグロッケンにセンサとアクチュエータ(ソレノイド)を仕込んだロボットであった。 何か叩くと、そのセンサ情報からハーモナイズとかエコーなどを生成して自動演奏(伴奏)できるというものだが、なんともソレノイドのカチカチが気になって仕方なかった。 質疑の部分でも、このノイズについて突っ込まれていたが、おそらく開発者はこのノイズに慣れっこになって「脳内フィルタ」で消しているのだろう。(^_^;)

次の「Electromagnetically Actuated Acoustic Amplitude Modulation Synthesis(Herbert H.C. Chang, Spencer Topel)」は上のように、電子音響音楽をアコースティックに生成したい・・・というアプローチだった。 ハモンドのレスリースピーカに触発されて、固定した音叉に電磁石とピックアップを近接設置して、あとは低周波で振幅変調するように共鳴させていた。

次の「Tromba Moderna: A Digitally Augmented Medieval Instrument(Alex Baldwin, Troels Hammer, Edvinas Pechiulis, Peter Williams, Dan Overholt, Stefania Serafin)」は、上のように馬鹿長い四角錐のフォルムの、中世の「Tromba Marina」に似せた新楽器だった。 内部にピックアップと触覚トランスデューサを内蔵した力作であるが、これを弾くためにはコントラバスの演奏技法とともに、190cm以上の身長が必要のようで、僕は無理である。 次のステップとして、ボディにチューバの朝顔をくっつける構想もあるというのが凄い。

次の「3D-Sound and VR-Audio: Interfacing specific sound dramaturgies and new perceptional paradigms(Sabine Breitsameter)」は、USB Proceedingsプログラムに載っていない「3D-sound VS VR」というようなトークだった。 このトークの間ずっと、右上腕を揉んでいたが、今回の出張で体調が万全ではない、というのはここである。 原因不明の脱力・痛みが右上腕にだけ起きていて1ヶ月ほどになるが、ここにきてコーヒーのカップを右手(利き手)で持っただ゛けで痛いのだ。 とりあえずひたすら揉んでみたが、謎のままである。 右肘を伸ばしても曲げても痛い、というのは、これまで経験がないので不安なのだ。

ここでcoffee breakがあり、次のセッションとなった。 最初の「Action-Sound Latency: Are Our Tools Fast Enough? (Andrew McPherson, Robert Jack, Giulio Moro)」は、我々のツールはアクションからサウンドまで十分に速いのか? という耳の痛い話題であり、最初に示す結論はもちろん「NO」だった。 ArduinoとMax、あるいはRaspberry Piを使ってレイテンシとジッタの計測をして報告したが、なんか僕が20年ぐらい前に実験して報告して学会で大騒ぎになったのがデジャヴで蘇った(^_^;)。 結局のところ、このグループがKickstarterで開発した新しいLinuxベースのマイコンボード(以下)の宣伝だった。

次の「The Global Metronome: Absolute Tempo Sync For Networked Musical Performance(Reid Oda, Rebecca Fiebrink)」は、ネットワーク時代の音楽セッションのために、地球規模で同期したメトロノームを提案する、という無謀なものだった。 LANはアテにならないので、GPSを使って同期を合わせようということたが、実際には各種レイテンシのために、メトロノームが揃っていても、他者の演奏情報が遅れて届くのであまり意味が無いような気がする。

次の「Coronium 3500: A Solarsonic Installation for Caramoor(Scott Smallwood)」というのは、USB Proceedingsにはあったものの発表はキャンセルだった。 次の「5500: performance, control, and politics(Tomas Laurenzo)」は、去年のNIMEで発表された作品公演に関するメイキングらしく、話がよく分からなかった。 シリア難民のボートが沈んだ゛り、という政治的な話があったり、ステラーク等の美学的な話があったり、何故か僕が10数年前にやった「ピリピリ」があったりして、なかなか混乱した。 ピリピリ電極をトリガして痙攣で演奏がめちゃくちゃになるピアニストにベートーベンのピアノソナタを弾かせる、というのはかなり悪趣味である。 電気刺激による身体表現を美学的に包含したプロジェクト、という事らしい。

そしてここから、ランチブレイクの1時間の間にDemonstrationの部屋(Posterの相乗りホールでなく、ブロジェクタとPAのある立派な1部屋)でセッティング、そして1時間半にわたって、次々に訪れる参加者へのDemoプレゼンを乗り越えた。 自分の写真は1枚も無いものの、またまた多数の「多重うにうにセンサを触って子供のように喜ぶ海外の専門家」の写真が撮れた。 無事に発表を終えて、もう気分は打ち上げモードであり、次のPaperセッションが終わったところで街に戻って、今夜は御馳走で乾杯したい気分である。 ICMCやNIMEではこれまでも、「Paper中心」と「Concert中心」のいずれかのモードで没入してきたが、どうやら今回は前者になりそうで、深夜でなくてもあまりコンサートセッションに気が向かない自分がいるのだ。(^_^;)

朝にICEC2016に対して、「期限となったのに結果通知が無いが・・・」とメイルしていたが、「We are still missing 10 reviews, I hope to have them today or tomorrow.」という言い訳のメイルが届いて、とりあえずは安心というところである。 この調子だと、NIME2016期間中だったカメラレディ提出期限も延びそうだ。 そして午後のPaperセッションとなった。 最初の「A Web Application for Audience Participation in Live Music Performance: The Open Symphony Use Case(Leshao Zhang, Yongmeng Wu, Mathieu Barthet)」はタイトル通りのもので、どうやらこのセッションがスマホのアプリあたりに特化したテーマであると予想させた。 スマホを持っていない僕が苦手なテーマである(^_^;)。 案の定、サーバを「node.js」で記述して、クライアントとはネットで繋がり、ターミナルはProcessingであった。 だいぶ昔に赤松さんがやっていたような、「聴衆が一斉にスマホを掲げる」というやつで、僕は客席で何も出来なかったのを思い出した。

次の「Understanding Cloud Support for the Audience Participation Concert Performance of Crowd in C[loud](Antonio Deusany de Carvalho Junior, Sang Won Lee, Georg Essl)」はやはり、スマホのアプリで「皆んなで演奏」というものだった。 5音のシーケンスでダイアトニックスケールであれば、破綻しないのは当然なのである。 ネット上でシーケンスを重ねて「出会い系」みたいな事をするらしい。(^_^;)

そして次が、上のように、Stanfordのスターの登場「Game Design for Expressive Mobile Music(Ge Wang)」であった。 彼もまた、「Game Disign」ということで、その線から「gameficationl」あたりを古今東西の音楽アプリとともに熱く語った。 後半は彼が開発した多数のアプリの圧巻の紹介で、さすがだった。(^_^)

次の「Design and evaluation of a gesture driven wave field synthesis auditory game(Jan Banas, Razvan Paisa, Iakovos Vogiatzoglou, Francesco Grani, Stefania Serafin)」はなんと珍しくWindowsパソコンでの発表だった。 周囲をぐるりと多数のスピーカで囲んだ空間で、目隠しをした体験者がシューティングする、という空間音響ゲームらしい。 「Wavefield synthesis」ということらしいが、そこまで人間の定位能力は高くない気がした。 そして、終日みっちりのPaperセッションが終わるともうクタクタになり、賑やかな街を抜けて高台のホテルへの帰途についた。 もしかすると今年のNIMEはコンサートは全パスかも・・・という思いが過ぎったが、体調も含めて、まぁ仕方ない。

2016年7月13日(水)

昨日のセッション終了後にホテルに帰る途中、バスターミナルビルの地下にフードコートを発見した。 世界中どこにもあるチャイニーズ系、ケバブ系などのファストフードを確認して、これでまた今回も、ブリズベンで気取ったレストランに入らないで済む算段が出来た。 さらにフードコートの奥に酒屋も発見して、安いワインをホテルに持ち帰ることも出来て、2日目にして滞在パターンが確定した。

過去のICMC/NIMEでもあったが、今回のNIMEは研究発表セッションに傾注して、夜のコンサートは基本的にパスする、というパターンになりそうである。 その大きな理由として、夏の欧露ツアーに向けてぼちぼち作曲モードに入る(そういう時期にはあまり他人の音楽を聴きたくなくなる)、という事もあるのだ。 さらにベストでない体調、そこそこ寒い気候から、どこかに観光に出かける、というoptionも無さそうである。 まぁ、そういうストイックな国際会議も、悪くない。

セッション4の最初、「The Perception of Live-sequenced Electronic Music via Hearing and Sight(Mehmet Aydın Baytaş, Tilbe Göksun, Oğuzhan Özcan)」は、「Live-sequencing」というテーマだった。 シーケンス音楽をライブパフォーマンスというのは不思議だが、つまりはDJネタである。 フランスのアクースモニュームの方がよほど「Live-sequencing」であるが、PV/MVのように、DJプレイの手元を効果的に見せるというものだった。 ビジュアル付き音楽だと手元を見るが、ビジュアルだけだと顔を見る、というのは、なんか当たり前な気がした。

次の「Skip the Pre-Concert Demo: How Technical Familiarity and Musical Style Affect Audience Response(S. Astrid Bin, Nick Bryan-Kinns, Andrew P. McPherson)」は、コンサートのリハーサルについての演奏者と聴衆に 対する実験心理学的なもので、このセッションはどうやら「知覚認知ネタ」である、と判明してきた。 あまりNIME的ではないのか、遅刻者も多かったし、受けもイマイチな気がした。(^_^;)

次の「Evaluating the Audience’s Perception of Real-time Gestural Control and Mapping Mechanisms in Electroacoustic Vocal Performance(Jiayue Cecilia Wu, Madeline Huberth, Yoo Hsiu Yeh, Matt Wright)」は、ボーカルパフォーマンスとジェスチャとの関係の知覚認知ネタである。 ただし発表者本人が会場には不在で、なんとカリフォルニアのサンタバー バラ/スタンフォードからのライヴ・ネット中継での発表だった(^_^;)。 これまで過去には、「発表者は必ず参加すべし」というルールがあったのだが、参加費を払えばこういうのもアリになるのだろうか。 なんと質疑応答まで、ネットライブ中継でやってしまっていた。

・・・ただし、このネット発表を聞いている最中に、重大な2つのアイデアにヒットしてしまった。 一つは、今年とかでなく今後に繋がる、新しいComputer Music作曲のテーマである。 これは基礎的な実験から、じっくり取り組む必要がありそうだ。 もう一つは、今年のうちに片付ける必要がある作曲ネタを思い出した(^_^;)、というものである。 これはさっそく、ブリズベンでも内職モードで開始していこう。次の「Live Writing : Writing as a Real-time Audiovisual Performance(Sang Won Lee, Georg Essl, Mari Martinez)」は、リアルタイムにタイピングした英文の文字に割り当てたサウンドを生成するシステムによるパフォーマンスであった。 固定的なモーションタイポグラフィーの映像を、ライブ生成にする、というものだが、言語的背景が異なる相手にはアピール出来ない、という本質的な限界がありそうである。 日本であれば毛筆でやったら面白いかもしれない。

セッション5の最初、「The HandSolo: A Hand Drum Controller for Natural Rhythm Entry and Production(Kunal Jathal, Tae-Hong Park)」は、ドラムマシンの不自然なスイッチパッドでなく、太鼓の皮を叩くような自然な動作をしたい、というものである。 テーブルの端にマイクを設置して、手のひらの底部でバスドラム、指先でハイハット、げんこつで曲げた指でスネアを鳴らす。 マイクの音色からこの叩き方を検出しているということだが、3種類だけのドラムでいいのか、同時に複数を叩いたら・・・など、突っ込みどころも完備していた。

次の「The 'E' in QWERTY: Musical Expression with Old Computer Interfaces(Chris Nash)」は、昔ながらのコンピュータキーボードにArduinoを付けて改造して、圧力センサ付きの音楽キーボードにした、というものだった。 まぁ、Maxパッチの「key」入力でもタッチ以外は出来るので、ポイントは「昔ながらの」というところなのだろうか。 ところが発表を聞いてみると、USBキーボードの部分はそのままで、単に加速度センサ(タッチレスポンス)のボードを入れて、その出力をArduinoからMIDI出力しているだけだった。

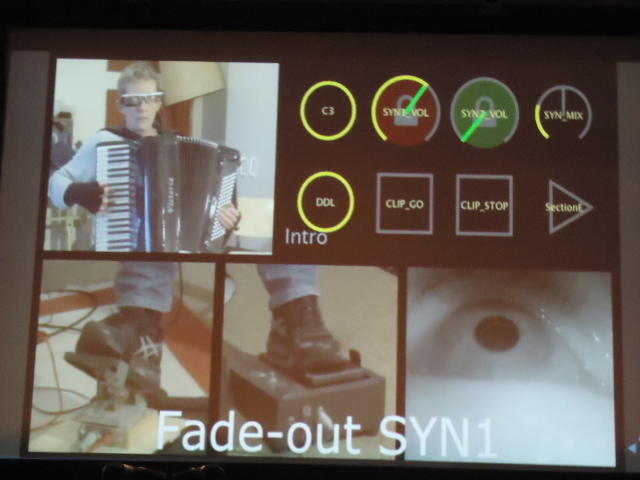

次の「Focal : An Eye-Tracking Musical Expression Controller(Stewart Greenhill, Cathie Travers)」は、両手が塞がっているアコーディオン演奏のために、視線追従センサを使おう、というものである。 フットペダルもなかなか面倒だ、ということらしい。 確かに、アコーディオンの演奏姿勢で、足をあちこち動かすのは大変そうだ。 しかし、デモ動画を見てみると(録画した)、HMDをモニタしながら視線でコントロール、というのは、ちょっと超人的な習熟が必要のでは、と思えた。

次の「The Laptop Accordion(Aidan Meacham, Sanjay Kannan, Ge Wang)」は、文字通り、ラップトップでアコーディオンである(^_^;)。 ノートパソコンのディスプレイの開け閉めの角度でアコーディオン演奏をしているが、これは一気に壊れそうである。 肝心のヒンジのセンシングは、Webカメラの画像認識から行っている。 ・・・しかし最後にライヴでデモった演奏は、かなーーり残念だった。

YouTube

ここでポスター/デモセッションの2日目となり、ザッと見回したところで休憩しながらメイルをチェックすると、Denisからの「招待状をDHLで送った」とのメイルが届いたので、上のようにまとめた写真(昨日のデモの様子)を送り、さらに 僕のpaperのURL を知らせておいた。 デモセッションでは、今更という「leap motionでの動作センシング」があったり、Myoを使ってダンサーがインタラクションする、というものもあった。 来年になったらMyoも「今更」、ということになるのかな。

続くセッション6の最初、「Reflection On Action in NIME Research: Two Complementary Perspectives(Benjamin Carey, Andrew Johnston)」は、「Practice-based Research」について、という謎なものだった。 要するに、NIMEはたいていコレだと言う。 まぁ、インタラクティブ・パフォーマンスを実現するための道具(新楽器/インターフェース)やツール/システムの制作というのは、まさにPractice-based Researchだ、というのに異論は無い。 そしてマル2日たって、ようやくこのあたりで、「英語が入ってくる」感覚が生まれた(^_^)。 もうNIME2016は折り返し点あたりなのだが、まぁ日頃は英語シャワーを全く浴びていないので仕方ない。

次の「XronoMorph: Algorithmic Generation of Perfectly Balanced and Well-Formed Rhythms(Andrew J. Milne, Steffen A. Herff, David Bulger, William A. Sethares, Roger T. Dean)」は、上のような「リズミック・ループ・ジェネレータ」というシステム(Maxパッチ)である。 まだまだこういうのが出てくるところがNIMEであるが、おかげでちょっとしたアイデアを思いついた。 「ループ」ということで、直線的なシーケンサがジャンプ復帰するよりも、円周上に配置した多角形をリアルタイム描画するところが面白い。 ループの1周の時間を変えず、変拍子は円周上に等分n角形を配置する、というのは、僕が1995年に作った"David"と同じだった。 ただしスケールはダイアトニックとかペンタトニック・・・というところで、ブルータスよお前もか、と思った。

次の「An Interactive Software Instrument for Real-time Rhythmic Concatenative Synthesis(Cárthach Ó Nuanáin, Sergi Jordà, Perfecto Herrera)」は、上のように、サンプリングとモーフィングをマルチメディアで、という、これも王道のツールであった。 しかし、1つ前の発表もそうだが、一瞬は「いい感じ」であるループ音楽も、クラブで飲みながら踊りながらであればいいかもしれないが、スグに飽きてしまうのが致命的である。 本人が「もろEDM向け」・「ハーモニーとメロディーは今後の課題」と開き直っているのでどうしようもないが、これは何とかならないのか。(^_^;)

プロクラムでは、次は「Rhizomatic approaches to screen-based music notation(Lindsay Vickery)」となっていた。「Rhizome」とは「根茎」のことらしいので、例えば地下鉄のマップを根茎ネットワーク図と見做して、ここからグラフィック情報を可聴化する、という音楽生成システムのことらしい。 上のように予稿の図はなかなかソソラレルものだった。 しかし発表していた内容は「Arduinoを使ったサウンド・インスタレーションいろいろ」(^_^;)だったので、どこかで取り違えがあったらしい。 2件の発表が差し替えになったのであれば、明日までの残りのセッションのどこかで、上の図の発表に出会える事を期待しよう。

そしてPaperセッション終了後、Trainで移動して「NIMEバンケット(ディナー)」に参加した。 来年のNIME2017がコペンハーゲンで5月中旬にある、というホットなニュースをMichaelからゲットしたのが収穫である。 そして美味しいメルローワインを3杯ほど堪能して、ホテルに帰った(コンサートはパス(^_^;))。 まだ現地20時なので、ここまでのところを Web に上げて、後半戦に集中することにした。 いよいよ今年のブリスベンは「観光ゼロ」というストイック路線になりそうである。

2016年7月14日(木)

前夜にバンケットの後で深夜までコンサートがあったためか、この日のPaper Sessionは朝イチでなく朝(11:00)からだった。 今日は初めてホテルの朝食をルームサービスで依頼してみたが、朝からベーコンエッグで気合い満タンである(^_^)。 ここまでに日本から届いてやりとりしている中には、総合演習IIのための作曲を進めている4回生の西山さんから送られた試作にコメントしたり、「音楽情報科学」のチーム制作の経過を報告してきたうららにリプライしたり、MACS-MLに「来年のNIME2017はコペンハーゲンで5月中旬」というニュースを伝えたり・・・と色々である。

Sketchingコミュニティでは、メンバーからの以下の問いかけに対して、世界中の腕っこきのメンバーが次々にコメント・アドバイス・関連情報提供などをポストしていて、MLの持ち帰りメイルは1日で17本にもなっている。 まったく凄いコミュニティだ。(^_^)

One of my students, #### ##, is working on a cool human-robot interaction project where she has a water cooler robot that roves around and tries to promote creative collaboration. One thing she would like to do is to track where people are (only with their permission, of course!) so that the robot knows where to amble. My initial inclination was just to use Tile and to ask all the people at the Center for Design Research, where we're dogfooding this system, to carry a Tile with them and install the app on their phones, and to share that location with a central watercoolerBot account. However, when I looked into it, Tile doesn't have a good SDK or API out for looking up the location info for all the tags outside their app. Does anyone have a positive experience using BLE for location tracking, and have a good alternative? Or maybe someone has an inside track for someone to talk to at Tile?この日はセッションのスタートが遅いので、ホテルから会場のSouth Bankまで歩く途中でスタバに寄ってモールのベンチでまったりしたが、考えてみると、高台にあるホテルから会場までは直線で2kmほど、おそらく実際には3kmほど歩くので、ちょうど自宅から毎日、SUACまで徒歩で往復しているようなものである。 大学に歩いて行くのはごくたまに、飲み(カラオケ)がある日に限っているので、こちらに来てからというもの、体調がイマイチと言いながら、けっこう普段よりも健康な日々を過ごしていることになる。(^_^;)

そしセッション7の最初、「A Multi-Point 2D Interface: Audio-Rate Signals for Controlling Complex Multi-Parametric Sound Synthesis(Stuart James)」は、AM→FM→FFT-based、と進展してパラメータ数が爆発的に増大してきた歴史をふまえて、最大32768個。最大32チャンネルの楽音合成に対応したインターフェースを提案する、と豪語したものである。 そこでOpen-GLを使って2次元空間にパラメータを展開表示する、というものらしい。 MaxでなくJava(Processing?)で書いていたが、「綺麗だけどよく分からない」ものだった。 最後のデモで実際のサウンドを聞いてみると、2次元表示で矩形からアトラクタ曲線にモーフィングした時のサウンドのメタモルフォーズが面白かったが、FFTパッファごとに区間を区分して表示するのが残念だった。

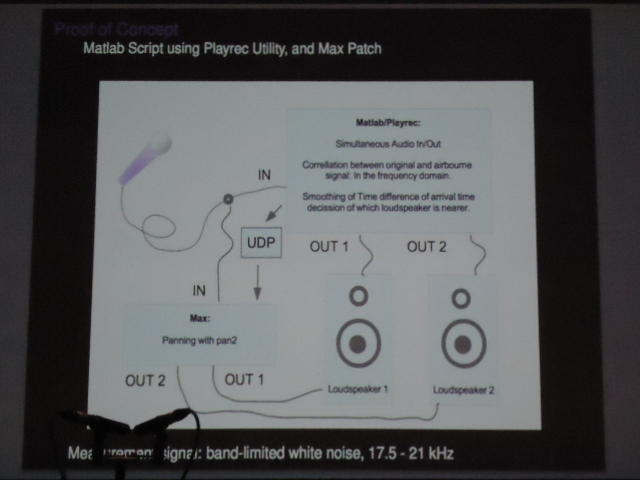

次の「Acoustic Localisation for Spatial Reproduction of Moving Sound Source: Application Scenarios & Proof of Concept(Dominik Schlienger)」は、音源のステレオ状態をシステムが検出して自動でパンポットを追従させる・・・というものらしかったが、冒頭にデモを決めてからプレゼン席にパソコンを移動したらプロジェクタに出ない、というドタバタだけが印象に残った。 10分近くあれこれして、ようやくスクリーンに画面が出ると、恒例の拍手喝采(「何やってんだ」の意味(^_^;))となったが、一体、何だったのか、ちょっと不明である。 Jazzカルテットの演奏中にステージ上にドローンを飛ばして移動マイク・サウンドを収録する・・・というのは、ノイズはどうだったのかなぁ。

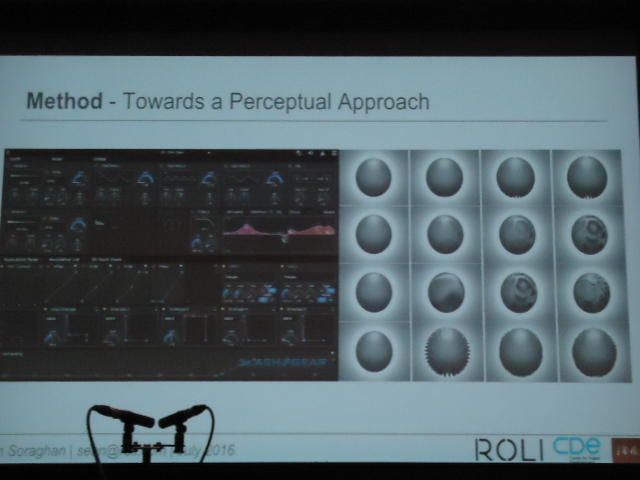

次の「Towards a perceptual framework for interface design in digital environments for timbre manipulation(Sean Soraghan, Alain Renaud, Ben Supper)」は、Unityを使ってサウンドのVisualizationを行いつつ、 同時にCVから両手の位置を検出してサウンド系に送る、というものだった。 「身振りでサウンドを生成・制御しつつ、可視化する」という意味では、なかなか面白かった。 グラフィックを全てグレースケールとして、敢えてcolorを使わないのは良かった。 ただし片手で小型の鍵盤を持つ、というのはちょっと反則である。

次の「Minimally Invasive Gesture Sensing Interface (MIGSI) for Trumpet(Sarah Reid, Ryan Gaston, Colin Honigman, Ajay Kapur)」は、これまでにも数多く作られてきた「トランペットのためのセンサ」である。 売りとしては、トランペットのビストンのお尻の部分を外してアタッチメントとして嵌めるだけ、というところらしい。 デモの動画はなかなか良かったが、要するにMSPでまの信号処理が上手い、というところが大きかった。 いつも思うのだが、ダンサーがいてスクリーンにグラフィックが出て色々な音楽家がサウンドを出しているパフォーマンスだと、せっかくの楽器の演奏がセンサでリアルタイム制御されているのが分からずに「当て吹き」に見えてしまうのが辛いところである。

ランチブレークを挟んで、次のセッション「Keynote Presentation 2」という「Now(Garth Paine)」は、実際には「New Interface <> Musical Expression」と改訂されていた(^_^;)。 今日一番の大入りの中で大ベテランがおおいに語ったが、「Somatic Relationship to the instrument/interface」という項目が気になった。 「Techno-Somatic」というキーワードは、今後も頭に置いていきたい。 最後の質疑応答のところで「どうして楽器メーカは、使えるインターフェースを出さないんでしょうね」という鋭い話題になり、文脈の中で「ヤマハ」という名称も登場したが、滔々と流れる英語の渦の中で詳細は不明だった。(^_^;)

そしてCoffee Breakを挟んで、遂に、最後のセッションになった。 考えてみると、過去のICMCでもNIMEでも、「全ての研究発表セッションに完全に皆勤賞で参加」した、というのはほとんど無かったような気がする。 たいていは途中でちょっとだけ抜けてプチ観光(^_^;)とか、あるいはコンサートセッションに採択されていれば、リハーサル等でどうしても抜けるからである。 今回は、「体調いまいち」「季節が冬で観光に向かない」「作曲を控えてコンサートに足が向かない」というような条件が重なったためか、結果としてPaper Session皆勤賞になったようである。

そのセッション7の最初、「Non-intrusive Counter-actions: Maintaining Progressively Engaging Interactions for Music Performance(Koray Tahiroğlu, Juan Gomez Vasquez, Johan Kildal)」は、「NOISA System」という、謎の「ネットワーク接続されたモジュールでのセッション」というような発表だった。

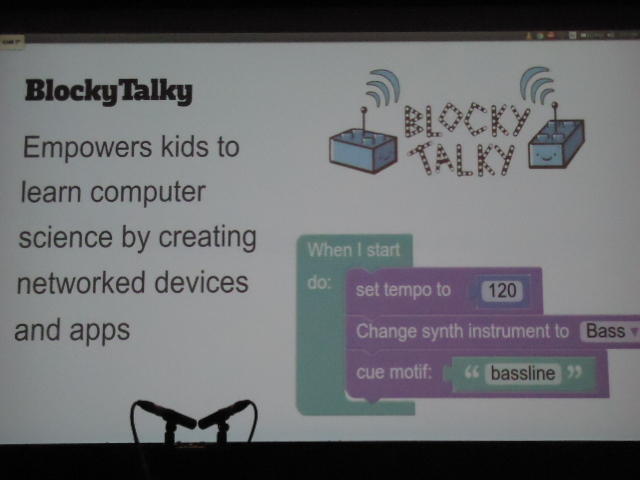

次の「BlockyTalky: A Physical and Distributed Computer Music Toolkit for Kids(R. Benjamin Shapiro, Rebecca Fiebrink, Matthew Ahrens, Annie Kelly)」は、子供のための遊べる楽器、というプロジェクトである。 センサのモジュールをワイヤレスで繋いで、Scratchのようなグラフィックなツールでプログラミングできるらしい。 ただしサウンド生成も専用のワイヤレスモジュールのようで、かなり昔風の音だった。

次の「One Knob To Rule Them All: Reductionist Interfaces for Expansionist Research( John Bowers, John Richards, Tim Shaw, Jim Frieze, Ben Freeth, Sam Topley, Neal Spowage, Steve Jones, Amit Patel, Li Rui)」は、いちばん声のデカい、頭頂が皆無なのに白髪の顎髭フサフサのおっさんが発表した(^_^;)。 どちらかというとArtisticというよりはDesignに重点がある印象だった。 あまりの大声に、これ見よがしに途中で退席する者も出て、なかなか後味の微妙な発表だった。

最後の「Trends at NIME - Reflections on Editing "A NIME Reader"(Alexander Refsum Jensenius, Michael J. Lyons)けは、まさに今年のNIMEセッションのトリにふさわしいものだった。 元々、NIMEというコミュニティをスタートさせた創始者として、過去15年間の1200本の論文を全てサーベイして、マイルストーンとなる論文をセレクトするとともに、15年間のNIMEの歴史からトレンドを分析・抽出した、という力作である。 全部ではないがスクリーンを撮った記録は今後に向けた宝物である。(^_^)

最後のセッションは「Town Hall (16:30, Thu Jul 14)」というもので、要するにNIME総会だった。 色々に活躍してくれたスタッフを賞賛して慰労し、「ベストペーパー」と「大会委員長のお気に入り」を発表した。 さらには「自己点検評価」というのか、「What was great?」・「What can be better?」というディスカッションを行ったが、ここらの怒涛の英語はとてもキャッチしきれなかった。 そして、来年のコペンハーゲンが正式発表された。(^_^)

2016年7月15日(金)

昨日はバスターミナル地下のフードコートで、ブリズベンに来て2本目のワイン(カベルネ・メルローが10ドル!!)を仕入れたが、6日間も滞在するのに計たった2本というのは珍しいスローペースである。 やはり体調を気遣ってのことなのだ(^_^;)。

ズルズルと採択結果通知が遅れているICEC2016からは、先日の問い合わせに対して「あと2日ぐらいで・・・」とリプライがあったが、調べてみるとICEC2016の公式サイトの「Important Dates」のところに、以下のように「7/14, YES, Really !」と書かれたが、いくら待ってもメイルが届かなかった。 GMTを基準とするなら、これを書いているのは日本で08:30なので(ブリズベンは09:30)、あと30分で14日が終わるのだが。

というわけで、NIME2016の最終日、「Unconference」という自由なワークショップ群に参加している。 朝イチで参加したのは、「3Dプリンタで吹奏楽器のマウスピースを自由に作っちゃおう(^_^)」というものである。 古い楽器屋には想像がつかなかったが、考えてみれば響板ではないので、素材として「木」は必須ではないのだ。 必要なのはサウンドを生み出す、あるいはリードを振動させるための「気流の生成」なので、素材はABS樹脂などでもいいわけだ。 僕はリコーダー(木製)しか吹いたことがないのでちょっと信じられなかったが、十分にイケるのだという。 時代はOpen Soureceであり、自分でCADで設計しなくても、いいデータがネットに多数あり、これをDMM.comみたいなところに出して現物を試作させることが出来るわけである。

NIME Unconference (workshops and sessions open to the public at The Edge, State Library of Queensland) 3. 3D PRINTING AND ACOUSTICS Music Maker is a free online resource that provides files for 3D printing woodwind and brass mouthpieces and tutorials for using those mouthpieces to learn about acoustics and music. This workshop will explore the use of these tools in curriculum with the aim to bridge the gap between the digital world of fabrication and the real-world materials that make up our daily lives. Time: 9:00am to 10.30am Presenter: Sasha Leitman 5. Performing with USB controllers Tim Opie provides a demonstration and workshop on the use of standard USB game controllers as interfaces for sound performance. Time: 10.30am to 12pm Presenter: Tim Opie 6. The Sonic Manipulator Claude Woodward (The Sonic Manipulator) presents a demo / workshop on his approach to designing a MIDI controller for complex articulation of synthesis parameters in live performance. Time: 1pm to 4pm Presenter: Claude Woodward 8. Unconference showcase An evening of new music featuring artists demonstrating unique and innovative approaches to live performance. Time: 7.30pm to 9pm事前に参加申し込みしていた、今日のメニューを発掘して置いてみたが、上のように充実した1日である。 ただし今回のNIME参加形態からして、最後の晩のライヴはパスしそうである(^_^;)。 そして3Dプリンタのワークショップの後半には、参加者がそれぞれ、へんてこりんな吹奏楽器を作っては即興的に鳴らす、というぐじゃぐじゃなフリーセッションに突入した。 トランペットタイプのマウスピースはまともに吹いたこともなかったので苦労したが、お持ち帰りをゲットしたので練習してみることにしよう。

2番目の「Performing with USB controllers」は、いきなり講師が「Max5とMax6とMax7とを体験利用すると、合計3ヶ月はタダで使える」などと説明を始めて(^_^;)、要するに「Max講習会」のようなスタートとなった。 これはちょっと外れだったか・・・といやな予感がしたが、話は「hi」、つまりUSBヒューマンインターフェースオブジェクトの解説となった。 これまでゲーム用のコントローラを使ったことは無かったが、どうやら「hi」オブジェクトで使えるらしい。 隣に座っていた人にゲームコントローラを借りて、ヘルプを頼りに実験してみたのが以下の画面である。

そして、話は次に「makenote」「noteout」の解説に進んだが、これはもしかして、僕が2回生の講義「サウンドデザイン」の初日か2週目にやっている事である。 せっかくのコントローラのボタンのうち、A/B/X/Yだけを使っていて、室内がかなり沈黙に包まれていて、一人、また一人、と、終わっていないのに退出する人が続いた(^_^;)。 結論として、「市販のゲーム機のUSBコントローラは、Maxに繋いでhiオブジェクトによって操作情報を取得できる」という事だが、出来合いのゲームコントローラにまったくそそられない僕としては、これを使うことは今後も無さそうで、やはり、ちょっと外れを引いてしまったようだ。 ただし、学生にとってはゲーム機のコントローラは身近なものであるとしたら、せっかくなのでこれを講義の中で紹介するのも悪くないかもしれない。

午後に2コマをぶち抜いて行われたのは、「The Sonic Manipulator mk2」という巨大なアクリル造形コンソールを据えた、どう考えてもクレイジーな作家のセッションである。 テーブルからコンソールまで全て透明のアクリル版で組み立てて、そこに無数のコントローラが並んでいるのは単純に壮観である。 詳しくは後日に ここ に上がるであろう写真を見て欲しいが、ちょっと早めに会場に入って接写したので、見応え満点である。 ただし、実際にはMIDIコントロールでSAWTOOTHサウンドを鳴らしていて、どちらかというとDJライヴあたりで活動している・・・という第一印象であった。 そして実際に始まってみれば、まさに「もろDJ」だった(^_^;)。 サウンドの生成は多くのプラグインを活用しているが、伝統楽器の演奏を頭に置いて、コントローラは単一のパラメータを変えるのでなく、例えば音量と音色とベンドを同時に変化させるようにしていて、要するにこの人はクレイジーな音楽家だった。 MIDIコントロール・アナログシンセモジュールのプラグインを完璧に使い倒しているのは圧巻だった。

そして14時過ぎ、日本時間で13時過ぎにチェクッしてみると、ようやくICEC2016からの連絡が届いていた。 冒頭を見れば分かるが、「We regret to inform you that your paper ...」というのは、つまり「残念でした」という事であった(;_;)。 3人のレフェリーは1人がweak reject(-1)、1人がreject(-2)、1人がaccept(2)ということで、これで今年は「3勝1敗」ということになった。 やはり、およそ1日でやっつけた原稿では無理があったか・・・と反省であるが、まぁ仕方ない。 欧露ツアーの最後のウイーンのICEC2016については、発表ナシの聴講参加ということで、これで「振動手袋」は荷物に入れなくてもよい、と確定した。 Claude Woodward氏の講演は色々な楽器演奏とともに続いたが、どうも彼はプログレだ・・・と思っていたら、遂に「スイッチト・オン・バッハ最高」・「基本はミニムーグ」という話に到達して、間違いなく彼もプログレである、と判明した。

内容充実のアナログシンセ音を浴びて、ここは会場のロビーである。 ここはGriffith大学ではないので昨日までのWiFiが使えないが、モバイルWiFiルータが強力で、これは夏の欧露ツアーにも必携だと確認できた。 晩のコンサートは19:30から、という事で心おきなくパスして、ICEC2016の結果にちょっとヘコんで(^_^;)、まだ明るい会場を後にすることになった。 コンサートセッションとともに、今回は「完全に観光ゼロ」というストイックな出張となったので、モールのカフェで軽く一杯やってからホテルに帰ることにした。

2016年7月16日(土)

帰国日となったこの日、朝からABCニュースはライヴで「トルコのクーデター」を中継していた。 これはどうも、デザインの同僚・高山先生の教員交換プログラムでの1年間トルコ行きも微妙である。 僕の夏の欧露ツアーは、敢えてパリを避けてブリュッセルからボルドーに行き、ボルドーからバルセロナまでは1日かけて列車で行く予定であるが、地中海リゾートのニースとは違うものの南仏を通過するので、ちょっと注意しておく必要がありそうだ。 考えてみれば今回の出張の間に、初日から日本の参議院選挙(僕は不在者投票済)、さらに都知事選挙、ハーグ裁判で中国の敗訴、イタリアの列車正面衝突事故、英国ではメイ首相就任、そしてフランス・ニースのトラックのテロ、とあれこれBreaking Newsが飛び込んできた。 その中で、天皇陛下が「生前退位」と身を挺してまで悪しき憲法改正に反対される姿勢が世界中から賞賛されていたのが印象的だった。

今回は謎の関節痛という体調不良がずっと続いたこともあり、余計なことに注ぐ精力が削がれて「全てのPaperセッションに皆勤」、そしてまったく観光モードを封印した、という意味でもかなり画期的である。 当初はこの最終日は、夕方16時にブリズベン空港の国内線ターミナルからシドニーに飛んで、シドニーから羽田の国際線に乗り継ぐまで、およそ半日の市内観光を・・・と思っていたのだが、季節が冬であること、チェックアウトしても荷物を預けて取りに戻るにはホテルが高台(延々と続く坂道の上)にあること、等から既に自分の中で却下していた。 そして今ここはブリズベン国内線の搭乗口であるが、昼前に国際線ターミナルに行ってラウンジを探したが見当たらず(出国ゲートの後らしい)、軽い昼食とビール/ワインで過ごしてから国内線ターミナルにバスで移動してまたワイン・・・と、すっかり昼間から「まったりモード」で過ごした。 往路と同様に帰路のVirgin Australia航空はdelay(35分遅れ)しているが、どうせシドニーでの乗り継ぎが3時間ほどあるのでまったく焦らない。 オーストラリアはやはり英国であり、iPodで聴く音楽はLed Zeppelin一択である。(^_^)

・・・そしてここはシドニー空港の端っこのANA搭乗口である。 現地時間20時過ぎ、日本は土曜の19時過ぎで、あと40分ほどで飛び立つと、羽田に着くのが朝5時半という、往復ともに機中泊となった。 モバイルWiFiは強力で便利である、とあちこちで実感したが、ここでも大活躍である。 ブリズベンからの国内線は遅れに遅れて1時間15分ほど遅れたが、まぁ羽田へのフライトまでは余裕があったので、全体としてゆっくりと出発を待つ感じになった。 7日間に届いたメイルのうち、スパムや無関係のものを全て削除したものの、「控え用」フォルダに溜まったメイルは82本であり、これは日曜の午前にSUACの研究室に戻ったら全て処理してしまわないといけない。 というのも、翌7月18日(月・祝)は再びSUACから新幹線に乗って大阪に行き、阪神甲子園球場ライトスタンドで巨人戦の応援だからである。 この日記もHTMLが200kBを超えたので、ここを区切りとして、次はpart2に進むことにしよう。

フォトレポートはここ