SCANNED SYNTHESISのための身体動作コントロール

Body operation control for Scanned Synthesis

長嶋 洋一

Abstract : This paper describes a development of sound synthesis system as application of new sound generating technique "Scanned Synthesis". Scanned Synthesis is intuitive physical model of sound synthesis in a time domain. I have developed 16-channels EMG sensor system, and assigned the real-time performance information to parameters of Scanned Synthesis. The new sound synthesis system was constructed on the Max/MSP/Jitter platform with real-time graphic information.1. はじめに

物理モデル音源の一種で時間領域での直感性に優れた新しい手法"SCANNED SYNTHESIS"の応用として、楽音合成パラメータを多チャンネル筋電センサにより直接にリアルタイム制御する音源システムを開発した。Max Mathewsらによって1998-2000年に開発・提唱された新しい物理モデル音源方式であるSCANNED SYNTHESISは、図1のように、人間とのHCIインターフェースのレートによってアクションを与える物理モデルと、その物理モデルの振動状態をディジタルオーディオのサンプルレートで走査してサウンド化する部分とからなり、IFFTなど一般的な楽音合成システムが人間の聴覚にとって自然な周波数領域での可視性を特徴とするのに対して、時間領域での音響の可視性を特長としている。[1]-[3]

Fig.1 Scanned Synthesis

Granular SynthesisやAttractor Synthesisなどの音源システムの研究、マルチメディア・アートの研究と公演、多種のオリジナルセンサの開発などを進めてきた筆者([4]-[9])は、1999-2002年に開発してきた、オリジナル筋電センサ"MiniBioMuse"シリーズの多チャンネルリアルタイム身体動作情報を、この新しい楽音合成システムに応用したシステムを開発・実験した。本稿はその報告の第1報である。

2. Max/MSPでのScanned Synthesisの実装

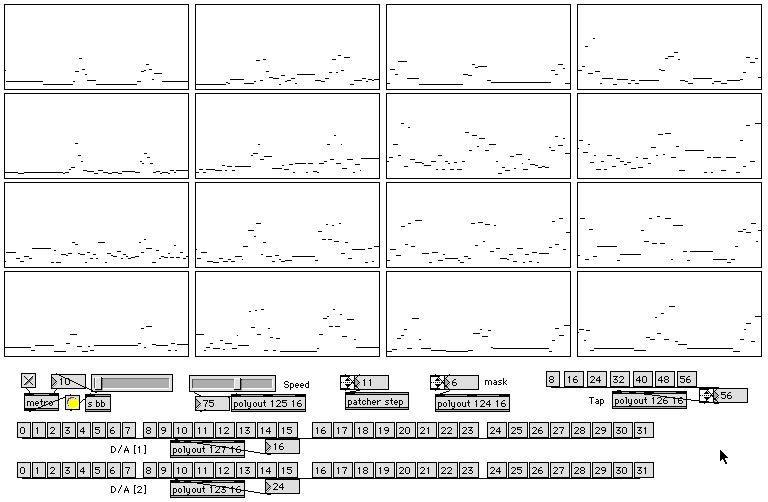

Max MathewsとともにSCANNED SYNTHESISを開発したのがBill VerplankとRob ShawとInterval Research社である関係で、一般的にはこのシステムはCSound上に実装されて研究されている。 しかしComputer Music研究のプラットフォームとしては、Max Mathewsの弟子たちが開発・発展させてきたMaxが世界定番であり、Maxはリアルタイム信号処理系MSP、さらに64次元マトリクス処理系Jitterと拡張発展し、サウンドからグラフィクスまでの広範なリアルタイム処理をフレキシブルなGUI環境で構築できる。そこで本研究では第一ステップとして、Max/MSP上にScanned Synthesisを実装する実験から始めた。図2はその開発・実験中のMax/MSPメインパッチの画面例であり、ここでは実際に初期値として16バンドに分割された波形メモリにサイン波形をセットし、リアルタイムに44.1KHzでスキャンして任意のピッチのサウンドを生成している。 以下、この実装について解説する。

Fig.2 Max/MSP Patch for Scanned Synthesis

2-1.波形バッファと初期化

Max/MSPの"buffer~"オブジェクトを6msecの波形バッファとして定義し、44.1KHzサンプリングで264.6サンプルとなるこのバッファの先頭256バイトを利用した。 図3は初期化としてこのバッファにサイン波をセットするサブパッチで、さらにこの内部パッチ"buff_write"では、"peek~"オブジェクトによって直接メモリアドレスを指定してデータを書き込んでいる。

Fig.3 Initialize SubPatch

Scanned Synthesisの物理モデルを構成する16バンドに分割したスキャンメモリは、データの可視化のために"vslider"オブジェクトを16個並べて構成した。 これにより、変化した各バンドのデータはスライダーによってリアルタイムに可視化され、同時にユーザがこの個々のスライダーをマウスで操作して、パラメータを個別に変化させることもできる。 図4はこの16個のスライダーに現在の256ポイントの波形データの代表値をロードするサプパッチである。

Fig.4 SubPatch to set Scanned Memory

2-2.スキャンメモリから波形メモリへのロード

上記の初期化における波形メモリからスキャンメモリへのロードは、情報量が減少するので代表値を抽出するだけでよい。 図5はこの逆に、16バンドのスキャンメモリの特定の値が変化した時に対応する波形メモリのデータを設定するサブパッチである。 ここでは、各バンドの中央値を設定するだけでなく、両隣りのバンドとの境界が接続しないと不連続ノイズとなるので、それぞれ中央値と隣接バンドの境界値を線形補間して波形データを決定している。

Fig.5 SubPatch to set Waveform Memory

図6は、図5のサプパッチから次々に呼び出される各バンドの波形データを演算するサブパッチの一つで、44.1KHzの読み出しオーディオサンプリングレートとデータの書き換えが競合しなないようにタイミングを調整している。

Fig.6 SubPatch to calculate each Band

3. 16チャンネル筋電センサ"MiniBioMuse-III"

筋電センサといえばBioMuseという高額な装置が有名であるが、筆者は敢えて、小型軽量(可搬)・バッテリ駆動・リアルタイムに筋電情報をMIDI化する・シンプルで安価な筋電センサのオリジナル制作を目標として掲げ、"MiniBioMuse"と名付けて実験・開発を進めてきた[10]。 以下、その概要ついて簡単に紹介する。

BioMuse (www.biocontrol.com)

3-1.筋電センサの課題と旧バージョン

通常の物理量センサに比べて、生体センサには「個人差」「高感度」「ノイズ抑止」「使用感」などの課題が加わる。

「個人差」とは、同じ生理指標でも個人ごとのばらつきが大きく、非力な人の中にはまったく筋電パルスが検出できない人もいる。

「高感度」は当然のことで、電気信号として得られる情報は全て微弱なものなので、高倍率増幅は必至である。

「ノイズ抑止」は技術的にはもっとも重要なもので、生体から発生する他の信号、周囲環境から混入するノイズ信号とともに、ハムの除去が切実な課題となる。

「使用感」とは、ベッドに固定されているわけではなく音楽演奏という身体表現に利用することを目的としているので、自然な動作を制限するような形態でセンサを取り付けることができない、という実装上の課題である。図7は、筆者が初めて開発した初代の筋電センサ"MiniBioMuse-I"である。 回路としてはOPアンプによる差動増幅回路を採用し、両腕のセンサ電極(パソコンのメモリ増設時に静電気破壊を避けるために利用するリストバンドを改造)だけでなく足首にハムをキャンセルするための第3の電極を取り付けた。 OPアンプのために006P電池を2つ使用するなど課題も多かったが、VHSビデオテープ程のサイズながら筋電ノイズそのものをアナログ出力しつつ同時にA/D変換してMIDI出力する、という機能には、BioMuseの開発者でありBioMuse音楽家でもあるAtau Tanaka氏(現Sony CSL Paris)からも良好な評価を得た。

Fig.7 MiniBioMuse-I

図8は、さらなる新たな改良を加えて開発した"MiniBioMuse-II"である。 電子回路的には、ノイズの点で限界のあるOPアンプによるフロントエンド回路から、高感度デュアルFETを用いたディスクリート・トランジスタ回路へと発展した。 これは、特性の揃った2つのFETを金属ケースで熱結合した特殊なFETである2SK146により、単一電源で良好な高倍率差動増幅回路を実現したものであり、小型ケースに2チャンネル×2電極とコモン電極の全ての回路を格納した。 アナログ電圧出力はケーブルで延長したサブボックスでMIDI化するように分離した結果、照明などノイズ環境の劣悪なステージでのライブパフォーマンス(京都と神戸で公演)にも使用できる、という実績を得た。

Fig.8 MiniBioMuse-II

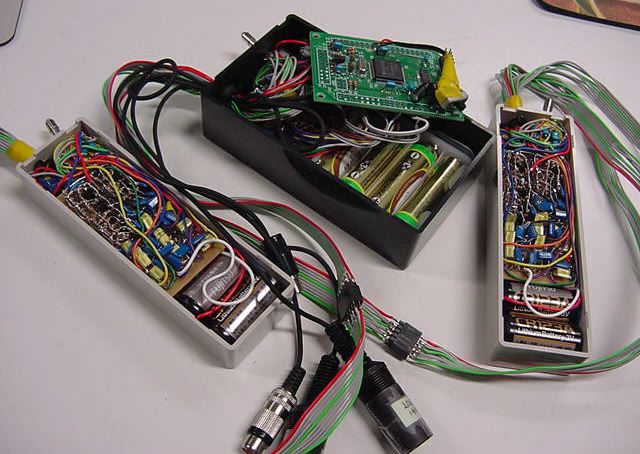

3-2.MiniBioMuse-III

その後しばらくの停滞期を経て、2000-2001年に最終的に新しい"MiniBioMuse-III"へと進展した。

MiniBioMuse-III

文献[10]にあるのでここでは詳細を省略するが、

などの改良を行い機能を大幅に強化した。

- 独立成分分析による多チャンネル計測

- ソフトウェアDSPによるノッチフィルタ

- フロントエンド回路の改良(図9)

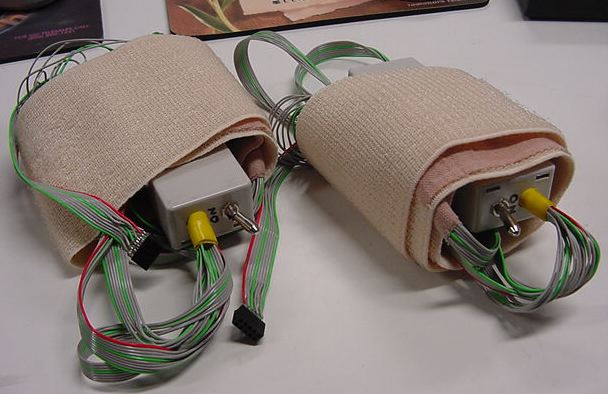

- 電極バンドの改良(図10)

- 密度空中配線による実装

- マイコンAKI-H8によるシステム化(図11)

- 制御情報のMIDI入力化

- 8ビット2chのD/A出力ポートの追加

Fig.9 Front-end circuit of MiniBioMuse-III

Fig.10 Contact belt of MiniBioMuse-III

Fig.11 Main module of MiniBioMuse-III

図12は、MiniBioMuse-IIIのアナログセンシング出力信号の一例であり、上段は平静時のEMG出力信号、下段は緊張時信号の一例である。

Fig.12 Output signals of MiniBioMuse-III

図13は、"MiniBioMuse-III"のMIDI出力情報をMaxでリアルタイム表示した様子の一例である。 画面は左上から下に「左手1ch」-「4ch」、いちばん右側が「右手5ch」-「8ch」である。 この図は、両腕を交互に緊張・弛緩させた例であり、時間的同期性とそれぞれの腕の筋肉の動作の違いが見て取れる。 本研究においては、この独立した16チャンネルの情報をScanned Synthesisの16バンドに対応したパラメータとしてマッピングした。

Fig.13 MIDI output of MiniBioMuse-III

4. 筋電情報によるScanned Synthesis制御

もっとも単純にMiniBioMuse-IIIからの出力をScanned Synthesisにマッピングする方法は、16系統のEGM情報をScanned Synthesis音源の16バンドのスキャンメモリの値そのものである、と意味付けて直結することである。 図14は、この方法をシミュレーションするために、あらかじめMiniBioMuse-IIIを装着した人体からの情報をSMF形式のデータとして記録しておき、これをMax/MSPの"seq"オブジェクトで「再生」しながら、実際にそのサウンドを検証しているところである。

Fig.14 EMG controlled Scanned Synthesis

しかしこの方法では、片腕あたり8電極をぐるりと腕に巻いてそれを2チャンネル並べた入力に対して、特に8チャンネルで分割される意味を持たないスキャンメモリとの関係との対応に必然性が欠けるという欠点がある。 筋肉の場合にはそれぞれ個々の独立性とともに連携性があるために、これを隣接したバンドが連続性をもって接続されているScanned Synthesisの特性と対応づけることには意味があると言えよう。

また、従来からの楽音合成にあるように、音源そのものに多種のパラメータがあり、これをリアルタイム制御する入力情報も多数のものがある場合には、このマッピングがその音源の個性と特長を引き出すことも多い。 その意味では、かつて筆者がGranular Synthesisで実現したように、ニューラルネットワークによるリアルタイム・パラメータマッピングの手法なども検討する余地がある[11]-[13]。 この部分はパターン認識や学習システムという視点から、今後も検討していくつもりである。

5. おわりに

物理モデル音源の新手法"SCANNED SYNTHESIS"の応用として、楽音合成パラメータを多チャンネル筋電センサにより直接にリアルタイム制御する音源システムを開発した。 実際のサウンドとしてまだ「面白い」ものは出来ていないが、時間領域での可視性があり、人間の身体動作による筋電情報によるコントロールによって生き生きとしたライブパフォーマンスを実現できる可能性を期待させる組み合わせであり、今後とも実験と検討を進めていきたい。参考文献

[1] Max Mathews, Scanned Synthesis, http://www.musique.umontreal.ca/electro/Activites/MaxMathews.html

[2] cSounds.com - Scanned Synthesis, http://www.csounds.com/scanned/

[3] The Alternative Csound Reference Manual- Signal Generators- Scanned Synthesis, http://kevindumpscore.com/docs/csound-manual/siggenscantop.html

[4] Art and Science Laboratory, http://nagasm.org

[5] 長嶋洋一, 橋本周司, 平賀譲, 平田圭二 : コンピュータと音楽の世界, 共立出版, 1999

[6] 長嶋洋一 : コンピュータサウンドの世界, CQ出版, 1999

[7] 長嶋洋一 : Java & AKI-80, CQ出版, 1997

[8] 長嶋洋一 : 作るサウンドエレクトロニクス, http://nagasm.org/ASL/mse/index.html

[9] 長嶋洋一 : オリジナルMIDIセンサを作ろう , http://nagasm.org/ASL/original/index.html

[10] 長嶋洋一 : 新・筋電センサ"MiniBioMuse-III", http://nagasm.org/ASL/SIGMUS0108/index.html

[11] Yoichi Nagashima : Neural-Network Control for Real-Time Granular Synthesis, 1992年度人工知能学会全国大会論文集I, 1992

[12] Yoichi Nagashima : An Experiment of Real-Time Control for Psuedo Granular Synthesis, Proceedings of International Symposium on Musical Acoustics, 1992

[13] Yoichi Nagashima : Real-Time Control System for "Pseudo" Granulation, Proceedings of 1992 ICMC, International Computer Music Association, 1992